La desinformación se puede dar en muchos formatos distintos y lo estamos viendo con la oleada que ha habido tras la invasión de Rusia a Ucrania el 24 de febrero. En España son ya más de **100 bulos y desinformaciones que se mueven con diferente forma: fotos y vídeos antiguos que se comparten como si fuesen actuales, vídeos con subtítulos falsos, tuits que se hacen pasar por medios de comunicación o bulos que ya se han utilizado en otros momentos son algunos de estos contenidos que hemos desmentido. Estas mismas estrategias también las siguen los bulos en otros países.

Os hemos contado cómo estamos usando las herramientas de verificación para desmentir bulos sobre Rusia y Ucrania y también hemos recopilado recursos para mantenerse informado ante esta situación. Ahora os explicamos en qué formatos se está difundiendo la desinformación sobre Rusia y Ucrania.

Fotos y vídeos antiguos que circulan como actuales

Usar fotos o vídeos que son reales, pero antiguos, y hacerlos pasar por actuales es una forma habitual de desinformar. Este es uno de los tipos de bulos que más estamos viendo circular durante esta guerra iniciada por Rusia contra Ucrania.

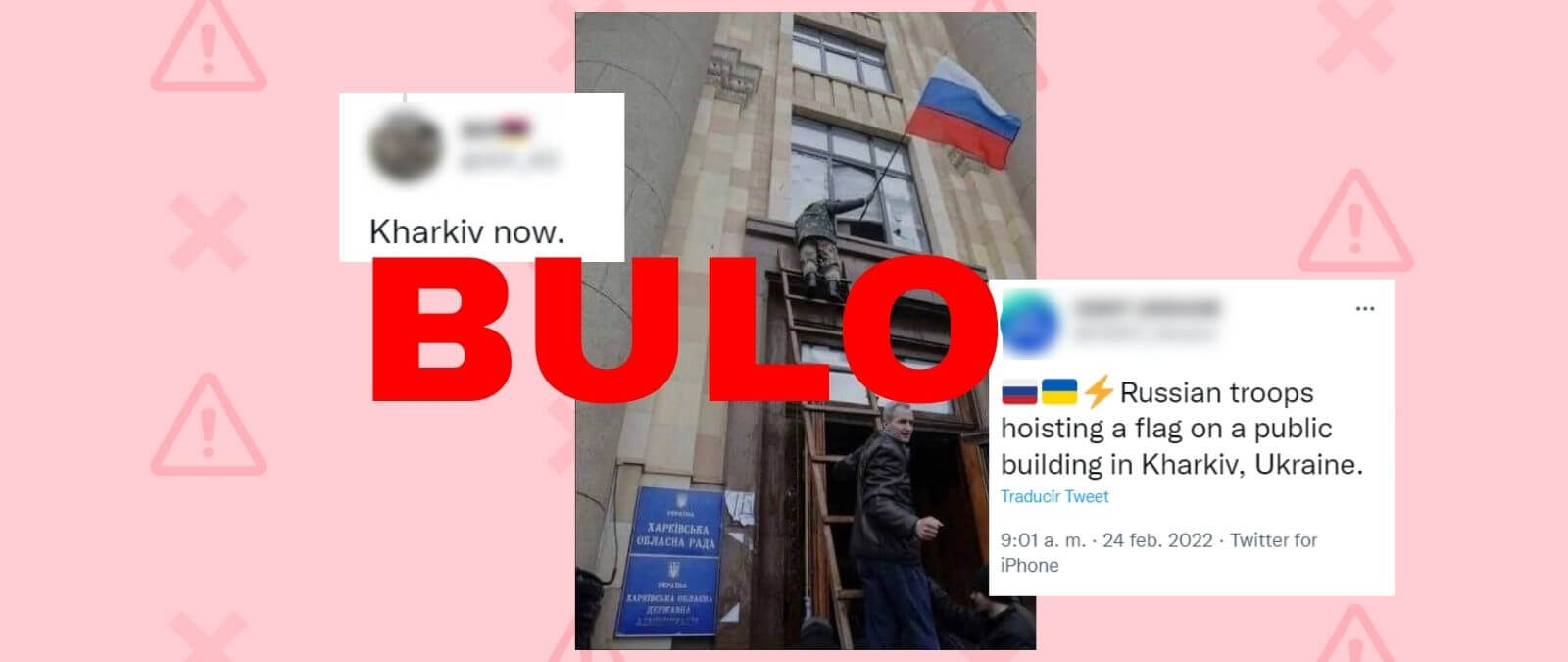

Es el caso de esta foto en la que una persona está colocando una bandera rusa en un edificio público de Ucrania. Se ha movido estos días como si fuese de ahora y, aunque sí está tomada en una ciudad ucraniana, se hizo en 2014.

De la misma forma se ha difundido estos días otra foto de un incendio en la zona de exclusión de Chernóbil que se produjo en abril de 2020 y que, por lo tanto, no tiene relación con la situación actual del lugar.

Fotos y vídeos de otros conflictos que se difunden como si fuesen de Ucrania

Otra de las prácticas que también hemos visto bastante desde que Rusia bombardease a Ucrania el 24 de febrero es la de utilizar imágenes, ya sean fotos o vídeos, de otros conflictos armados afirmando que se han tomado en Ucrania.

Por ejemplo, el 25 de febrero se difundió la foto de una niña siendo rescatada de una zona con escombros por una persona que la llevaba en brazos. Se compartió con este comentario: “Ucrania es tendencia por las imágenes que está dejando la guerra contra Rusia. Gente y niños lastimados por las detonaciones (...)”. La imagen, sin embargo, no es de ningún lugar de Ucrania, sino que se tomó en Gaza (Palestina) en 2021.

También se han usado fotos de bombardeos para decir que están teniendo lugar ahora en este país. Es el caso de estas dos imágenes de explosiones de 2018 y 2021, que también se grabaron en Gaza.

Subtítulos falsos que no se corresponden con el audio

Los desinformadores también aprovechan los vídeos en otros idiomas para intentar colárnosla con subtítulos falsos que no tienen relación con el audio que supuestamente representan.

Así utilizaron una rueda de prensa del presidente de Estados Unidos, Joe Biden, en la que según unos subtítulos que le añadieron posteriormente habría dicho que atacaría a Rusia por invadir a Ucrania. Las declaraciones de ese vídeo viral las podemos escuchar entre el minuto 6:37 y el 6:50 y entre el minuto 8:13 y el final:

Sin embargo, esos subtítulos que le habían añadido no tenían nada que ver con lo que Biden dijo durante la rueda de prensa.

Videojuegos y simulaciones que hacen pasar por imágenes reales

Hay imágenes creadas digitalmente que nos pueden parecer reales y en este caso hemos visto cómo vídeos sacados de videojuegos y simuladores también se han convertido en desinformación, al difundirlos como reales.

En este caso veíamos un supuesto bombardeo ruso en territorio ucraniano, según los comentarios con los que se compartió el vídeo, aunque las imágenes corresponden al videojuego War Thunder. Se pueden ver en un vídeo subido a YouTube en diciembre de 2021.

Pero este no ha sido el único vídeo de este tipo que se ha movido desde el 24 de febrero. Este otro vídeo supuestamente muestra cómo un avión bombardea unos edificios ucranianos, pero también es un bulo: se trata de una simulación del videojuego Arma 3.

Fragmentos de series o películas difundidos como si no fuesen ficción

Usar fragmentos de películas o series de televisión para desinformar no es una práctica nueva. Lo hemos visto en otras ocasiones como durante la pandemia de coronavirus y ahora se ha vuelto a utilizar.

Volodímir Zelenski ha sido actor antes de ser presidente de Ucrania, un cargo que ocupa desde 2019. Dos años antes, en 2017, protagonizó una serie llamada Servidor del Pueblo 2. En una de las escenas, el personaje que interpreta Zelenski dispara a decenas de personas en el interior de una sala. Ese fragmento se difundió afirmando que era la campaña electoral de Zelenski aunque, como os hemos contado, las imágenes aparecen a partir del minuto 4 de este capítulo de la serie.

Imágenes que ya se han usado antes para desinformar en otros contextos

A veces los bulos se reciclan y las imágenes que se han usado para desinformar en un momento dado vuelven a difundirse más adelante vinculadas a otros hechos. Es lo que ha pasado con el vídeo de unas explosiones que se produjeron en una zona industrial de Tianjin (China) en 2015.

Cuando en enero de 2020 hubo una explosión en una planta petroquímica de Tarragona, estas imágenes circularon por redes sociales con comentarios que decían que era de ese momento. Ahora, dos años más tarde, han vuelto a aparecer con textos que dicen que están grabadas durante el bombardeo de Rusia a Ucrania, pero no es cierto.

Falsas portadas de revistas

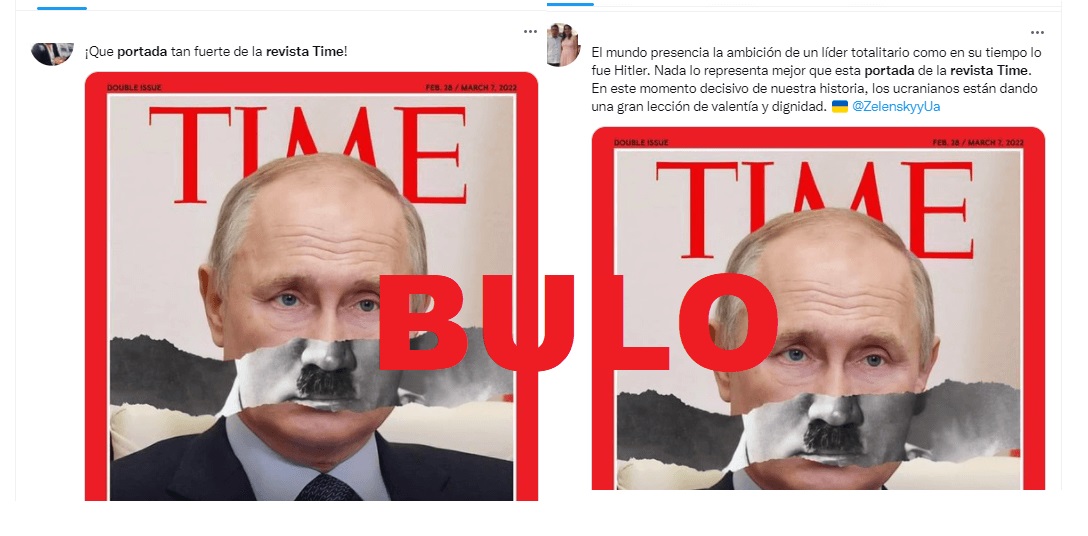

Las falsas portadas de la revista Time que se comparten como reales son prácticamente un clásico de la desinformación. En este recopilatorio os contamos algunas de las que hemos desmentido.

Estos días se ha difundido una con una foto de Putin mezclada con una foto de Adolf Hitler y con el titular "The return of history" (“El retorno de la historia”, en español).

No es una portada publicada por Time. Es un montaje realizado por Patrick Mulder y en la parte inferior de la ilustración podemos ver su nombre. De hecho, el propio Mulder publicó un comunicado este 28 de febrero en Twitter asegurando que creó la portada porque la original de la revista Time "no era inspiradora y carecía de convicción".

Hechos que sí son actuales, pero se afirma que son antiguos para desinformar

Algunas veces también se desinforma diciendo que un hecho que sí es actual es antiguo y que no tiene que ver con lo pasa ahora. Es lo que ha sucedido con este vídeo en el que un grupo de personas ondea banderas ucranianas en una plaza mientras suena el himno nacional.

Ucranianos se reúnen en Donetsk para cantar el himno nacional frente a los ataques de Rusia pic.twitter.com/IWZj0uCWjz

— EL MUNDO (@elmundoes) February 24, 2022

El diario El Mundo lo publicó como actual y poco tiempo después comenzó a viralizarse que se trataba de un vídeo de 2014. Como ya os contamos, se grabó en la ciudad ucraniana de Kramatorsk el 23 de febrero de 2022.

Algo parecido ha sucedido también con imágenes reales de las que se ha dicho que son “un montaje”, como la foto que se difundió de un tanque ruso en Ucrania con la bandera de la Unión Soviética. La foto es real y, de hecho, existen otras imágenes y vídeos de ese mismo tanque.

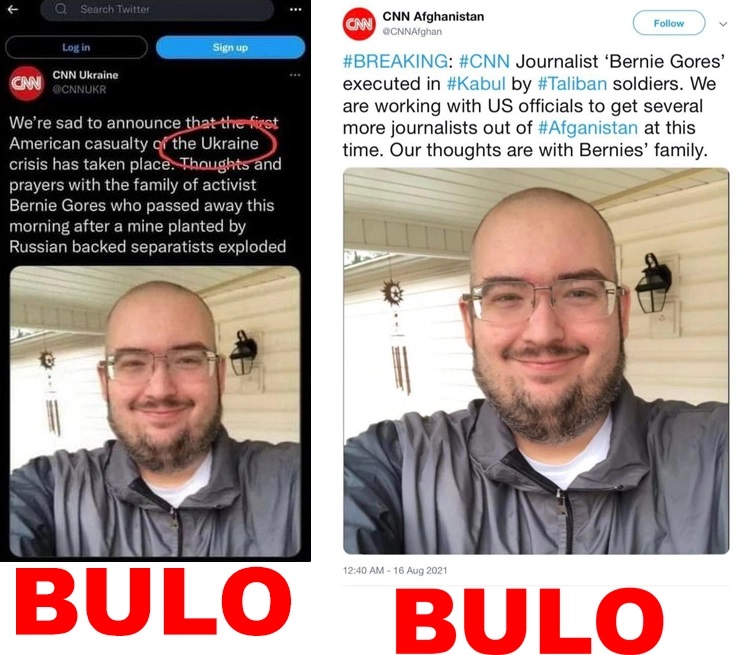

Tuits que suplantan a medios de comunicación

Los bulos también se mueven en formato de tuits y ahora se han difundido dos que son de cuentas de Twitter que se han hecho pasar por la cadena CNN. Una como si fuese el perfil de CNN en Afganistán y la otra como si fuese el de CNN en Ucrania. En ambos casos habrían compartido la misma foto de una persona diciendo que ha muerto en Afganistán, en el primer caso, y en Ucrania, en el segundo.

Los comentarios con los que se compartían ambas capturas decían que “la misma persona que fue 'ejecutada' por los talibanes en Afganistán es también la primera víctima estadounidense en la 'crisis de Ucrania'”. Pero, como decimos, ambas cuentas de Twitter, que ya han sido suspendidas, suplantan a la CNN.

*Falsas verificaciones para desinformar con foco en audiencias rusas pero que circulan en español

Una de las estrategias detectadas es una campaña que busca desinformar a través de falsos desmentidos o verificaciones de falsa bandera que ha documentado el equipo del Media Forensics Hub de la Universidad de Clemson y la organización ProPublica en una investigación publicada el pasado 8 de marzo y también ha identificado Maldita.es en España.

En esa investigación se documenta el hallazgo de al menos una docena de vídeos que pretenden desmontar supuestos bulos con origen ucraniano que tienen como foco una audiencia de habla rusa y de los que no hay registros de que se hubieran viralizado previamente por redes sociales. Aunque los rótulos del contenido aparecen escritos en ruso, al menos tres de los ejemplos citados por los investigadores han llegado al sistema de datos y análisis de desinformación de Maldita.es, que almacena las alertas de posibles contenidos en formato de audio, vídeo, texto e imagen.

El patrón de estas desinformaciones es siempre el mismo: se trata de vídeos que parten la pantalla en dos para comparar el supuesto contenido falso y la presunta verificación, acompañadas cada una de las franjas de breves rótulos en ruso. Tras el análisis de los vídeos, los investigadores de Media Forensics Hub y ProPublica concluyeron que la supuesta desinformación proucraniana no parecía haberse viralizado antes de que fuera verificada y circulara con rótulos en ruso. Después, analizaron los datos de los archivos digitales o metadatos, que incluyen información como el nombre de los clips usados o el software con el que se editaron. Y su hallazgo fue que los dos vídeos contrapuestos en el contenido se crearon usando el mismo archivo duplicado.

Deepfakes para suplantar a personajes públicos ***

Los deepfakes son vídeos ultrarrealistas generados con ordenador en los que se recrea la imagen y la voz de una persona para hacerle hacer cosas que nunca ha hecho y decir cosas que nunca ha dicho. En Maldita.es ya os hemos contado que los deepfakes todavía no suponen un gran problema en cuanto a desinformación, entre otros motivos porque hacer uno requiere tiempo y conocimiento en edición de vídeos. Sin embargo, durante la invasión de Rusia a Ucrania sí ha comenzado a circular en redes un vídeo del presidente ucraniano, Volodímir Zelenski, —de poca calidad— pero manipulado.

En las imágenes el mandatario pide supuestamente a sus tropas rendirse y dejar las armas ante el ejército ruso, algo que el propio presidente ha negado a través de su perfil de Instagram. Se trata de un deepfake, uno de esos vídeos ultrarrealistas generados con ordenador en los que se recrea la imagen y la voz de una persona para hacerle decir cosas que nunca ha dicho.

En esta ocasión, la poca calidad del vídeo que ha circulado ha provocado que muchos usuarios hayan detectado la manipulación, calificándolo rápidamente de deepfake.

En situaciones de crisis como la que se está viviendo en Ucrania es normal que se difundan desinformaciones. En Maldita.es también contactamos con expertos que coinciden en que la difusión de bulos en momentos de emergencias puede ser una reacción normal ante la ansiedad, la falta de información y la ambigüedad que se suelen dar estas circunstancias.

Pero esas desinformaciones no hacen más que agravar una situación que ya es de por sí complicada, por lo que antes de compartir cualquier contenido que os llegue, aseguraos de que es real o actual.

Os estamos contando en este recopilatorio todos los bulos y desinformaciones que hemos desmentido sobre la invasión de Rusia a Ucrania. Si detectas alguno más, puedes hacérnoslo llegar a través de nuestro chatbot de WhatsApp al +34 644 22 93 19. Además, fact-checkers de todo el mundo nos hemos unido para crear una base de datos mundial y colaborativa, #UkraineFacts, para luchar contra la desinformación sobre el ataque de Rusia a Ucrania. En el mapa, puedes ver en qué países se ha detectado cada desinformación y acceder a los desmentidos.

*Actualizada el 14/3/2022 a las 11:55 horas con la modalidad de desinformación a través de falsas verificaciones que circulan en español

** Actualizada el 15/3/2022 a las 12:36 horas al superar el umbral de 100 bulos desmentidos sobre la situación en Ucrania

***Actualizado el 17/3/2022 para añadir la el formato de los deepfakes