¡Hola, malditas y malditos! Hoy es martes de consultorio tecnológico y os traemos la vigésima edición. Cada vez vamos sumando más y más preguntas que os inquietan sobre el mundo tecnológico y el uso de vuestros datos, incluidos los de vuestros pequeños: hoy, entre otras cosas, nos preguntáis por los riesgos de subir fotos de menores a Internet.

Antes de responder a vuestras últimas consultas, os recordamos que podéis hacernos llegar todas las que queráis a través del correo [email protected], nuestro Twitter, Facebook o directamente a través de este formulario.

¿Qué son los neuroderechos y cómo me afectan?

“Tecnologías capaces de decodificar la información que tenemos en nuestro cerebro y leer literalmente nuestros pensamientos”: ¿Os suena a peli de ciencia ficción? Pues volvamos a la vida real, porque ese tipo de tecnología ya se está estudiando y hay lugares del mundo en los que se intenta meter en las páginas de leyes. Concretamente, en Chile.

¿Qué se busca proteger? Principalmente, la “privacidad mental” de las personas y su “derecho a la identidad”. La Pontificia Universidad Católica de Chile pone como ejemplo los datos médicos del cerebro de las personas, como si hablásemos de la confidencialidad que se trata con los trasplantes de órganos. Pero en este concepto también entra la protección de nuestros pensamientos y nuestra identidad, a cuenta de que cada vez haya más experimentos que tratan de interpretar datos de nuestro cerebro. Vamos por pasos.

En Chile se está planteando integrar los “neuroderechos” en su Constitución a iniciativa del grupo de trabajo que dirige el neurocientífico español Rafael Yuste, que es director del NeuroTechnology Center de la Universidad de Columbia. Es la persona que ha puesto sobre la mesa el debate a nivel mundial, ya que considera que la neurotecnología literalmente “abre la tapa del cerebro” y, por ello, hay que adelantarse a sus posibles riesgos.

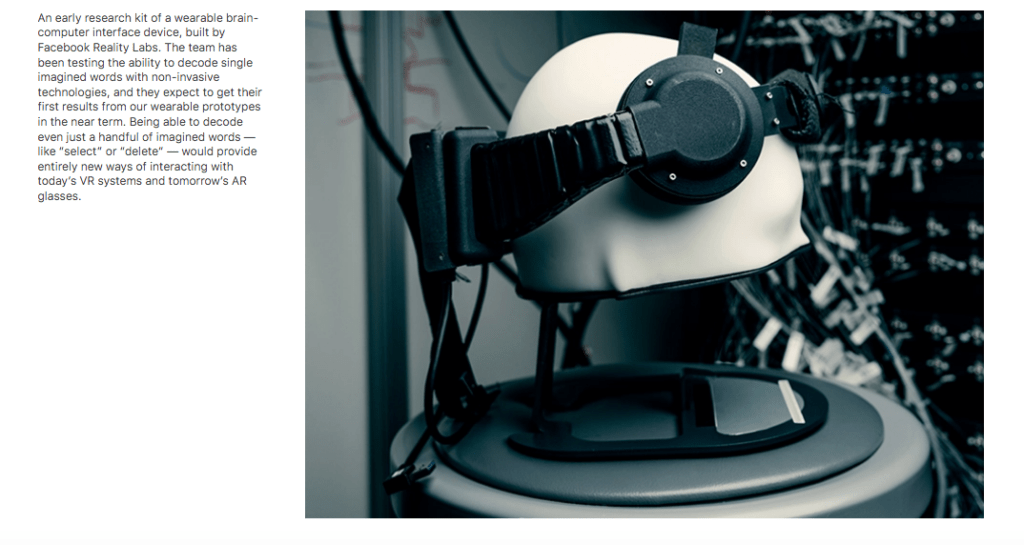

Por poner ejemplos concretos: ya hay empresas e investigaciones académicas que investigan cómo conectar el cerebro a dispositivos externos, como a una prótesis de un miembro amputado, por ejemplo. También existen tecnologías en las que trabajan empresas de la talla de Facebook, que nos venden como capaces de “traducir” palabras del cerebro a un ordenador sin que las digamos en alto.

El monitoreo de la actividad cerebral es algo necesario para todos esos experimentos y en algún momento la información que se obtenga de ellos también podría someterse a los sesgos que ya se observan en la inteligencia artificial, según Yuste.

“Quizás ese monitoreo objetivamente no signifique nada; pero basta que alguien decida que determinado patrón es malo, para que ese monitoreo pueda significar ser discriminada”, nos explica Michelle Bordachar, de la organización chilena Derechos Digitales.

Además, esos procesos requieren de alguna que otra intervención en un cuerpo humano, por lo que las mediciones y los resultados que se sacarían de ella pasarían a estar protegidos por esta nueva categoría de neuroderechos (o eso, al menos, es en lo que se trabaja). Yuste propone que este tipo de protección esté al nivel de los derechos humanos, de ahí que en Chile se esté trabajando en una reforma constitucional.

Es muy complicado instaurar esto a nivel mundial, ya que mezcla componentes científicos con otros debates en lo que todavía se está trabajando. Entre ellos, el de la privacidad y la protección de datos. En Chile, por ejemplo, todavía no cuentan con una ley de protección de datos actualizada, ya que la actual es del año 1999, según Bordachar.

Bordachar asegura que el estado actual de las técnicas que se estudian en el campo de la neurotecnología todavía es muy “incipiente”, por lo que sería más importante que tanto en Chile como en el resto de países se contara antes con una regulación fuerte en materia de protección de datos y una autoridad que se encargue de hacerla cumplir.

“El desarrollo de la neurotecnología sí representa una amenaza para las personas, pero es una amenaza que podría ser mitigada gracias al derecho a la privacidad y el derecho a la protección de los datos personales”, explica.

A nivel europeo, todavía no se plantea que esta categoría de nuevos derechos pudieran equipararse a los derechos humanos. La secretaria de Estado de Digitalización e Inteligencia Artificial, Carme Artigas, comentó este mes en la presentación en el parlamento chileno del Proyecto de Ley de Neuroprotección que la labor de su secretaría en España, por ejemplo, es la de “promover la adopción exitosa de tecnologías disruptivas como la inteligencia artificial” en el país.

Mencionó la Carta de Derechos Digitales en la que trabajan, que tiene como objetivo hacer que el mundo online y el offline tengan las mismas protecciones para las personas, pero no precisó que este tema se estuviera tratando a día de hoy.

¿Qué riesgos hay al subir fotos de los hijos a Internet mientras son menores? ¿Pueden luego ellos pedir que se borren esas fotos?

Nos habéis preguntado por un tema que se lleva discutiendo años, desde que entraron en escena las redes sociales. O sea, más espacios a los que subir fotos y vídeos de bebés (porque cómo te vas a resistir a esos mofletes o a compartir sus primeros pasos con todos tus amigos a la vez) y menores. Sin embargo, aún tenéis preguntas: ¿qué supone para un menor que subamos sus imágenes mientras son pequeños? ¿Interfiere con su derecho a la privacidad? ¿Pueden ellos de mayores pedir que se eliminen esas fotos?

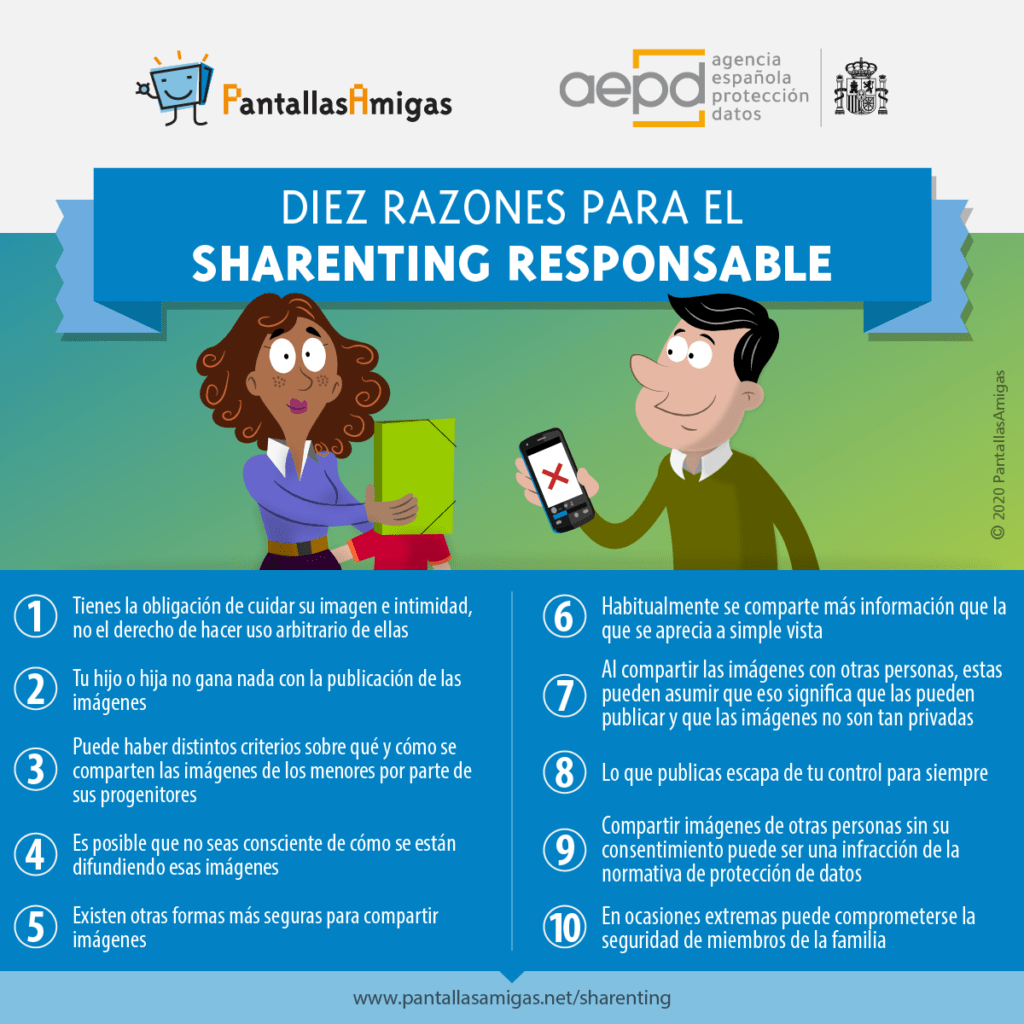

Este fenómeno tiene un nombre que hemos cogido prestado del inglés: sharenting. El término mezcla las voces inglesas ‘share’ (compartir) y ‘parenting’ (criar a los hijos), así que ya podéis ver por dónde van los tiros. Resume la costumbre que tienen los padres y familiares de subir fotografías y vídeos de sus hijos a las redes sociales y compartirlas a través de aplicaciones como WhatsApp como si no hubiera un mañana.

“Puede parecer que compartir una o varias fotos ‘graciosas’ de nuestro hijo/a en un grupo de mensajería familiar o en nuestro perfil de redes sociales, es un gesto inocente que no tendrá mayor repercusión. Pero es un contenido sensible por el mero hecho de afectar a la imagen de un menor, y pasa a formar parte de una cadena de difusión de información”, explican en esta publicación de la campaña “Internet Segura For Kids” (IS4K) del INCIBE.

Es decir, que no debemos pensar que por que colguemos una foto en nuestro perfil personal de una red social o la compartamos en un grupo de conocidos, esas imágenes no pueden acabar en el ordenador de un desconocido o en el móvil de amigos de nuestros amigos.

¿Y qué tiene esto de peligroso? Los efectos más graves son los casos de suplantación de identidad, de ciberacoso y de grooming: adultos que puedan usar imágenes de esos menores para hacerse pasar por ellos y establecer relación con otros niños o adolescentes. Hay un momento en el que se puede perder el control de lo que los jóvenes hablan con ellos y les comparten, lo que en un caso extremo puede derivar en un caso de abuso infantil o chantajes sexuales. Esto puede ocurrir en el plano online pero también pasar al mundo offline y causar serios problemas de ansiedad a los menores.

“Hay que plantearse si nuestro hijo o hija en un futuro puede llegar a tener algún problema con esas imágenes, otro punto es si con ellas estamos creando un conflicto en la pareja, en caso de que la otra parte tenga otros criterios al respecto de la privacidad de su hijo/a. También hay que pensar en su futuro y si en algún momento esas imágenes pueden servir para ridiculizar al menor”, cuenta Jorge Flores, director de la organización Pantallas Amigas, dedicada a la alfabetización digital de menores.

Todos en algún momento nos hemos cruzado con un meme viral y nos hemos reído de él, ¿pero qué efecto tendría en ti si fuera tu hijo o hija quien apareciese en él? En este artículo sobre TikTok recogemos cómo desde el INCIBE nos hablaban que incluso revelar la ubicación de un menor podría llevar a que se produjese daño físico o un problema relacionado con el acoso infantil.

“Especialmente durante sus primeros años de vida, estos no tienen conocimiento ni capacidad de disposición sobre la sobreexposición a la que se ven sometidos en redes por parte de sus padres, quienes crean una huella digital del menor prácticamente desde el momento de su nacimiento”, describe a Maldita Tecnología Camino García, abogada especializada en privacidad y protección de datos en MRK Abogados.

García incide en que la publicación de fotografías de menores normalmente está asociada a momentos íntimos que se tienen en casa o que los adultos han decidido que son graciosos o importantes, pero sin tener en cuenta que subirlas puede suponer una intromisión en su privacidad y que implica estar tomando una decisión que ellos no han adoptado. Este hecho tiene mención en el artículo 84 de la Ley Orgánica de Protección de Datos.

La aparición de los smartphones fue decisiva para que se hablara de esta práctica como un fenómeno a tener en cuenta, ya que nos puso una cámara más o menos potente y un aparato con un espacio de almacenamiento considerable y conexión a Internet en el bolsillo sin mayor esfuerzo. Por eso, entre las recomendaciones que da la campaña de IS4K también está la de hacer una reflexión sobre ese panorama: muchos de los servicios que nos animan a subir más y más contenido buscan precisamente que “hagamos pública cada vez más información”. Las empresas también tienen sus propios intereses.

Otra de las preguntas que nos habéis hecho es si los menores de edad pueden pedir que se retiren las imágenes una vez se hagan mayores. Ni siquiera tienen que esperar a cumplir los 18: “En España la edad a la que los menores pueden prestar su consentimiento para el tratamiento de los datos se fija en 14 años, por lo que a partir de esa edad podría solicitar la retirada de contenidos, por no haber prestado su consentimiento inequívoco para la publicación de sus imágenes”, nos explica Camino García.

En este artículo de IS4K y esta campaña de Pantallas Amigas y la Agencia Española de Protección de Datos podéis leer algunas claves para reducir el riesgo de la sobreexposición de los menores, como optar por canales no conectados a Internet para compartir fotos (o crear un álbum, por ejemplo) o no mostrar directamente la cara de los peques.

¿Es segura la aplicación Radar COVID?

Nos han llegado varias preguntas sobre la aplicación de rastreo de contactos Radar COVID porque sigue habiendo dudas sobre su seguridad y el uso que se le está dando a día de hoy. La aplicación está integrada a 20 de octubre en todas las comunidades autónomas salvo en Cataluña, que ha optado por un sistema propio de rastreo, por el momento.

Te hemos hablado de cómo funciona, de por qué solo puede haber una aplicación de este tipo por país y también de las diferencias con otras aplicaciones sobre COVID-19 del Gobierno. Y sí, hasta el momento, la conclusión es que protege tu privacidad.

Radar COVID funciona por bluetooth y usa una serie de códigos anónimos que se intercambian con otros teléfonos. Cuando comunicamos un positivo a través de la app, registramos un código concreto que comunica al resto de móviles con los que ha estado en contacto que su dueño ha estado en contacto con una persona que ha dado positivo, aunque sin decir quién ni en qué momento exacto.

Está diseñada a partir de una tecnología llamada DP3-T que cumple con un estándar llamado ‘privacidad por diseño’, del que ya te hemos hablado. Significa que está diseñada para proteger la privacidad de los usuarios y no revelar información personal que no haga falta. También utiliza herramientas de Google y Apple que se han instalado en los teléfonos móviles con el objetivo de que estas aplicaciones funcionen: el sistema de notificación de exposiciones al COVID-19. También te hemos explicado de en qué consiste.

A pesar de estar basada en estas dos tecnologías, cuando un equipo de desarrolladores crea una aplicación, puede añadir las funcionalidades que quiera. De ahí que desde el principio se exigía que se liberase el código de Radar COVID y así se pudiera comprobar que la aplicación no hacía ninguna recogida de datos innecesaria. La Secretaría de Estado de Digitalización e Inteligencia Artificial es su titular:

A día de hoy se han hecho bastantes análisis y comentarios en el repositorio en el que se ha publicado el código de Radar COVID. A finales de septiembre, un usuario publicó un extenso informe sobre el funcionamiento de la aplicación para Android en el que concluye que no recoge información personal sobre los usuarios.

“La aplicación no solicita ni el permiso de telefonía (que permitiría saber el IMEI del dispositivo, y por tanto identificarlo), ni el permiso de localización, ni tampoco accede ni se conecta a ninguna cuenta del usuario”, precisa el informe. Si tenéis un teléfono Android, la ubicación necesita estar activada además del bluetooth, a pesar de que la aplicación no accede a esa información. Puedes leer más sobre por qué es así en ese enlace.

Otro usuario de la comunidad que propone mejoras en el sitio web en el que se ha publicado el código de Radar COVID, Javier Tobal, explica a Maldita Tecnología que en referencia al Reglamento General de Protección de Datos (RGPD), “la app no utiliza ningún dato que directa o indirectamente permita obtener la identidad de una persona”.

Coincide en que esta no consulta la localización del usuario ni tampoco almacena o transmite esa información a su dueño, o sea, a un servidor de la Secretaría de Estado de Digitalización e Inteligencia Artificial: “Pide los permisos estrictamente necesarios para su funcionamiento y no los utiliza para nada que no sea lo que indica la aplicación”, asegura Tobal, que es perito judicial informático.

Hace unas semanas, en un artículo en El País se exponía que la aplicación utilizaba un programa de métricas asociado a Google llamado “Firebase”. Este programa lo ofrece Google a empresas y organizaciones que quieran conocer estadísticas de uso de uno de sus productos. En el caso de Radar COVID, se instaló durante la prueba piloto de La Gomera para saber, entre otras cosas, cuántas personas de las que participaban realmente llamaban a su centro sanitario al recibir una notificación de exposición.

No es un programa muy adecuado para usarse en Radar COVID porque la idea de este tipo de aplicaciones es que se usen exclusivamente para rastrear contactos. Cuanta menos información personal recojan, mejor, pero según el informe citado, Firebase ya no está activo en las últimas versiones de la aplicación (la de Android y también iOS, de Apple): “Este código no está enviando ningún tipo de información a Firebase”.

En definitiva, la principal duda que se sigue teniendo sobre Radar COVID es si se puede usar para saber dónde estamos, si cumplimos con nuestra cuarentena, con quién nos relacionamos… La conclusión es que la aplicación no recoge ese tipo de información ni tampoco puede identificarnos de forma individual.

Si seguís teniendo dudas sobre la aplicación o cualquier tema relacionado con la privacidad, escribidnos a [email protected] o al número de WhatsApp +34 644 229 319 y trataremos de resolverlas.

¡Esperad un segundín!

No somos técnicos o ingenieros pero contamos con mucha ayuda de personas que son expertas en su campo para resolver vuestras dudas. Tampoco podemos deciros qué servicio usar o dejar de usar, solo os informamos para que luego decidáis cuál queréis usar y cómo. Porque definitivamente, juntos y juntas es más difícil que nos la cuelen.

Si tienes cualquier duda sobre esta información o cualquier otra relacionada con la manera de la que te relacionas con todo lo digital, háznosla llegar:

Primera fecha de publicación de este artículo: 20/10/2020.