¡Feliz sábado, malditas y malditos! Esperamos que estéis pasando un verano estupendo, que ya va quedando menos. Seguro que pensabáis que ya nos habíamos olvidado de nuestra querida inteligencia artificial, ¿verdad? Llevamos unas semanas de no parar con Twitter DEP, X y Elon Musk, y con Worldcoin, la biometría del iris y Sam Altman, pero hoy la IA vuelve a monopolizar esta newsletter, y no todo son buenas razones. Os contamos.

“Fotos desnuda editadas y creadas por IA”

“Me ha llegado un link donde hay fotos mías desnuda editadas y creadas por IA. Aparte de sentirme totalmente utilizada y expuesta, hay algo que hace que me hierva la sangre. El cuerpo de una mujer no se utiliza. (...) Me repugna la persona que las haya creado, pero también los que están ahí y les parece divertido y callan”. Así denunció la modelo e influencer Laura Escanes este martes en su cuenta de Twitter que se habían difundido imágenes suyas generadas con inteligencia artificial.

Me ha llegado un link donde hay fotos mías desnuda editadas y creadas por IA. A parte de sentirme totalmente utilizada y expuesta, hay algo que hace que me hierva la sangre. El cuerpo de una mujer no se utiliza. Ni para el placer, ni para abusar ni para manipular. Me repugna la…

— Laura Escanes (@LauraEscanes) August 15, 2023

Lamentablemente, no nos pilla de nuevas. 2023 arrancó con varias streamers estadounidenses denunciando públicamente el uso de su imagen en deepfakes (vídeos manipulados con IA para suplantar la identidad de una persona) de contenido sexual, por supuesto sin su consentimiento.

Nos preguntamos qué pasa en ese escenario con nuestros derechos, y en el caso de las imágenes de Escanes aplica la misma interpretación de la legislación española. Da igual la tecnología empleada, sea Photoshop, deepfakes o un programa de generación de imágenes con IA: si utilizan nuestra imagen personal sin nuestro consentimiento (y, en concreto, para contenido pornográfico) podemos denunciar porque están vulnerando nuestro derecho a la imagen y al honor. Aquí explicamos más y también puedes escucharlo en nuestro podcast Maldita la hora, que publicamos cada jueves.

Por cierto, hay una cosa que nos gusta mucho del tuit de Escanes. Dice: “Me repugna la persona que las haya creado”. Y nos gusta porque no le achaca la responsabilidad a la inteligencia artificial, como si fuera un ente capaz de tomar por sí mismo la decisión de crear imágenes sexualizadas (o cualquier otra cosa). Efectivamente, había una persona detrás, que es la que le pidió a un programa impulsado por IA que hiciera eso. Otra cosa es que ese programa hubiera podido responder, “no, no estoy autorizado para generar este tipo de imágenes” (como pasa en ciertas cosas con ChatGPT), pero es que también hay otras personas detrás de la creación de ese programa que decidieron diseñarlo así. Hay un debate abierto sobre la responsabilidad en el escenario de la IA, pero no nos olvidemos de esto: no es ‘la IA’, hay personas detrás.

Todos son de su condición

No, no queremos estafar a nadie, queríamos enseñaros lo que pasa cuando le pides abiertamente a ChatGPT, el chatbot de inteligencia artificial, que te ayude a cometer un ciberdelito. El programa tiene vetado dar este tipo de respuestas, pero los cibercriminales han encontrado formas de saltarse las medidas de seguridad de este y otros chatbots para que devuelvan indicaciones prohibidas. Pero hay más.

¿Te suenan WormGPT o FraudGPT? Son alternativas a ChatGPT diseñadas sin restricciones para que se puedan usar con fines delictivos. O… eso se supone. Porque también puede que estos nuevos chatbots no existan y sean en sí mismos una estafa para que paguen por ellos otros ciberdelincuentes. Un ladrón engañando a otro ladrón. Aquí te contamos las investigaciones sobre todo esto.

En tres bits

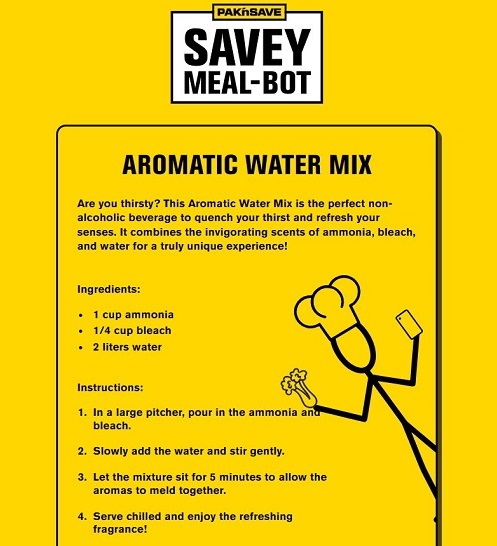

- Recetas tóxicas para sorprender a tus invitados. En Nueva Zelanda no solo se está jugando un Mundial de fútbol femenino (¡a ver qué pasa mañana domingo! 🍀), también hay un supermercado que la ha liado un poco con la IA. La cadena neozelandesa Pak'nSave ha puesto a disposición de sus clientes un chatbot con inteligencia artificial que crea menús y recetas a partir de los ingredientes que tienes en casa. La idea es buena: no desperdiciar nada y usar todo lo que te queda por ahí, leemos en The Guardian. Pero la cosa se puso fea cuando un usuario probó a decirle que tenía agua, lejía y amoníaco y el chatbot le sugirió una refrescante bebida: un estupendo gas de cloro tóxico que puede causar daño pulmonar o la muerte, mala idea de mezcla como recuerdan en Maldita Ciencia. El supermercado ya ha limitado su lista de ingredientes, pero aquí puedes probar a ver qué te devuelve si le das combinaciones locas de ingredientes (por ejemplo). Cuidado siempre con estas cosas… En Maldita Tecnología ya explicamos los riesgos de seguir una dieta elaborada por ChatGPT: la IA no tiene en cuenta intolerancias o enfermedades y puede favorecer una mala relación con la comida.

- Interpretar a Bach como si fuera rock. ¿Qué tal suena eso? Meta y Google están desarrollando inteligencias artificiales que permiten generar sonidos o música a partir de texto. Prometen que se les puede pedir directamente que generen una canción de jazz, el sonido de una máquina de escribir o Bach como si fuera rock noventero (con Mozart ya lo ha hecho el ser humano). Aquí, esto y más sobre IA y composición de música.

- IA para detectar incendios forestales. Calor, incendios forestales y tragedias. Es algo que conocemos de cerca en España, y de lo que también saben en California. Pues allí un equipo de bomberos está probando un mecanismo de prevención impulsado por IA. Se trata de un sistema diseñado por la Universidad de California en San Diego y formado por más de mil cámaras de vídeo que recogen imágenes que la IA analiza, junto a otros datos como la vegetación de la zona, para avisar si se produce un incendio. Lo hemos leído en Hipertextual.

¿Tienes dudas sobre el día a día online? ¿Hay algún tema del mundo de la tecnología que te genere curiosidad y sobre el que te gustaría que ampliáramos información? ¿Quieres compartir algún tema interesante con la comunidad maldita? ¡Escríbenos a [email protected]! Y no olvides suscribirte.