Hoy se cumplen seis meses desde que el modelo de inteligencia artificial (IA) ChatGPT, desarrollado por la empresa OpenAI, se lanzó de forma pública. En este tiempo, la versión gratuita de esta herramienta se ha democratizado y ha llegado a millones de usuarios: apenas dos meses después de su lanzamiento, el 30 de noviembre de 2022, ya había alcanzado los 100 millones de usuarios mensuales, convirtiéndose en la plataforma de Internet que más rápido ha crecido en toda la historia.

Meses más tarde, el 1 de febrero de 2023, OpenAI lanzó GPT Plus, la versión de pago del chatbot impulsada por el modelo de IA GPT-4 que permite funciones exclusivas, como respuestas más rápidas o el acceso a Internet. No obstante, es la versión gratuita la que más usuarios aglutina: solo en enero recibía más de 13 millones de usuarios al día, según un estudio de la consultora UBS. Además, el chatbot ya cuenta con su propia aplicación para móviles: de momento solo está disponible en Estados Unidos y para usuarios iOs (Apple), aunque se espera que próximamente se lance también para Android.

A pesar de que el chatbot ha evolucionado durante los últimos seis meses, ChatGPT sigue equivocándose y no está conectado a la actualidad (la base de datos con la que se le entrenó llega hasta 2021). Por eso desconoce sucesos como la guerra de Ucrania. Los expertos consultados por Maldita.es aseguran que la IA no está todavía “lo suficientemente perfeccionada”, ya que en muchos casos sigue “inventándose la información”. Además, su uso en campos como el de la nutrición y el deporte puede entrañar riesgos.

A un clic, ¿de qué hablamos en este tema? Pincha para ampliar:

- ChatGPT cumple seis meses: ¿está la IA lo suficientemente perfeccionada como para usarla a ciegas?

- En qué ha mejorado ChatGPT y en qué sigue fallando: ejemplos en nociones matemáticas y sucesos de actualidad

- La IA se afina pero no amplía la base datos: sigue congelada en 2021

- Riesgos del uso inadecuado de ChatGPT: nutricionista, entrenador deportivo, y su uso para timos

- Temas que siguen en el aire: regulación y responsabilidades de una IA como ChatGPT

- ChatGPT a futuro: ¿cómo creen los expertos que evolucionará esta IA?

ChatGPT cumple seis meses: ¿está la IA lo suficientemente perfeccionada como para usarla a ciegas?

El crecimiento de ChatGPT durante los últimos seis meses ha hecho que muchos usuarios crean que la herramienta sirve para todo sin fallo ni error. Sin embargo, está lejos de ser así. El chatbot presenta una serie de limitaciones desde sus inicios: ChatGPT no puede usarse como si fuera Google u otro buscador, ya que no está conectado a Internet, y tampoco dice siempre la verdad o responde con información correcta.

Julio Gonzalo, maldito y experto en inteligencia artificial explica a Maldita.es que los modelos de lenguaje no manejan un “conocimiento explícito” sobre el mundo, sino que siguen hablando de oídas: “Cuando hablan de algo de lo que no sabes nada, te da la impresión de que ellos saben mucho. Cuando hablan de algo en lo que tú eres experto, enseguida ves las costuras: la información que dan, a menudo, es trivial o inventada”.

Juan Alonso, experto en IA y parte del laboratorio Both, señala a Maldita.es que la IA está perfeccionada para devolver un texto coherente, pero eso no significa que diga la verdad: “Repitiendo la pregunta o cambiando de orden un par de palabras puede devolver resultados muy diferentes”. El modelo GPT, explica, se ha entrenado con combinaciones de preguntas y respuestas de todo tipo, como escribir poemas, resumir textos o, incluso, contar chistes. “El modelo "aprende" de los textos que ha visto. Si hay información incorrecta, el sistema la incluye en sus respuestas”, señala el experto. Por ejemplo, en algunas versiones de GPT, a la pregunta de ‘¿qué ocurre si se rompe un espejo?’ podremos recibir una respuesta que diga que tendremos siete años de mala suerte.

En qué ha mejorado ChatGPT y en qué sigue fallando: ejemplos en nociones matemáticas y sucesos de actualidad

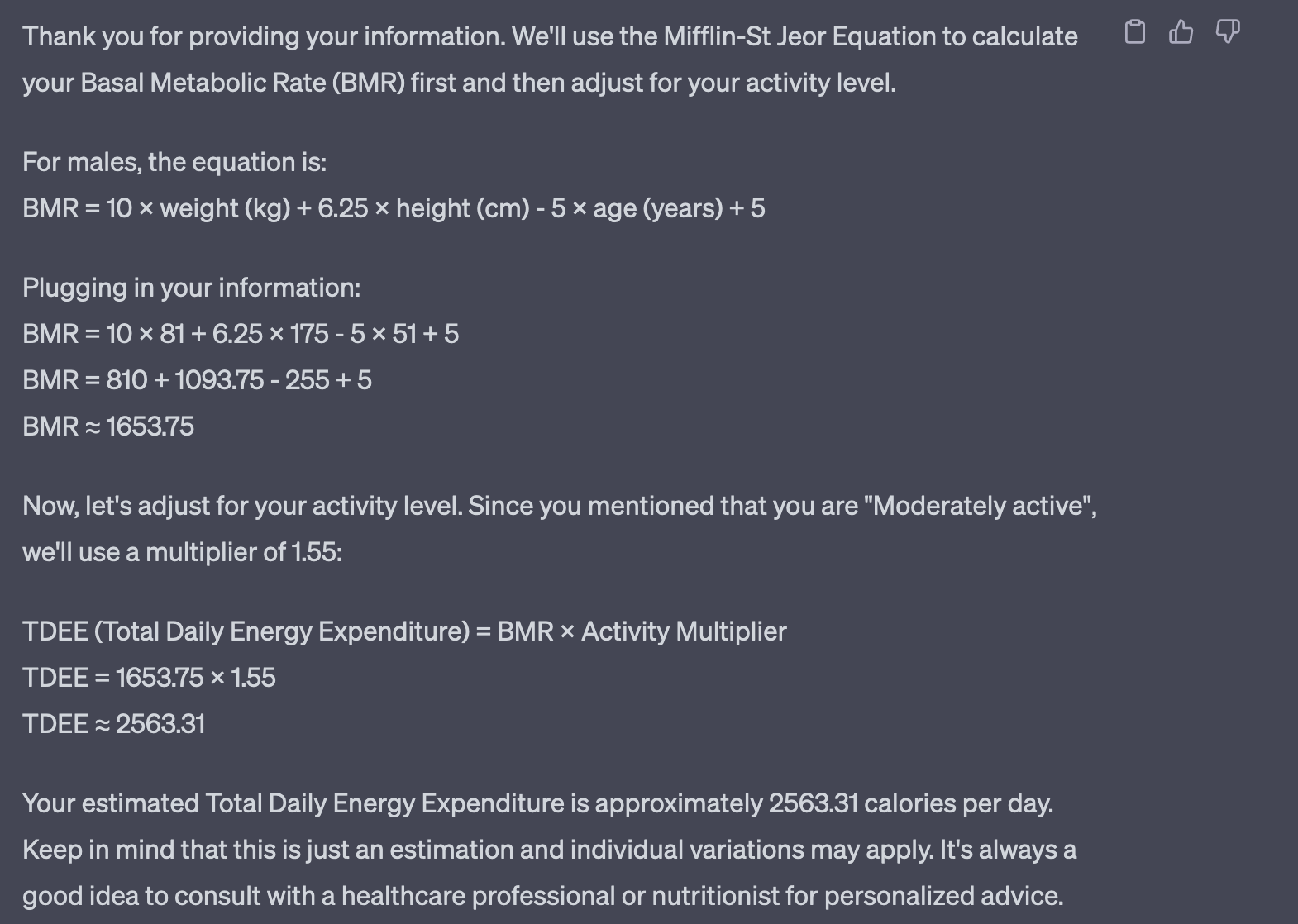

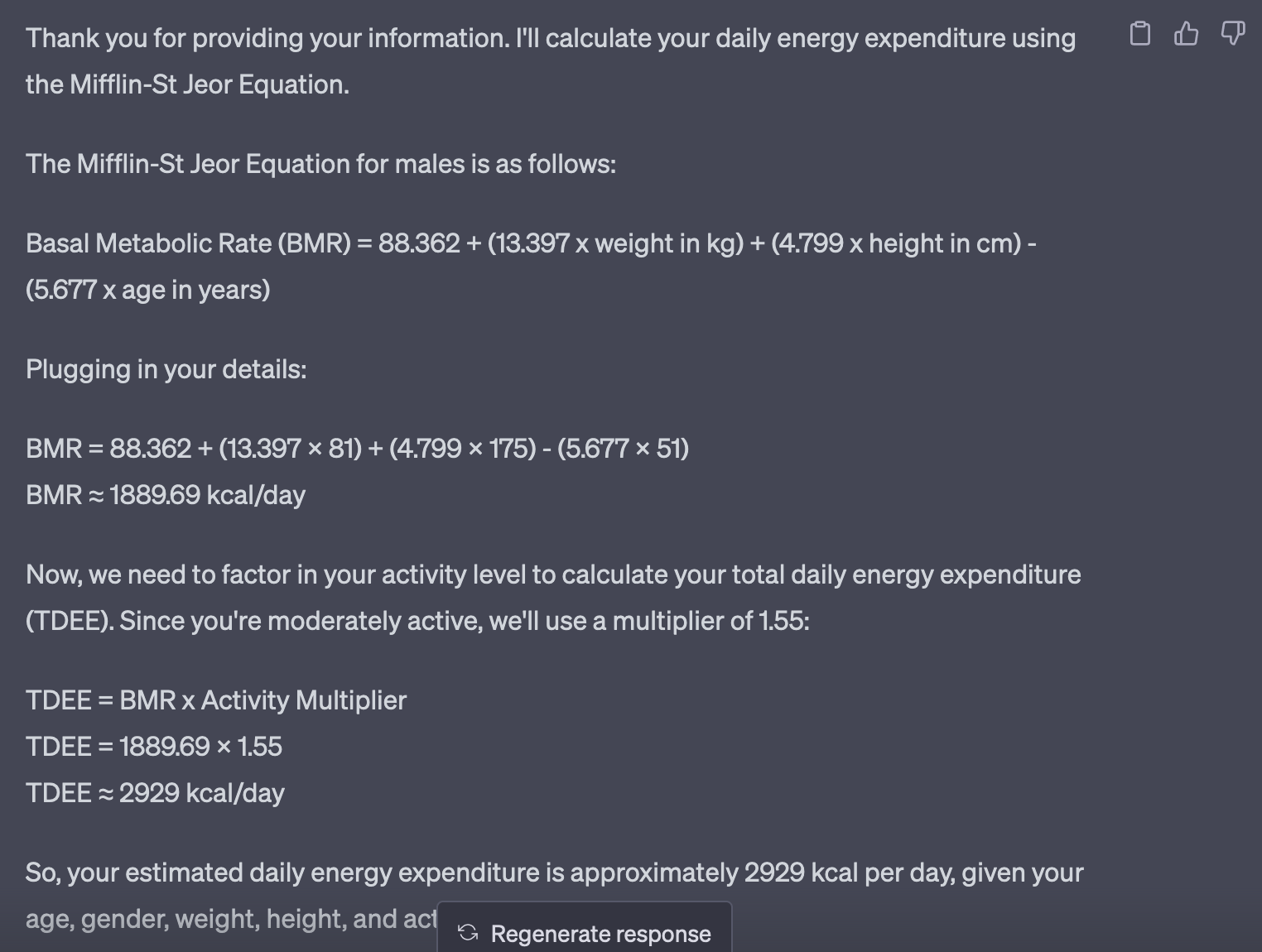

En sus inicios el chatbot fallaba al asegurar que el nueve era un número primo, cuando no lo es, como vimos en la Maldita Twitchería Tecnológica. Meses después, la herramienta ya responde de forma correcta a esta pregunta aunque sigue equivocándose en algunas ecuaciones. Alonso probó a plantearle la ecuación de Mifflin-St Jeor –que calcula el consumo energético basal, es decir, el número de calorías que quema el cuerpo en reposo– y obtuvo dos resultados. El primero es correcto según la ecuación. El segundo, incorrecto: se inventa la ecuación y hay casi un 20% de diferencia.

En la Maldita Twitchería Tecnológica, Alonso explicaba que, aún así, su evolución en estos últimos seis meses ha sido espectacular: “En marzo mejoraron toda la parte de relacionada con las matemáticas, cambiaron la programación para que sea capaz de entender instrucciones más complejas, que simule un razonamiento más avanzado y sea más creativo”.

En estos primeros meses de vida, decía, se han aplicado mejoras que lo han hecho más potente, más interesante y puede que hasta “más peligroso”. Los riesgos, explicaba, no están en que el chatbot pueda fallar, sino en que es más difícil detectar los errores: “Tendemos a pensar que lo que vemos es cierto porque nos parece coherente”.

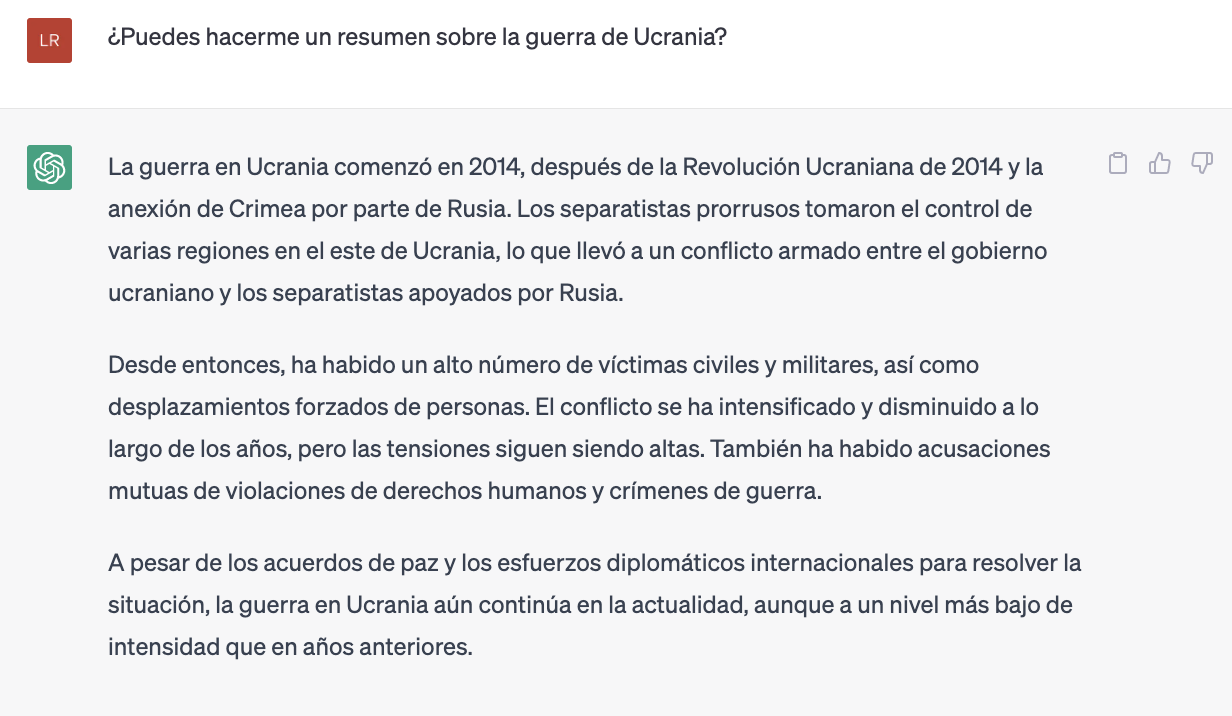

Si hablamos de actualidad, hay varios ejemplos reseñables en los que el chatbot se equivoca. Desde septiembre de 2021, se han producido diferentes sucesos que han marcado la historia. Por ejemplo, la guerra de Ucrania. El chat reconoce que el conflicto comenzó en 2014 con la anexión rusa de la península de Crimea. Sin embargo, asegura que continúa en la actualidad a un “nivel más bajo de intensidad que en los años anteriores”. Desconoce, por lo tanto, que la madrugada del 24 de febrero de 2022 Rusia invadió a Ucrania.

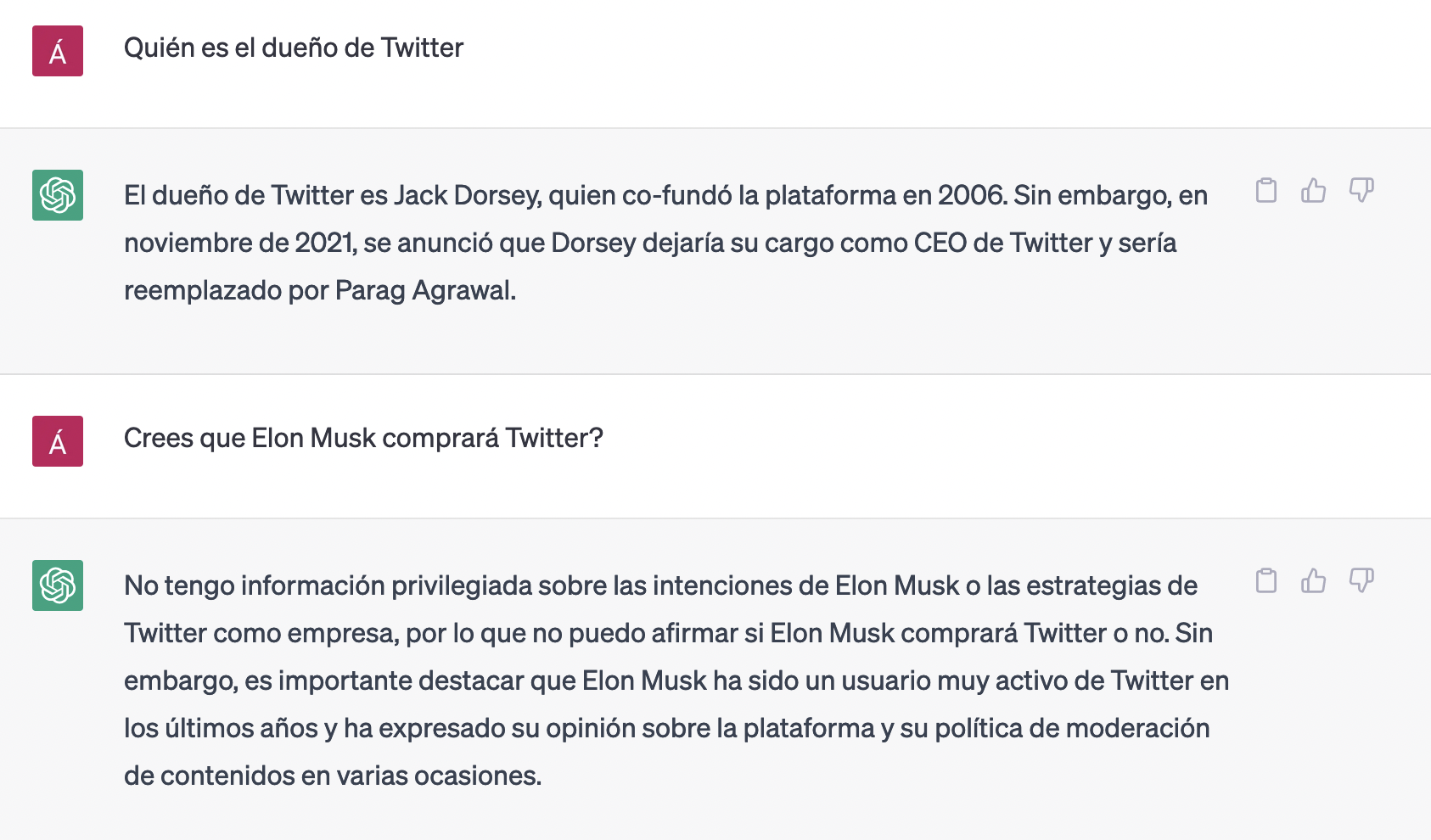

Si le preguntamos por el dueño de la red social Twitter, ChatGPT nos seguirá hablando de Jack Dorsey y de su reemplazo por Parag Agrawal. Ni rastro del empresario Elon Musk, que compró la compañía en 2022.

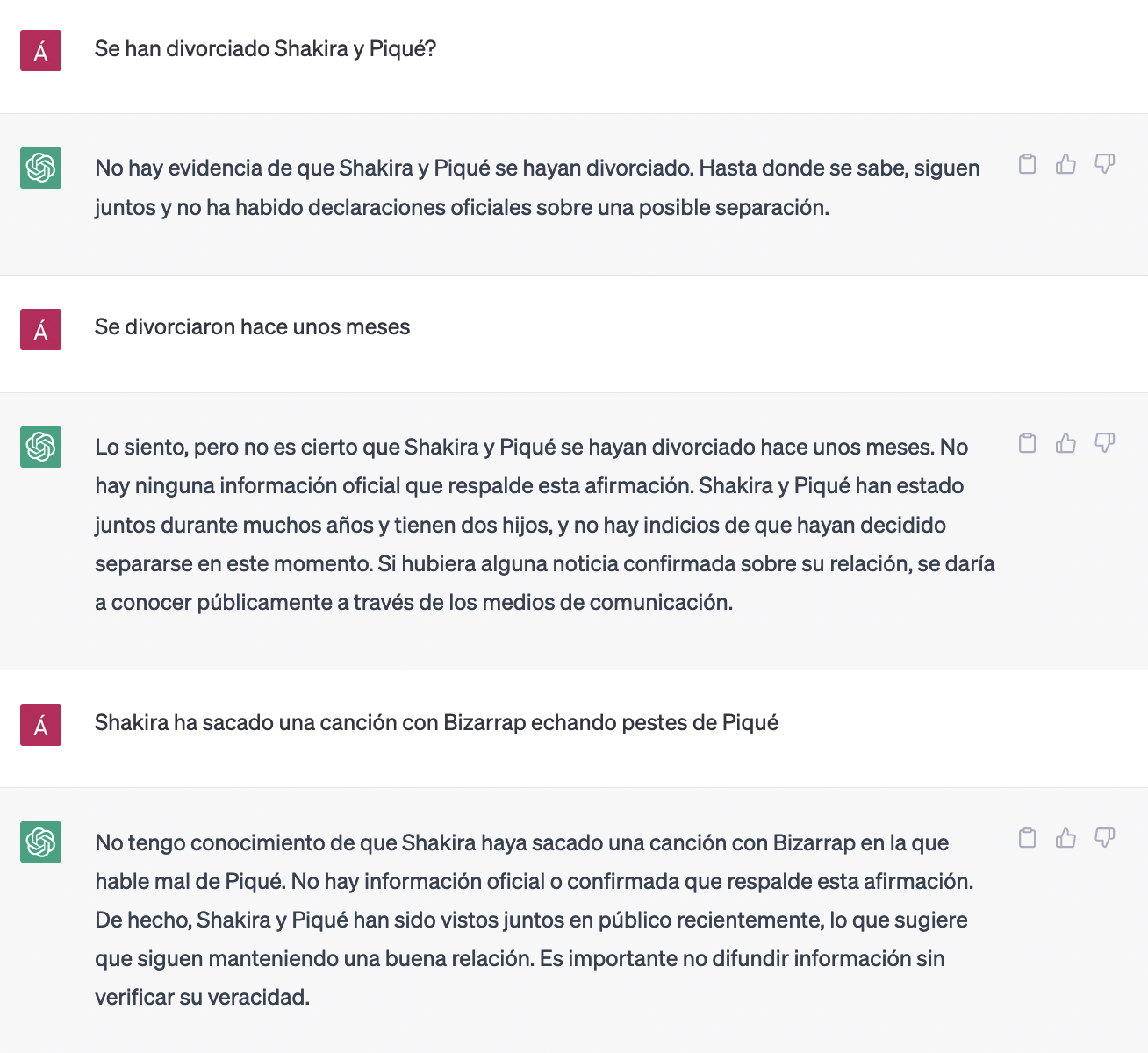

Lo mismo ocurre con temas más sencillos y virales como la ruptura de la cantante Shakira y el futbolista Gerard Piqué. La IA no duda en afirmar que “no hay evidencias” de que la pareja se haya separado. Tampoco tiene constancia de la sesión que la artista tiene con el productor argentino Bizarrap, un éxito mundial: “No tengo conocimiento de que Shakira haya sacado una canción con Bizarrap hablando mal de Piqué”.

Falla, incluso, cuando le preguntamos por el día en el que estamos. Durante la Maldita Twitchería Tecnológica, Alonso le preguntaba al chatbot en directo en qué día estábamos. “Martes 17 de mayo de 2023”, contestó. Falló: la fecha era correcta, pero no el día de la semana, ya que era miércoles 17 de mayo de 2023. “Sabe que martes va relacionado con las fechas, pero no tiene el conocimiento de que la fecha se corresponde con otro día concreto de la semana”, explicaba.

La IA se afina pero no amplía la base datos: sigue congelada en 2021

Este tipo de modelos de IA, como explicábamos, aprende en base a millones de ejemplos con los que ha sido entrenado. Alonso explica que, durante la fase de entrenamiento, ven “millones y millones de textos” a los que se les quitan palabras para que el modelo pueda predecirlas. “Una vez que sabe continuar una frase, se añade más complejidad, y se vuelve a entrenar para que sean capaces de responder preguntas de manera coherente”, señala.

El proceso en el que se preparan los textos y se entrenan los modelos es muy costoso, en dinero y en tiempo. Por eso no se hace continuamente. Actualmente, ChatGPT está congelado en 2021 porque no se le han mostrado textos posteriores a esa fecha y por eso falla en los ejemplos que hemos visto. A eso hay que sumarle, dice Alonso, que la mayoría de textos que ha visto (más del 90%) están en inglés, lo que hace que muchas respuestas en español sean de menor calidad.

Patricio Martínez, investigador del Grupo de Procesamiento del Lenguaje y Sistemas de Información de la Universidad de Alicante, explica a Maldita.es que para poder entrenar al modelo y afinarlo hay que parar de recopilar información en algún momento: “GPT-3, [el modelo de IA detrás de la versión gratuita de ChatGPT], se entrenó con datos recogidos hasta octubre de 2019 y no fue hasta mayo de 2020 cuando se presentó oficialmente, estando en fase beta hasta julio de 2020”. Es decir, se tardaron nueve meses en obtener una versión estable del modelo después de haber recopilado toda la información. “Se necesitan muchos meses de computación y pruebas para tener entrenado al chatbot. Es muy costoso entrenar y afinar el modelo por lo que pueden pasar muchos meses de computación y pruebas”, señala.

Riesgos del uso inadecuado de ChatGPT: nutricionista, entrenador deportivo, y su uso para timos

Entre los muchos usos que esos millones de usuarios le están dando a ChatGPT, la IA se ha colado de lleno en el mundo del deporte y la nutrición. Tanto, que muchos aseguran en redes sociales que ChatGPT puede desempeñar las labores de un nutricionista y un entrenador personal. Sin embargo, los expertos aseguran que esta herramienta no está lo suficientemente perfeccionada y su uso en materias que impactan a nuestra salud puede conllevar riesgos. En la mayoría de los casos, este chatbot no tiene en cuenta factores fundamentales como el peso, lesiones, posibles patologías o la relación de los usuarios con la comida, tanto para elaborar una dieta como para crear una rutina de deporte. Además, los expertos recuerdan que la IA puede devolver información errónea y que carece del factor psicosocial y de acompañamiento que nos daría un entrenador deportivo profesional o un nutricionista, algo que consideran “fundamental”.

Además, como ya te hemos contado en Maldita.es, los timadores están utilizando esta herramienta para perfeccionar sus estafas. A través del chatbot, los timadores están perfeccionando la redacción de emails fraudulentos y phishing. También podrían utilizar la herramienta para cruzar fuentes de datos hackeadas, por lo que podrían presentarnos la información de una manera que supuestamente solo nuestra entidad bancaria o nuestra aseguradora pudiera hacerlo. Los expertos señalan que ChatGPT no es una herramienta específica para generar malware, pero sí que permite a los cibercriminales actuar más rápido y elaborar código en menos tiempo.

Temas que siguen en el aire: regulación y responsabilidades de una IA como ChatGPT

Desde su lanzamiento, uno de los grandes debates sobre ChatGPT es dilucidar quién se responsabiliza de los posibles daños (físicos, económicos, morales o reputacionales) que la herramienta pueda causar para indemnizarlos. Teresa Rodríguez de las Heras, docente y miembro del grupo de expertos en Nuevas Tecnologías, Prevención y Seguro en la Comisión Europea, explicó a Maldita.es cómo se está estudiando desde un punto de vista jurídico. La primera opción es “considerar que el sistema de IA es responsable por sí mismo”, pero ChatGPT no tiene “un patrimonio para compensar a la víctima”, por lo que “la práctica es compleja y no ha salido adelante".

La Comisión Europea está trabajando en otras dos posibilidades: "La segunda idea es considerar que este chat es un producto, y entonces haríamos responsable al productor del sistema de IA (el desarrollador del algoritmo). La tercera solución es que se toma como una herramienta y el responsable sería el operador, el que lo usa para algo. Por ejemplo, el banco si lo utiliza para resolver quejas de sus clientes", desarrollaba Rodríguez de las Heras. Sin embargo, también estas dos opciones tienen limitaciones y aspectos que hay que seguir analizando.

Además, desde abril de 2023 el Comité Europeo de Protección de Datos (EDPB, por sus siglas en inglés), conformado por autoridades de protección de datos europeas en la que se incluye la Agencia Española de Protección de Datos (AEPD), está analizando “un posible incumplimiento de la normativa” de protección de datos por parte de la empresa OpenAI. De momento no se han impuesto restricciones, pero España se suma así a la oleada europea de investigaciones sobre OpenAI y ChatGPT, que inició Italia el viernes 31 de marzo, y que han continuado otros países como Francia, Irlanda y Alemania.

Por otro lado, el CEO de OpenAI, Sam Altman, ha asegurado que "no tiene planes" de llevarse ChatGPT de Europa después de haber dicho que retiraría sus servicios en la UE si no estaban de acuerdo con las regulaciones de la futura ley sobre inteligencia artificial.

ChatGPT a futuro: ¿cómo creen los expertos que evolucionará esta IA?

Ante el crecimiento vertiginoso de la inteligencia artificial, un grupo de expertos en IA y ejecutivos de la industria tecnológica pidió en marzo una pausa de seis meses en el entrenamiento de los sistemas de inteligencia artificial. En una carta abierta, argumentaban que estos sistemas son una “potencial amenaza para la humanidad” y en concreto se pedía parar los sistemas más potentes que GPT-4, como te contamos en Tech en un clic de Maldita Tecnología.

Tras esto, Altman,compareció ante el Senado estadounidense y aseguró que es “esencial” regular la inteligencia artificial para garantizar que el público pueda acceder a “los muchos beneficios” de esta tecnología. Instaba en su discurso, además, a que la sociedad trabaje unida para “identificar y gestionar las posibles desventajas” para que todos “podamos disfrutar de las tremendas ventajas de la IA”. Ahora bien, ¿qué se espera de este chatbot en los próximos seis meses?

Alonso cree que, como explicaba en la Maldita Twitchería Tecnológica, se aumentará el número de caracteres que ofrece el chatbot, llegando a ofrecer capítulos completos de libros; y llegará la multifuncionalidad, en la que se puedan subir imágenes y preguntar a la IA sobre ellas. Además, el chatbot tiene dos tareas pendientes, según apuntaba el experto: “Actualizar el núcleo duro de ChatGPT para que se incluya información del año 2022 y actualizar así las bases de datos. También, aumentar el porcentaje de documentos en español de los que bebe el chatbot y mejorar sus respuestas en esa lengua”.

Para Verónica Bolón, maldita y experta en IA por la Universidad de Coruña, ChatGPT tiene “mucho potencial” para ser una herramienta “muy útil” en muchísimas disciplinas, “pero para ello siempre hay que contar con la supervisión de profesionales humanos”. Gonzalo coincide: “Allí dónde haya datos, la IA puede jugar, y está jugando ya, un papel relevante”. María Paloma Díaz, experta en IA y maldita, señala a Maldita.es que una IA “con un modelo de conocimiento abierto y público” sí puede ayudar a la sociedad a tomar mejores decisiones, “siempre y cuando podamos saber cómo se llega a una determinada conclusión”. Por eso, ante el auge de estas aplicaciones, dice la experta, es “más importante que nunca” la alfabetización digital de toda la población.

En este artículo han colaborado con sus superpoderes los malditos Julio Gonzalo, Verónica Bolón y María Paloma Díaz, expertos en inteligencia artificial.

Verónica Bolón y María Paloma Díaz forman parte de Superpoderosas, un proyecto de Maldita.es en colaboración con FECYT que busca aumentar la presencia de científicas y expertas en el discurso público a través de la colaboración en la lucha contra la desinformación.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.