¡Feliz sábado, malditas y malditos! ¿Te has enterado de lo nuevo de la empresa que creó ChatGPT? Pues sigue leyendo que te lo contamos, junto a otros temas de actualidad tecnológica de esta semana.

Por cierto, la semana que viene en la Maldita Twitchería Tecnológica vamos a hablar de cómo se aplica la ética a la inteligencia artificial (IA), y de cómo nos afecta que no se tengan en cuenta principios éticos en la tecnología. ¿Tienes alguna pregunta sobre este tema? Envíanosla a [email protected] y la contestaremos en directo en Twitch el miércoles 22 de marzo, a las 12:55h.

GPT-4, una nueva y espectacular IA… pero cerrada

OpenAI ha presentado la siguiente evolución de su inteligencia artificial: si ChatGPT estaba impulsado por GPT-3.5, ahora ya está aquí GPT-4, un modelo de IA aún más avanzado y potente. En Xataka explican cómo funciona y en qué se diferencia del anterior.

En redes sociales hay opiniones de todos los colores: que lo de GPT-4 es otro gran salto, un hito de la tecnología, y que quien no se suba al carro se quedará muy atrás, o que ya vale con el hype y que nos calmemos. Para ir echando un vistazo, en apenas horas ya había un montón de usuarios compartiendo sus experimentos con esta nueva inteligencia artificial: estrategias específicas de SEO y guías de viaje, recreaciones de juegos creadas en segundos, y escribir código o texto legal afinado. Dot CSV también lo ha analizado en un directo.

Pero hay una cosa que hay que destacar, como recogen en ElDiario.es: ya no es gratuito ni de código abierto. GPT-4 será un programa de pago (no como ChatGPT) y OpenAI ha anunciado que no va a revelar detalles técnicos. La carrera por la inteligencia artificial en forma de chatbot conversacional sigue añadiendo estrategias.

Errores y responsabilidades de un chatbot

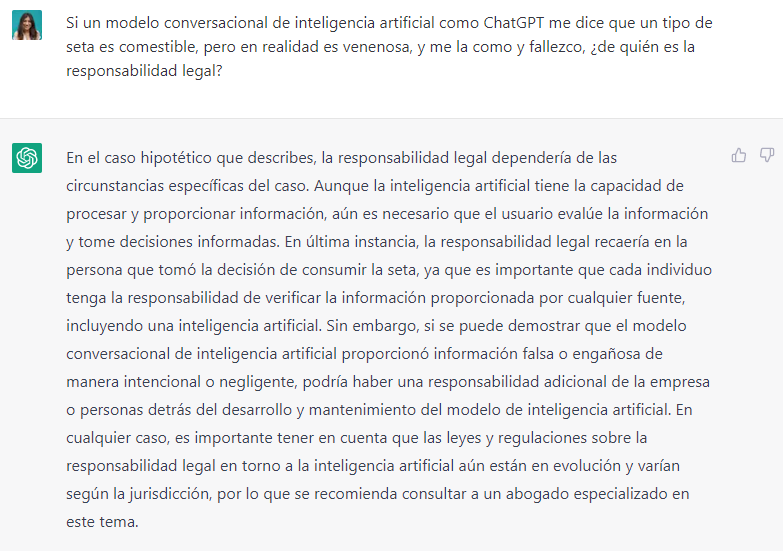

No es solo cosa de un coche autónomo o de un robot: los modelos conversacionales de inteligencia artificial, como ChatGPT, también pueden ocasionar daños. ¿Qué pasa si aconsejan no vacunarse, dan información errónea que acabe en un daño físico (recomiendan una seta que es venenosa, por ejemplo), económico (dicen que van a bajar los precios de las casas) o moral (dañan la reputación de alguien), o incitan a la violencia? En esas situaciones, habrá casos en los que se deba indemnizar a las víctimas, pero de momento no hay una normativa jurídica clara al respecto.

La Comisión Europea trabaja con varios escenarios para analizar quién sería el responsable. ¿El propio chatbot como persona electrónica, la empresa y personas que la han programado, las personas que la usan…? Explicamos los distintos escenarios que se plantean y qué variables se podrán tener en cuenta.

También lo puedes escuchar en nuestra sección en Nunca es Tarde de Aragón Radio con la ayuda de las expertas Teresa Rodríguez de las Heras, Elena Gil y… el propio (o la propia) ChatGPT, que nos dijo que la culpa en primer lugar es tuya si te comes una seta que te ha recomendado.

Machismo en TikTok

“No dejaría que mi mujer tuviera Instagram a no ser que sea un negocio para ella y gane mucho dinero” o “Tener cuenta en redes sociales es de buscona” son algunos de los comentarios que hemos visto en algunos vídeos de TikTok. Estos vídeos con actitudes controladoras y posesivas son ejemplos de machismo en el plano digital: si la mujer antes tenía que quedarse en la cocina, sin salir de casa ni relacionarse, ahora no puede salir en las redes sociales.

Las psicólogas y sociólogas que hemos consultado nos han explicado que estas actitudes machistas de control pueden ser indicativos de violencia de género y que, al ser públicas, validan y refuerzan a otros hombres que piensen así. Por su parte, las normas de TikTok dicen que no se pueden promover actitudes misóginas en la plataforma, pero ahí siguen los vídeos; algunos en cuentas con más de un millón de seguidores.

En tres bits

Datos alarmantes en Tinder. Casi el 57,9%. Es el porcentaje de usuarias de Tinder que se han sentido presionadas por su cita para tener relaciones sexuales. Hasta un 21,7 % asegura que ha sufrido una agresión sexual con violencia. Son datos del estudio ‘Apps Sin Violencia Sexual’, que también recoge que estas apps se usan como lugar de captación de mujeres para la prostitución. El País resume los datos del informe.

Imágenes de la Luna “falsas”. Sí, sí y sí: no hay duda de que el ser humano sí llegó a la Luna (diez pruebas y datos para los que todavía duden). Pero de lo que puede que tengamos que empezar a dudar es de cómo fotografía al satélite nuestro móvil. En The Verge analizan cómo el procesamiento que aplican las cámaras de Samsung pueden desdibujar la línea entre lo real y las imágenes falsas mejoradas con inteligencia artificial.

Midjourney y las nutrias usando un ordenador. Hablando de imágenes creadas con inteligencia artificial, esta semana Midjourney (programa de IA para generar imágenes a partir de instrucciones en texto) se ha actualizado y ha dado un salto en la calidad de las imágenes que ofrece. Aquí te dimos consejos para que no te la cuelen con esta tecnología.

Estamos preparando este contenido para que lo puedas recibir en tu correo. Si te apetece, puedes suscribirte aquí a la Newsletter Tech en un clic de Maldita Tecnología.

¿Tienes dudas sobre el día a día online? ¿Hay algún tema del mundo de la tecnología que te genere curiosidad y sobre el que te gustaría que ampliáramos información? ¿Quieres compartir algún tema interesante con la comunidad maldita? ¡Escríbenos a [email protected]!