O en otras palabras: ¿cuándo llegará ese avance tecnológico que las empresas llevan años prometiendo? Un ejemplo es el de Tesla y su presidente, Elon Musk, que hasta hace poco aseguraba que para 2020 habría “robotaxis” prestando su servicio a la gente.

Un coche autónomo es aquel que incorpora funciones automáticas basadas en programas informáticos que conducen por las personas. Esos amagos de taxis sin chófer todavía no son una realidad, así que hemos preguntado a especialistas el por qué.

Las diferencias de regulación entre Europa y China o Estados Unidos

La primera razón es que no es lo mismo hablar de conducción autónoma en Europa que en Estados Unidos o China, donde el mercado es más experimental y no hay tanta regulación: “Europa es mucho más conservadora a la hora de permitir que las tecnologías salgan a la calle”, asegura a Maldita Tecnología Javier Riesco, ingeniero mecánico especializado en asistencia a la conducción autónoma, quien además nos ha prestado sus malditos superpoderes.

Como ejemplo de esa diferencia, señala una normativa propuesta este año por la ONU para limitar la conducción autónoma a menos de 60 kilómetros por hora y en entornos restringidos (sin peatones o ciclistas cerca): “50 países, entre ellos los europeos, han firmado dicho reglamento pero EEUU y China de momento se mantienen al margen”.

Eso no significa que si vas a Estados Unidos o a China puedas pedir un coche sin conductor para desplazarte por una ciudad: es más, el conductor de un vehículo autónomo con el que experimentaba Uber en Arizona y que atropelló y mató a una mujer se enfrenta ahora a cargos de homicidio. En China, por ejemplo, se han estado utilizando durante la pandemia para hacer repartos: los que funcionan en ciudades tienen los mapas “memorizados” y se mueven por ellas siguiendo un recorrido constante.

La inteligencia artificial todavía no está preparada

El segundo motivo es que las limitaciones técnicas aún son muy significativas: “Hay cinco niveles de conducción autónoma, siendo 0 el vehículo sin asistencia y 5 el completamente autónomo (también llamado ‘robotaxi’): actualmente en el mercado europeo se venden vehículos hasta nivel 3”, explica Riesco.

Esto significa que el coche no llega a ser “autónomo” durante el tiempo total que está en funcionamiento, sino que incorpora algunas funciones que asisten a la conducción de manera automática: por ejemplo, la frenada de emergencia o el mantenimiento de carril. A partir de ahí, según Riesco, es necesario integrar sistemas de inteligencia artificial (IA) y análisis de datos para que el vehículo pueda interpretar más información.

La clave está en que estos elementos, que son imprescindibles para que se pueda avanzar, no están aún listos para ‘dejarlos solos’ porque no han llegado al “nivel humano de fiabilidad en su toma de decisiones, su previsión y su percepción”, mientras que su precisión “no es suficiente en condiciones difíciles, como una meteorología desapacible”, según cita un estudio del MIT sobre conducción autónoma.

“Se ha confiado mucho en el deep learning, una tecnología que ha permitido mejorar el manejo de bases de datos masivas y que las acumula para realizar sus abstracciones y sus modelos matemáticos y deducir cómo se conduce, pero sigue siendo una actividad muy humana”, detalla Julián Estévez, profesor e investigador de Robótica e Inteligencia Artificial en la Universidad del País Vasco.

“Hay muchos escenarios en los que los humanos utilizamos la intuición y la comunicación no verbal y que son difíciles de programar, por esta razón de momento estos sistemas se limitan a entornos más predecibles como autopistas”, explica Riesco.

Con él coincide al completo Estévez, que asegura que en las autopistas es donde mejor se han dado las pruebas con estos vehículos gracias a su continuidad lineal, la poca interacción con personas e incluso el hecho de que las marcas de la carretera estén bien señalizadas en la mayoría de los casos.

Observa más factores que la IA aún no es capaz de interpretar: costaría mucho traducir al “lenguaje máquina” señales que conocemos los humanos como el apartarnos a la derecha si vemos que otro coche tiene intención de adelantar, o cosas más complicadas como intuir que un coche tiene que cambiarse in extremis de carril porque se le pasa la salida.

La complejidad ética en caso de que el coche tenga que responder en un accidente

El coche autónomo se lleva ideando desde mucho antes de lo que pensamos: en la década de los 40 y los 50 ya se plantea este modelo en Estados Unidos como solución a los accidentes letales, como presenta este estudio sobre su contexto histórico, pero ya ahí se planteaba como una especie de “coche fantástico” más parecido a lo que vemos en las películas y del que los especialistas coinciden en que estamos lejos.

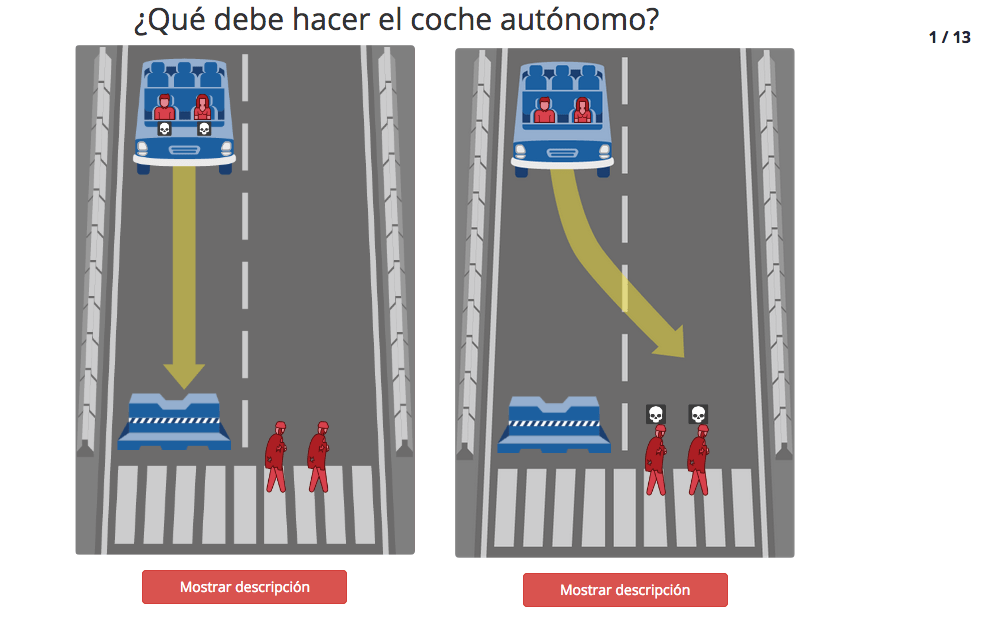

En tercer lugar, la implantación de esta tecnología no solo depende de las capacidades que puede tener o dejar de tener a nivel técnico, sino de las limitaciones legislativas y éticas que la acompañan. ¿Quién decide lo que debe hacer un coche autónomo en una situación de riesgo? ¿A quién se culpa de un accidente? ¿Al conductor, a la empresa, a los ingenieros que han desarrollado el programa…?

Si tienes claro lo que elegirías tú, puedes ponerlo a prueba en el simulacro ideado por el Massachussets Technology Institute (MIT) para abordar este tipo de experimentos desde el punto de vista ético: la Máquina Moral.

Primera fecha de publicación de este artículo: 25/09/2020.

En este artículo ha colaborado con sus superpoderes el maldito Javier Riesco, ingeniero mecánico especializado en asistencia a la conducción autónoma.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.