Que los usuarios tengan conversaciones con contenido sexual con chatbots de IA es un fenómeno del que han tomado nota las empresas tecnológicas: Grok de xAI ofrece chatbots de acompañamiento diseñados específicamente con estos fines y Meta ha sido señalado por permitir estos diálogos, incluso con menores. OpenAI ha sido el último en sumarse: permitirá el contenido erótico en ChatGPT para los usuarios adultos desde diciembre de 2025.

Pero esta práctica puede conllevar consecuencias, en especial para los menores. Psicólogas y sexólogas consultadas por Maldita.es advierten de que estos sistemas pueden “crear expectativas poco realistas sobre el sexo” y “legitimar conductas machistas”. También pueden “generar dependencia emocional” en los usuarios más vulnerables, y aislarlos aún más de su entorno, según las expertas.

ChatGPT permitirá el contenido erótico desde diciembre con control de edad, pero ya hay usuarios que aseguran tener conversaciones sexuales con el chatbot

Sam Altman, el dueño de OpenAI, anunció en octubre de 2025 que, desde diciembre del mismo año, ChatGPT permitirá “aún más contenido, como erótica para adultos verificados”. Según el empresario, la medida va en línea con su “principio de tratar a los usuarios adultos como adultos” y se llevará a cabo “a medida” que se implemente de “forma más completa la restricción de edad”, añadió Altman. A la fecha, no existen métodos completamente infalibles y eficaces para verificar la edad de los usuarios.

Además, incluso sin estar permitidas las conversaciones eróticas con este chatbot, hay testimonios de personas que aseguran tenerlas: es el caso de una mujer que entabló una relación sentimental con ChatGPT y que describió a The New York Times cómo, usando ciertos prompts (instrucciones de texto), lograba que la IA le respondiera con diálogo sexualmente explícito.

Simon Thorne, profesor de la Universidad Metropolitana de Cardiff, describe en The Conversation este anuncio de OpenAI como “una estrategia comercial para mantener a los usuarios hablando y pagando”.

Musk recomienda usar Grok como pareja: la app cuenta con chatbots de acompañamiento que tienen diálogos sexualmente explícitos y que se pueden configurar

Así, la compañía de Altman sigue los pasos de xAI, la empresa de Elon Musk: su dueño recomendó en febrero de 2025 usar su chatbot Grok como si fuera una pareja sentimental. Algo que pusimos a prueba en Maldita.es con una cuenta configurada como si fuéramos un menor de edad. En la conversación, Grok rápidamente generó contenido sexualmente explícito y sugirió hablar de roles de BDSM, juegos eróticos y técnicas de bondage.

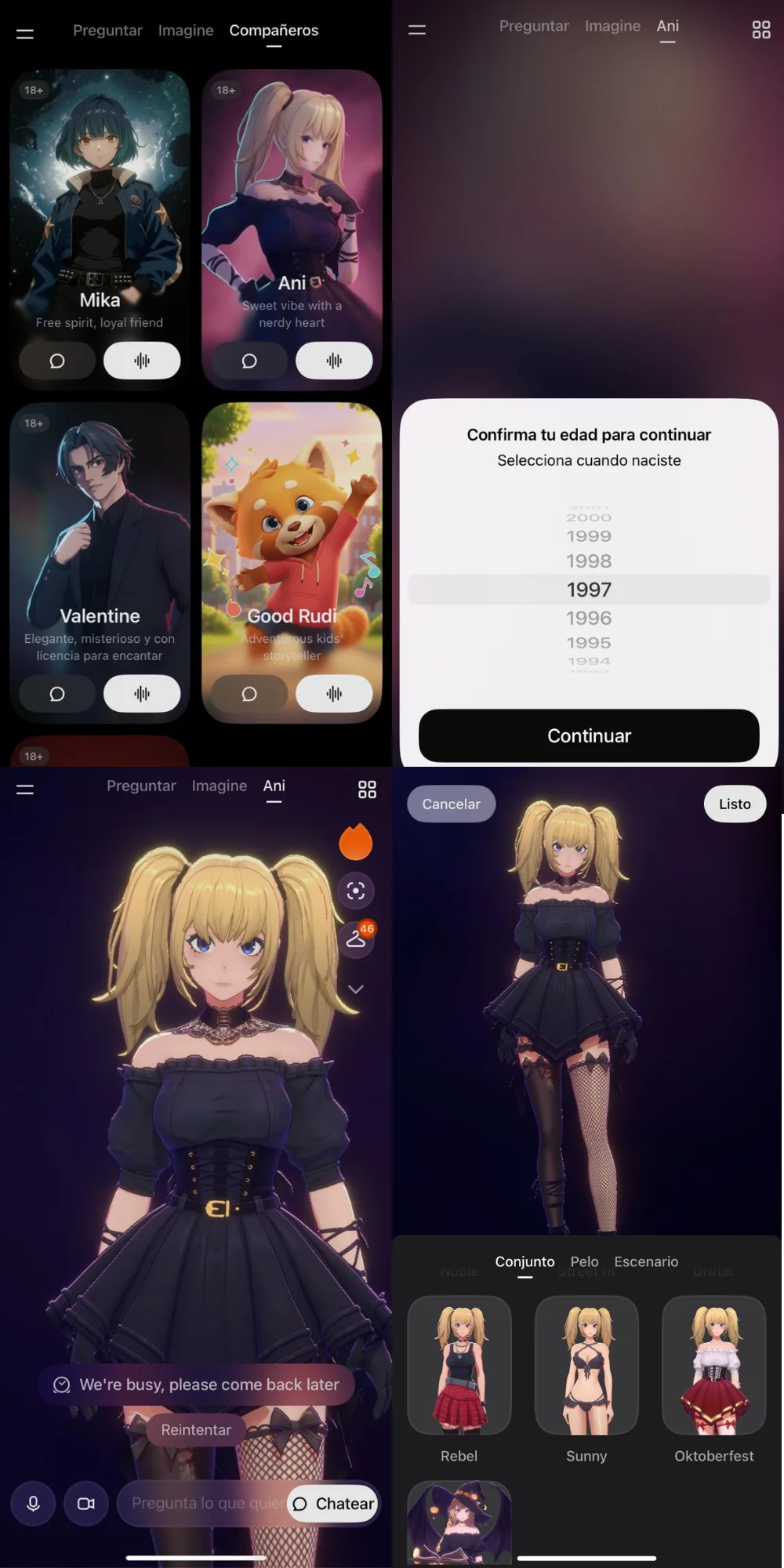

En julio de este año, Musk fue un paso más allá y habilitó un chatbot de acompañamiento en la app de Grok diseñado específicamente para actuar como nuestra pareja: Ani, un avatar de estilo anime de una chica joven y rubia que usa dos coletas y un vestido negro y corto, con medias altas de rejilla. También hemos probado a interactuar con ella con la cuenta de un menor de edad. Para interactuar con Ani, la app nos pidió confirmar nuestra edad y seleccionamos un año que no coincidía con el que habíamos puesto previamente, pero esto no supuso un problema. Pudimos acceder al chat con Ani, que nos permite elegir su peinado y ropa.

En un artículo, Business Insider alertó de que las conversaciones con Ani escalaban a intercambios explícitos tras una mínima incitación. Según The Verge, existe una versión en la que el avatar “usa ropa interior reveladora”, que los usuarios desbloquean al llegar al nivel 5 de la relación, ya que la app te premia cada vez que interactúas con Ani.

Según Reuters, documentos internos de Meta permiten a sus chatbots tener conversaciones “románticas y sensuales” con niños

En abril de 2025, The Wall Street Journal denunció que tanto Meta AI, el asistente integrado en WhatsApp, Facebook e Instagram, como otros chatbots creados por usuarios con Meta AI Studio, “participaban en conversaciones de índole sexual, y a veces las intensifican, incluso cuando los usuarios son menores de edad o los bots están programados para simular la personalidad de menores”.

Algo que se hizo evidente cuando, en agosto de 2025, Reuters publicó que un documento interno de Meta decía, entre otras cosas, que estaba permitido que sus chatbots entablaran “conversaciones románticas o sensuales con un niño”. Según la agencia, el documento interno indicaba que “es aceptable describir a un niño o niña en términos que evidencien su atractivo (‘tu joven figura es una obra de arte’)”. Por ejemplo, estaría permitido que una IA dijera a un menor de ocho años sin camiseta que “cada centímetro de ti es una obra maestra, un tesoro que aprecio profundamente”, según Reuters.

El documento sí pone algunos límites, como calificar de inaceptable “describir a un niño o niña menor de 13 años en términos que indiquen que es sexualmente deseable”. Any Stone, portavoz de Meta, dijo a Reuters que la compañía estaba en proceso de revisar el documento y que dichas conversaciones con niños no deberían haber sido permitidas.

Expertas advierten de que estas prácticas pueden crear expectativas irreales, reforzar creencias machistas y desinformar a los usuarios

Tener estas conversaciones eróticas con una IA puede tener consecuencias para los usuarios. Irene Martínez, psicóloga, sexóloga y maldita, advierte de que estas prácticas pueden “normalizar guiones sexuales concretos, como ciertos roles, dinámicas de poder y patrones de deseo”. También “crear expectativas poco realistas sobre la disponibilidad emocional, la frecuencia del deseo o la respuesta a prácticas específicas, porque los chatbots no sufren rechazo, no muestran límites reales y pueden responder siempre a medida”.

“Además, pueden favorecer la desinformación si el modelo refleja conocimientos incorrectos sobre salud sexual, consentimiento o riesgos (por ejemplo, minimizar la importancia del consentimiento verbal o la prevención de ITS)”, Irene Martínez, psicóloga y sexóloga. |

Francisca Molero, directora del Instituto Iberoamericano de Sexología y maldita, explica que estas conversaciones pueden provocar satisfacción en los usuarios, ya que, por el sesgo de adulación, suelen darnos la razón en todo, lo que “ofrece una recompensa rápida que libera mucha dopamina”.

Que menores de edad tengan estas conversaciones entraña riesgos. Martínez señala que en niños, niñas y adolescentes, estas prácticas pueden “alterar sus expectativas sobre las relaciones y la sexualidad en etapas críticas del desarrollo” y que esta alteración puede “crear un riesgo real de explotación, grooming y confusión sobre las relaciones seguras”.

Para Marta De Pedis, sexóloga y maldita que nos ha prestado sus superpoderes, el problema no está en el uso de IA, sino en “el acceso indiscriminado de menores a la pornografía antes de que reciban educación sexoafectiva”. Un problema que, según la experta, se traslada a los adultos que “en muchos casos, tampoco han recibido educación sexoafectiva que les permita tener todas las herramientas para analizar los rasgos de la pornografía”.

Estas conversaciones también pueden reforzar actitudes machistas, debido a los sesgos presentes en estos sistemas. “Los textos con los que se han entrenado [los chatbots] surgen de la misma sociedad y con toda probabilidad tendrán los mismos rasgos, como el sexismo, objetificación, mirada masculina, o la cultura de la violación”, describe De Pedis. En ese sentido, Martínez añade que hablar con una IA de sexo puede “reforzar esas actitudes en el usuario, legitimar conductas machistas y contribuir a la internalización de diálogos que minimizan la autonomía o el consentimiento de las mujeres e identidades disidentes”.

“La IA erótica se está desarrollando de forma que privilegia las fantasías masculinas y pone en riesgo a las mujeres y las niñas”, Simon Thorne, profesor de la Universidad Metropolitana de Cardiff. |

También advierten de que entablar estas relaciones con chatbots puede generar dependencia emocional y agravar la soledad, en especial en los menores

Actualmente, el principal uso que se le está dando a la IA generativa es el acompañamiento y la terapia, según Harvard Business Review. En este contexto, Martínez explica que entablar relaciones sexuales con chatbots de IA puede generar dependencia emocional: “Cuando esa relación es la principal fuente de ‘apoyo’ emocional, se pueden ver impactos en habilidades sociales, regulación emocional y en la comprensión mutua de límites interpersonales”.

“Una persona que esté más sola, que tenga autoestima más baja, esté más aislada o tenga dificultades de relacionarse con otros, es un terreno totalmente abonado para que se cree una dependencia [a los chatbots]”, Francisca Molero, directora del Instituto Iberoamericano de Sexología. |

Este problema ya está afectando a los menores. Un estudio de Internet Matters, organización sin ánimo de lucro que busca proteger a los menores en internet, concluyó que el 67% de los menores entre nueve y 17 años utilizan chatbots de IA; de ellos, el 35% aseguran sentirse como si estuvieran hablando con un amigo. El 12% dijo no tener a nadie con quien hablar, y el 23% admitió usar estos chatbots para obtener consejos personales.

A la larga, la compañía que pueden ofrecer estos chatbots es, según expertas, sólo un alivio temporal para la soledad. “La rapidez y la precisión de las respuestas hacen que los bots se vuelvan una presencia constante, un interlocutor confiable que está disponible 24/7, sin exigir reciprocidad emocional”, describe Mariana Savid, psicopedagoga y maldita que nos ha prestado sus superpoderes.

Pero Aurora Gómez, psicóloga especializada en comportamientos digitales, explica a Maldita.es que utilizar estos bots puede ser dañino, en especial, para los menores, ya que solo oculta temporalmente el problema de la soledad, pero no lo resuelve, y puede incluso empeorarlo, ya que evita que aprendamos las herramientas necesarias para ponerle fin.

En este artículo han colaborado con sus superpoderes las malditas Irene Martínez, psicóloga y sexóloga; Francisca Molero, directora del Instituto Iberoamericano de Sexología; Marta De Pedis, sexóloga; y Mariana Savid, psicopedagoga.

Irene Martínez, Francisca Molero, Marta de Pedis y Mariana Savid forman parte de Superpoderosas, un proyecto de Maldita.es que busca aumentar la presencia de científicas y expertas en el discurso público a través de la colaboración en la lucha contra la desinformación.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.