El 18 de septiembre de 2023 varias madres de un instituto de Almendralejo (Badajoz) denunciaron la difusión de desnudos de sus hijas menores de edad creadas a través de inteligencia artificial (IA). Ha sucedido en otros lugares de España, como Alcalá de Henares. En Barcelona, un menor de 14 años ha sido detenido por modificar con inteligencia artificial fotos de niños para convertirlas en imágenes de contenido sexual. Los casos siguen: en junio de 2025, tres menores están siendo investigados en Puertollano por crear imágenes pornográficas de compañeras y profesoras con inteligencia artificial y difundirlas.

Este tipo de contenidos no sólo pueden vulnerar el derecho al honor o a la imagen personal, sino que en el caso de menores se puede tratar de un delito de pornografía infantil, independientemente de que no sean imágenes reales y hayan sido generadas con esta u otra tecnología. En caso de que seamos víctima de este tipo de imágenes creadas sin nuestro consentimiento, podemos acudir a la Agencia Española de Protección de Datos para solicitar su retirada, recabar todas las pruebas posibles y denunciar ante la Policía.

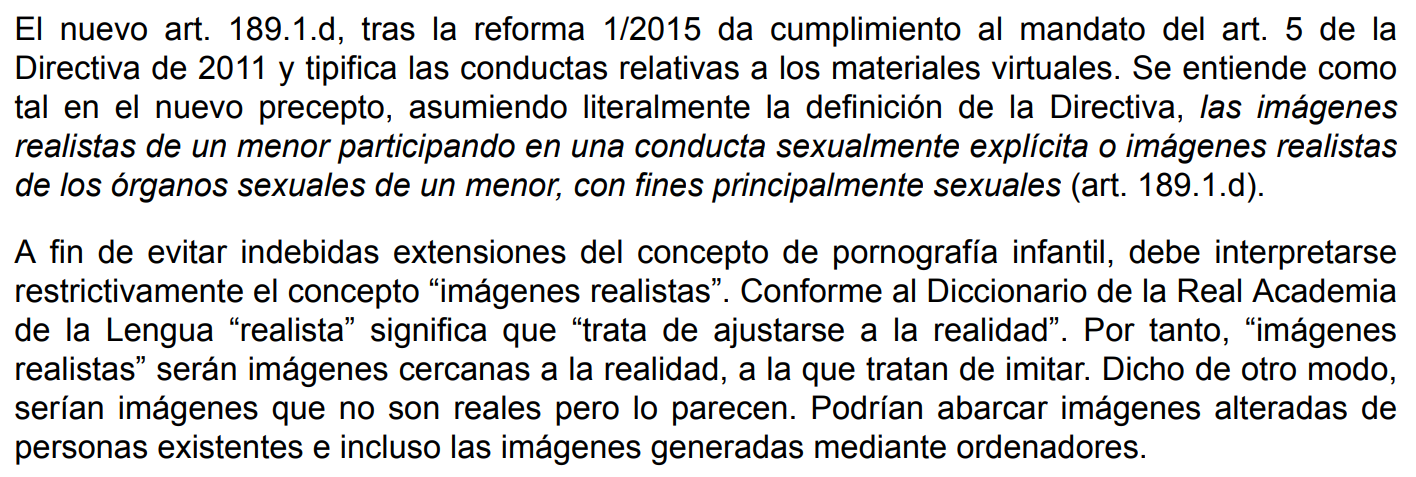

La Fiscalía General del Estado considera a las imágenes creadas por ordenador como pornografía infantil “virtual”

A raíz de diferentes casos de difusión de pornografía infantil creada con inteligencia artificial, han surgido varias dudas sobre si la creación de material sexual no consentido a través de esta tecnología está penada por la ley. En el caso de que seamos víctimas de este tipo de imágenes (sean creadas con IA o cualquier otro procedimiento), en España nos amparan diferentes derechos. La legislación española no regula en específico el uso de una tecnología en concreto (sea inteligencia artificial o un programa de edición de imágenes como Photoshop), sino que la normativa se centra en el daño que se hace a la persona.

Si alguien utiliza nuestra imagen sin nuestro consentimiento para crear otro contenido (en este caso, mediante IA) se trataría de un atentado contra nuestro derecho a la imagen, ya que el artículo 7.5 de la Ley Orgánica 1/1982 considera como intromisión ilegítima la “captación, reproducción o publicación por fotografía, filme, o cualquier otro procedimiento, de la imagen de una persona en lugares o momentos de su vida privada o fuera de ellos”. Es decir, cualquier elemento que nos pueda identificar.

Además, si alguien utiliza nuestra imagen sin nuestro consentimiento para fines sexuales (como crear imágenes de desnudos o en escenarios de contenido pornográfico) se podría considerar como una intromisión ilegítima al derecho al honor, ya que atribuye hechos que lesionan la dignidad de otra persona. Además, si este material pornográfico se genera para causar un daño concreto (que se pueda asociar a una persona individual, con nombres y apellidos), también podría suponer un delito de injurias, como recoge el artículo 208 del Código Penal. En este artículo puedes encontrar más información sobre qué derechos nos amparan en el caso de contenidos de tipo sexual.

Si todo esto lo aplicamos al caso de que se creen material sexual de menores, la gravedad de los hechos aumenta y se podría considerar como un delito de pornografía infantil, aunque se traten de imágenes artificiales creadas con inteligencia artificial. Según explica a Maldita.es Maitane Valdecantos, abogada especializada en propiedad intelectual y derechos digitales, la pornografía infantil se encuentra tipificada en el artículo 189 del Código Penal, por lo que “con independencia de si es creada por IA o no, tiene encaje directo en el tipo penal”.

En ese artículo se establece una pena de prisión de uno a cinco años por la producción, distribución o difusión “por cualquier medio de pornografía infantil”. El texto incide en que se considera pornografía infantil todo material que represente de manera visual a un menor o que parezca ser un menor participando en una conducta sexualmente explícita, “real” o “simulada” (aquella generada artificialmente y que no emplea a personas reales).

También considera pornografía infantil las “imágenes realistas de un menor” participando en una “conducta sexualmente explícita o imágenes realistas de los órganos sexuales, con fines principalmente sexuales”.

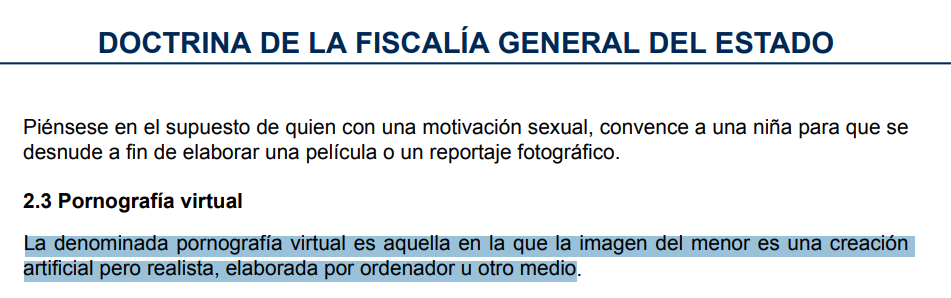

¿Incluye esto a las imágenes artificiales, ya sean creadas con un ordenador, con un programa de edición de imágenes o con inteligencia artificial? Según la doctrina de la Fiscalía General del Estado, estos supuestos entran dentro de lo que se denomina “pornografía virtual”: aquella en la que la imagen del menor es “una creación artificial pero realista, elaborada por ordenador u otro medio”.

El documento incide en que las “imágenes realistas” se deben tratar como “imágenes cercanas a la realidad, a la que tratan de imitar”. Es decir, aunque las fotografías no sean reales, sí lo parecen o pretenden serlo. Por lo que en este supuesto se podrían incluir “imágenes alteradas de personas existentes e incluso las imágenes generadas mediante ordenadores”, señala el texto. Como confirma Valdecantos, “no es descabellado sostener que el uso de la inteligencia artificial para generar estas representaciones pornográficas tiene cabida en el artículo 189 del Código Penal”.

En el ámbito Europeo también hay normas que regulan la pornografía infantil. La Directiva 2011/92/UE del Parlamento Europeo y del Consejo castiga la creación de imágenes realistas y tipifica la producción y difudisión de pornografía infantil virtual “en un sentido similar al de nuestro Código Penal”, incide la abogada. “Aunque todas las normas son mejorables y se prevén revisiones constantes para adaptarlas a los avances tecnológicos, tenemos herramientas jurídicas aplicables para sancionar estos comportamientos”, argumenta la experta.

Si los autores del delito son menores de edad, sus responsabilidades penales son diferentes y también las medidas que se imponen

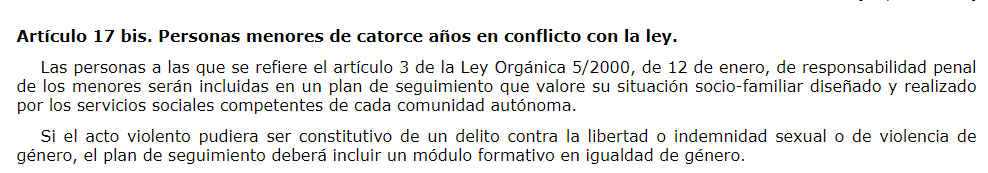

Hay casos de pornografía infantil que se han dado en un entorno escolar, donde es probable que los autores de estas imágenes también sean menores de edad. En este caso sus responsabilidades penales son diferentes y vienen recogidas en la Ley Orgánica 5/2000, de 12 de enero, reguladora de la responsabilidad penal de los menores. En caso de que el autor tenga entre 17 y 14 años, son los Jueces de Menores quiénes pueden imponer medidas como el internamiento, libertad vigilada o la prohibición de comunicarse con la víctima dependiendo de la gravedad del delito.

En caso de que tenga menos de 14 años, no se le puede exigir responsabilidad penal según esta ley, sino que serán incluidos en un plan de seguimiento elaborado por los servicios sociales que incluirá un módulo formativo en igualdad de género en caso de que se atente contra la libertad sexual de otra persona, de acuerdo con la Ley Orgánica 1/1996, de 15 de enero, de Protección Jurídica del Menor.

Ya hay casos en España en los que la inteligencia artificial se ha empleado para generar pornografía infantil

Aunque la Fiscalía del Estado ya advertía en 2015 de la dificultad de distinguir entre imágenes reales e imágenes generadas por ordenador, con los avances en inteligencia artificial de los últimos años han comenzado a surgir casos en los que se ha empleado esta tecnología para crear material sexual no consentido de menores.

Varias madres del municipio de Almendralejo, en Badajoz, denunciaron el 18 de septiembre de 2023 la difusión de imágenes de desnudos de sus hijas, menores de edad, en redes sociales. Las víctimas denuncian que estas imágenes fueron creadas a través de herramientas de inteligencia artificial mediante una aplicación que ofrece "desnudar" a personas, como esta que analizan en elDiario.es.

“Con una aplicación han cogido una foto suya y la han puesto como si estuviera desnuda. Se lo han hecho a mi hija y a una docena más. Parad ya, no sólo los que se están dedicando a desnudar con inteligencia artificial a las chicas, sino a todos los que lo están compartiendo”, ha denunciado en redes sociales Miriam Al Adib, ginecóloga, divulgadora, y madre de una de las menores que ha sido víctima de estos contenidos.

La Policía Nacional ha iniciado una investigación sobre lo sucedido, y once menores han declarado ante las autoridades a la hora de redacción de este artículo, asegura Levante-EMV. Según el delegado de Gobierno en Extremadura, Francisco Mendoza, también se han identificado a alguno de los menores que podrían estar implicados en la difusión de estas imágenes y el caso ha sido puesto en manos de la Fiscalía de Menores, señala Europa Press. La Agencia Española de Protección de Datos también ha puesto en marcha, de oficio, actuaciones previas de investigación. El País detalla que se han identificado a 11 posibles autores menores de edad. Algunos de ellos cuentan con menos de 14 años, por lo que serían inimputables penalmente de acuerdo con la ley.

Según Valdecantos, los sucesos ocurridos en Almendralejo se diferencian del resto de casos en los que se ha utilizado inteligencia artificial para crear contenido sexual ya que las víctimas son menores. Por lo tanto, no sólo entra en juego la intromisión ilegítima en el derecho al honor, intimidad y propia imagen, sino que en este caso también podría aplicarse un delito de pornografía infantil, aunque las imágenes se hayan generado a través de inteligencia artificial.

Este suceso no es el único que ha ocurrido en España. En diciembre de 2022 la Policía Nacional detuvo a un pedófilo que también utilizaba inteligencia artificial para crear material de abuso sexual infantil. Según las autoridades, el arrestado contaba con conocimientos en informática y había empleado esta tecnología para generar material de “extrema dureza”. Este fue el primer caso registrado en España en el que se empleaba la inteligencia artificial para generar pornografía infantil, pero este tipo de imágenes llevan circulando tiempo en la dark web en otros países, según señala The Washington Post o el investigador digital Henk van Ess.

El Instituto Nacional de Ciberseguridad (INCIBE) también ha tratado un caso en el que un adolescente denunció una situación de extorsión que estaba sufriendo a partir de unos desnudos generados con inteligencia artificial. Según el relato de la víctima, se puso en contacto con otro usuario al que no conocía a través de Instagram, que le pidió varias fotografías que posteriormente se emplearon para crear varios montajes explícitos a través de inteligencia artificial.

Si difunden imágenes íntimas (reales o no) podemos solicitar su retirada a la Agencia Española de Protección de Datos

En caso de que difundan imágenes nuestras con contenido sexual (sean reales o creadas con IA), el INCIBE da una serie de pasos que podemos seguir en caso de que seamos víctimas de estos contenidos:

Si eres menor, pon en conocimiento de lo sucedido a tus padres o algún adulto de confianza que te pueda ayudar.

No borres ninguna prueba y guarda todas las evidencias posibles (mensajes intercambiados, etc.) mediante capturas de pantalla.

Valora una posible denuncia presencial en las Fuerzas y Cuerpos de Seguridad del Estado, como el Cuerpo Nacional de Policía.

Corta toda comunicación con la persona que te esté extorsionando y no proporciones ninguna otra información adicional. Además, es aconsejable reportar y bloquear al usuario en redes sociales.

Practica el egosurfing periódicamente para vigilar qué información existe en Internet nosotros.

Si hemos detectado que se ha difundido material sexual que emplea nuestra imagen en redes sociales, podemos tomar otras medidas como ejercer el derecho al olvido o contactar con la plataforma o red social en cuestión para solicitar su eliminación. También podemos denunciar el caso a las autoridades y solicitar a través de la Hotline de INCIBE y el Canal Prioritario de la Agencia Española de Protección de Datos para solicitar su retirada inmediata. Si tienes más dudas sobre qué hacer ante la difusión de imágenes íntimas o de carácter sexual en Internet, en este artículo os damos más detalles.

Este artículo ha sido actualizado el 20 de septiembre de 2023 para incluir más declaraciones de Maitane Valdecantos y el inicio de una investigación por parte de la Agencia Española de Datos; el 21 de septiembre de 2023 para incluir nueva información sobre la aplicación de la ley en menores de edad; el 24 de octubre de 2023 para incluir el caso de Barcelona; y el 3 de junio para incluir el caso de Puertollano.