El 30 de enero de 2023, varias creadoras de contenido relataron cómo habían sido víctimas del uso de deepfakes (vídeos manipulados con inteligencia artificial para suplantar la identidad de una persona) sin su consentimiento para generar material pornográfico, como os contamos en Maldita.es. QTCinderella, una de las afectadas por estos contenidos, aseguró durante una transmisión que iba a denunciar a la plataforma que había publicado este vídeo.

El relato de las víctimas devuelve a la palestra el debate sobre estas herramientas y la regulación del uso de imágenes generadas por inteligencia artificial sin la aprobación de las personas que aparecen en ellas; especialmente, si es para contenidos sexuales. ¿Es legal, es denunciable? Explicamos este escenario en el caso de Estados Unidos, Europa y España.

El uso de ‘deepfakes’ cuenta con regulaciones específicas en algunas zonas de Estados Unidos

Aunque el uso de deepfakes no está regulado de forma explícita en Estados Unidos (país natal de QTCinderella) en su conjunto, sí que cada estado cuenta con una serie de normativas y regulaciones que permitirían a las víctimas emprender acciones legales al ver sus derechos vulnerados.

Así lo detalla Maitane Valdecantos, abogada especializada en propiedad intelectual y derechos digitales, que ha explicado a Maldita.es que las streamers afectadas podrían recurrir a lo que se conoce como personality rights, publicity rights o celebrity rights: el derecho de una persona de controlar el uso comercial de su identidad “como su nombre, imagen, semejanza u otros identificadores inequívocos”, detalla.

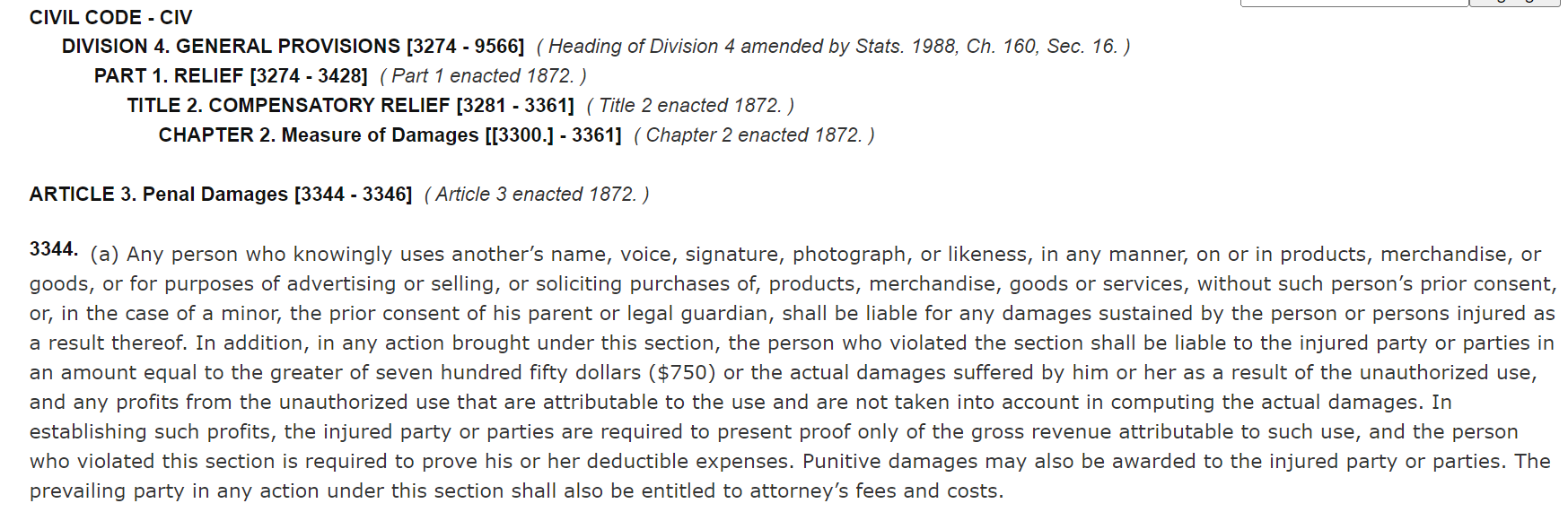

“Son derechos que sobreviven al fallecimiento de la persona y son de regulación estatal no federal (es decir, que cada estado tiene su propia norma de publicity rights), exigiendo autorización previa para su uso”, argumenta Valdecantos. En el caso de California, el Código Civil recoge el uso indebido del “nombre, la voz, la firma, la fotografía o el parecido de otra persona” en “productos, mercancías o bienes”.

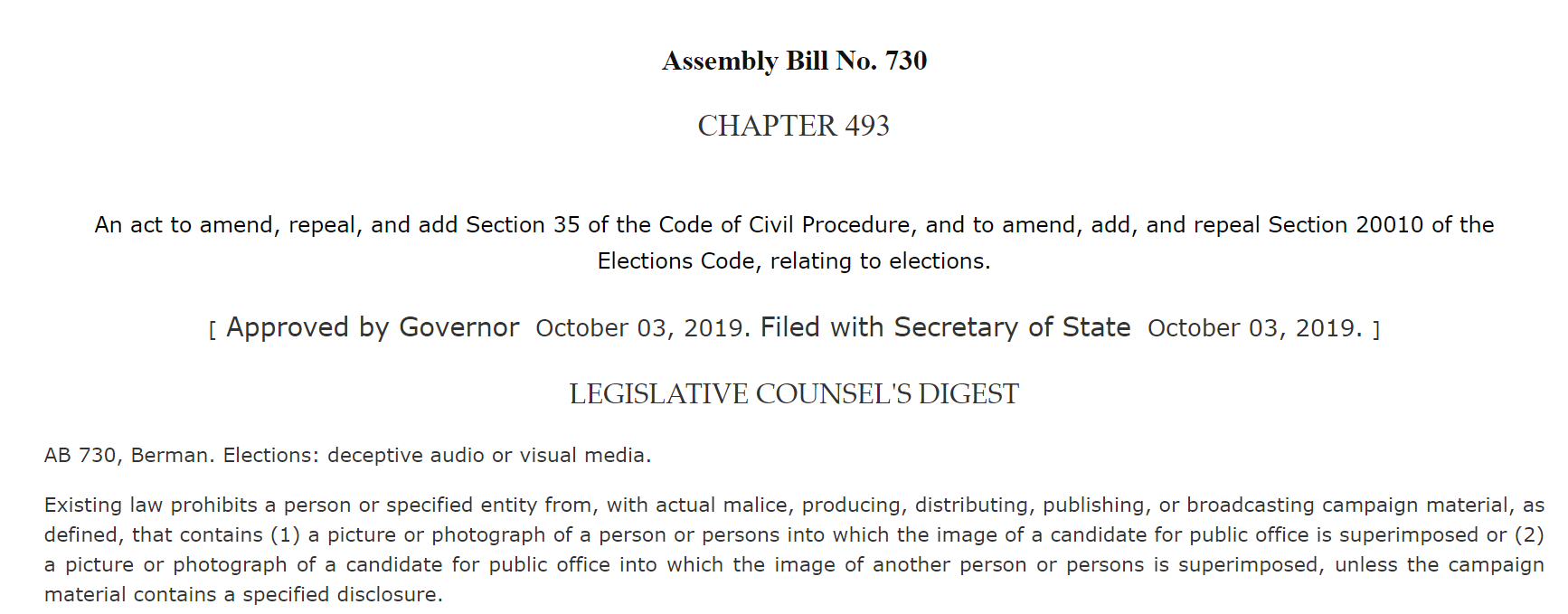

Rahul Uttamchandani, abogado especializado en tecnología y privacidad, también detalla a Maldita.es que esta normativa depende de cada estado: Virginia o Texas son algunos de los territorios que ofrecen una mayor base legal para perseguir este tipo de acciones al contar con una regulación específica para el deepfake, como qué pasa si se emplean para manipular unas elecciones, como recoge el Proyecto de Ley de la Asamblea No. 730 de California.

“El mero hecho de utilizar tu imagen o rasgos de tu personalidad sin tu consentimiento para generar deepfakes ya va a habilitar en muchos casos la posibilidad de interponer una acción legal”, sintetiza Uttamchandani, que también ejemplifica que, en el caso de California, entra en juego la Ley de Protección de Datos de ese estado, la Ley de Privacidad del Consumidor de California (CCPA, por sus siglas en inglés). Esta legislación “permitiría a una persona física a interponer una acción legal que vulnere esa normativa, por ejemplo cuando utiliza datos personales de esa persona como es el caso de los deepfakes”, recuerda el experto.

En el caso de Virginia también hay una ley específica de protección de datos de carácter personal (VCDPA, por sus siglas en inglés), pero esta “no confiere el derecho de emprender una acción a nivel individual”.

Por otra parte, Maitane Valdecantos señala que hay legislaciones que regulan la difusión de imágenes íntimas y la invasión de la privacidad, y que protegen el derecho de una persona, en especial personajes que no sean públicos, a “la protección de la publicidad que crea una impresión falsa o engañosa sobre ella”. “Hay que tener en cuenta que dicha representación debe ser altamente ofensiva, y que el actor debe haber tenido conocimiento o haber actuado con imprudencia temeraria”, recuerda la experta, si bien este derecho colinda con la libertad de expresión, lo que dificulta que un personaje público pueda pedir protección ante los deepfakes, razona la abogada.

¿Puede la legislación estadounidense proteger a las víctimas si se emplea su imagen para crear ‘deepfakes’ sexuales?

Hemos hablado en general de imágenes íntimas, pero ¿qué pasa en el caso de deepfakes creados con la intención de hacer material pornográfico? La tecnología en sí no está regulada en este aspecto, pero la creación de este material a partir de imágenes no consensuadas sí que entra en los supuestos de la ley.

Mientras que el uso de esta tecnología para contenidos que son “parodia”podrían englobarse dentro de los supuestos de la libertad de expresión, los contenidos de índole sexual dañan la reputación y menoscaban la imagen de las afectadas, por lo que sí entraría en los supuestos de la ley, argumenta Rahul Uttamchandani.

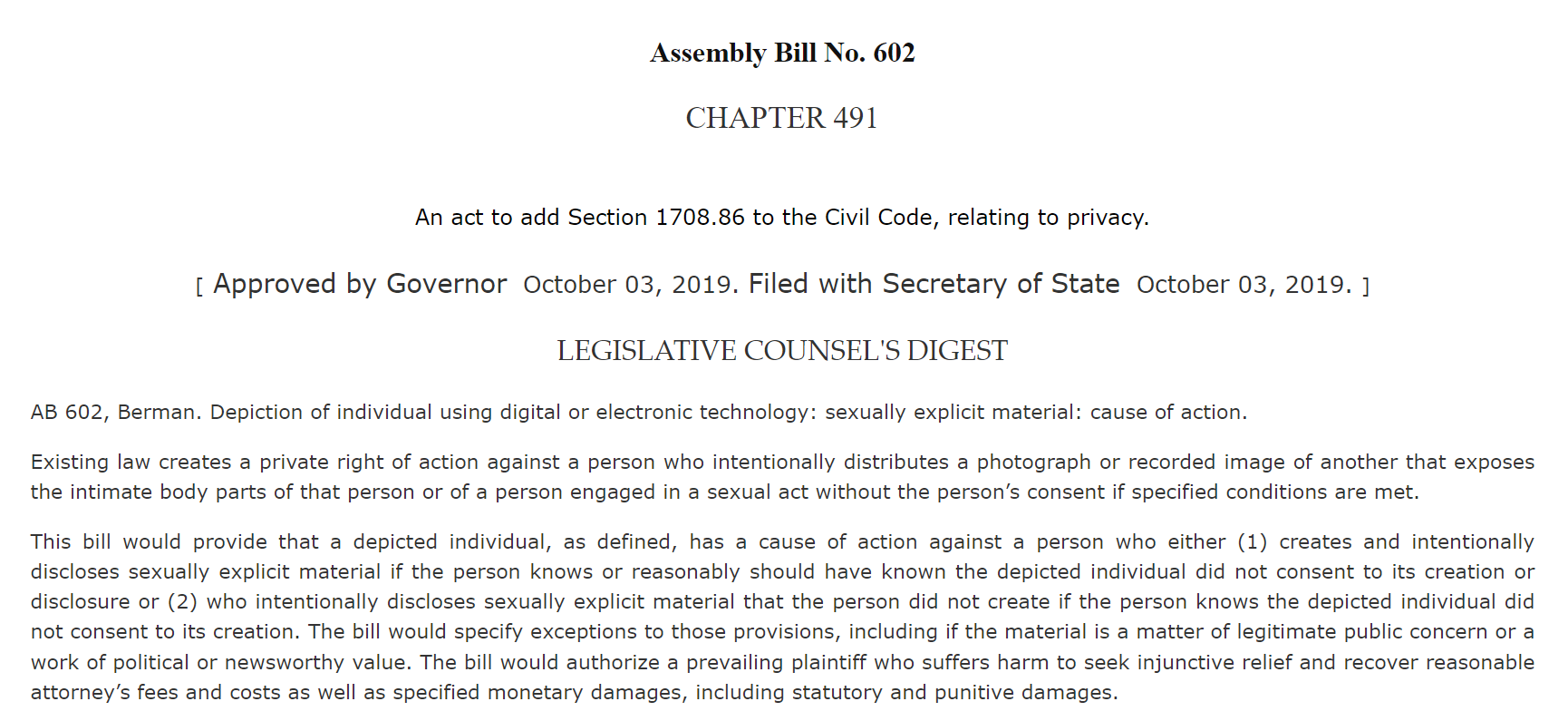

Valdecantos detalla que existen leyes recientes en Estados Unidos que regulan la pornografía no consentida, y que “pueden ser el recurso legal más eficaz contra quienes suben deepfakes personales con contenido pornográfico no consentidos”. Por tanto, esto podría ser perseguido por la vía penal. “Hasta la fecha, más de treinta estados tienen en aplicación este tipo de estatutos”, asegura la abogada. Por ejemplo, en California se encuentra el Proyecto de Ley de la Asamblea No. 602, que “introdujo un derecho de acción privado para las personas vistas en pornografía deepfake para simplificar el proceso de denuncia individual”.

Otros estados como Virginia o Nueva York también cuentan con regulaciones en este sentido que varían en algunas cuestiones, pero Valdecantos destaca que “en general, los requisitos para la apreciación de la infracción son la existencia de dolo, la expectativa de intimidad y la visualización de zonas íntimas y actos sexuales”.

La Comisión Europea estudia regular el uso de los ‘deepfakes’, pero no tiene una normativa específica

En el caso de Europa, la Unión Europea tampoco cuenta con una regulación específica para los deepfakes ya que, como resalta Uttamchandani, “no se legisla en función de la tecnología específica, sino que cada estado miembro cuenta con su propia normativa que afecta de una manera u otra a esta tecnología”.

La UE está tomando posiciones: tanto el Parlamento Europeo como la Comisión Europea han mostrado su preocupación por esta tecnología. En la Resolución del 21 de mayo de 2021, el Parlamento destacó la dificultad de detectar contenidos manipulados y la necesidad de establecer marcos jurídicos para los deepfakes, indica Valdecantos. Dentro de la propuesta de Ley de Inteligencia Artificial, el organismo busca que los vídeos generados a través de deepfakes cumplan una serie de obligaciones en materia de transparencia cuando esta tecnología esté involucrada.

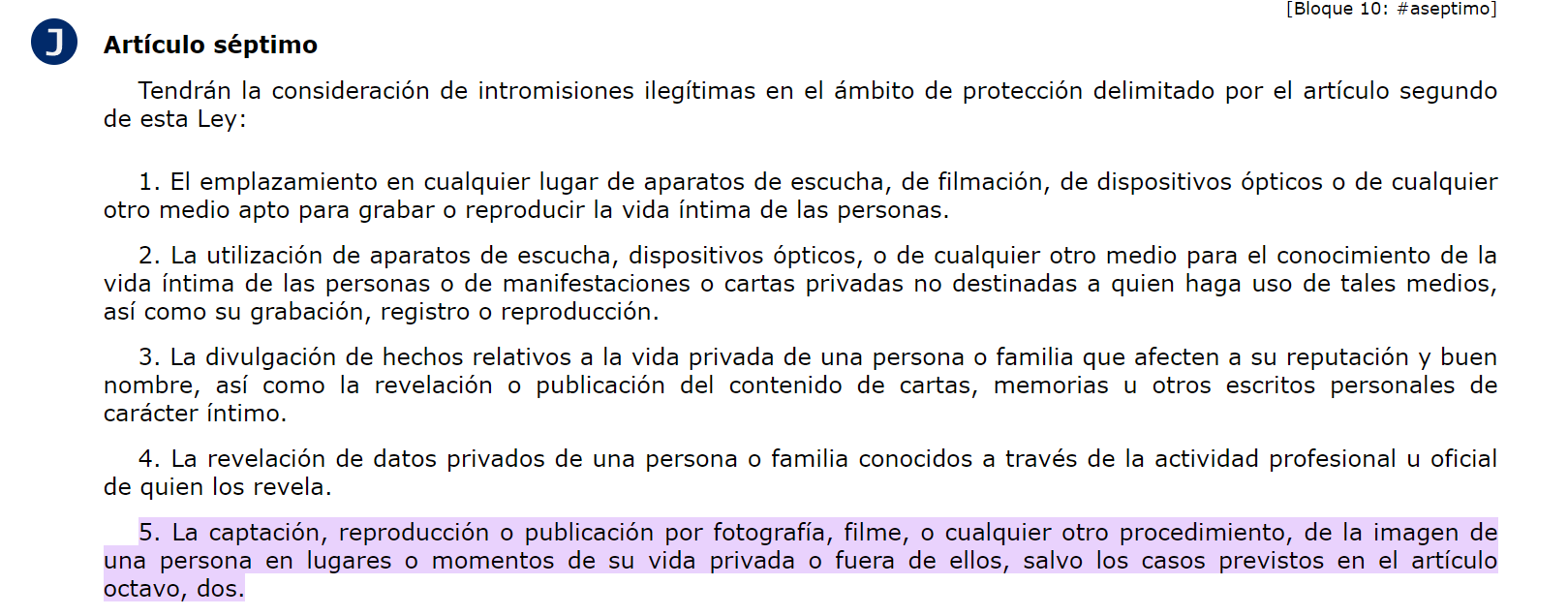

Por otra parte, la legislación española es más garantista que la estadounidense en materia de imagen e intimidad, tal y como refleja el artículo 18 de la Constitución Española. Es un derecho que queda recogido en la Ley Orgánica 1/1982, que, en su artículo 7.5, considera como “intromisión ilegítima” la “captación, reproducción o publicación por fotografía, filme, o cualquier otro procedimiento, de la imagen de una persona en lugares o momentos de su vida privada o fuera de ellos”, por lo que se podría iniciar un proceso por la vía civil.

¿Entrarían los deepfakes dentro de estos supuestos? Según Uttamchandani, sí, ya que el derecho a la imagen no sólo trata sobre el uso de la figura o la voz de cada persona, sino “todo lo que la haga reconocible ante terceros sin su consentimiento”, por lo que el uso no consensuado de imágenes para esta tecnología vulneraría este derecho.

El abogado añade que el deepfake también haría uso de los datos personales de una persona, por lo que también entraría bajo el amparo de la Ley de Protección de Datos, ya que “un dato personal es cualquier información que haga identificable a una persona física”.

¿Cómo regula la legislación española los ‘deepfakes’ con fines sexuales?

En el caso concreto de que esta tecnología se emplee para la creación de contenidos sexuales, la abogada Maitane Valdecantos apunta a que estas imágenes afectan al honor de la persona. Un supuesto que también recoge la Ley Orgánica 1/1982 en su artículo 7.7, y que “constituiría una intromisión ilegítima en el derecho al honor”.

En este escenario, Uttamchandani destaca que “si el material pornográfico se genera para causar un daño concreto, es probable que se asocie a su nombre y apellidos”. Un escenario que supondría además un delito de injurias, ya que, tal y como recoge el artículo 208 del Código Penal, se trataría de unas imágenes que lesionan la dignidad de otra persona, menoscabando su fama o atentando contra su propia estimación, detalla el abogado.

¿Y si usan mis imágenes para crear otros contenidos sexuales mediante inteligencia artificial, por ejemplo, con Dall-E?

El desarrollo de la inteligencia artificial no sólo ha llevado a la propagación de la tecnología del deepfake, sino al desarrollo de otras herramientas como Dall-E, que permite generar imágenes realistas o artísticas a partir de unos parámetros determinados. Ante el avance de este tipo de IA, ¿qué pasaría si usan nuestra imagen sin nuestro consentimiento para generar contenidos de tipo sexual? ¿Quedaría amparado bajo la legislación? ,

Según los expertos, sí. Valdecantos asegura que, en el supuesto de que se creara contenido pornográfico de cualquier índole sin nuestro consentimiento, “se estarían vulnerando idénticos derechos, sólo cambia la forma o la técnica empleada para tal vulneración”. Una conclusión en la que coincide Uttamchandani, que incide en que “se podría extrapolar perfectamente”, ya que “son cuestiones reguladas de forma general en todo tipo de situaciones, las herramientas que utilicemos no influyen en el resultado desde el punto de vista jurídico”.

Por tanto, daría igual la tecnología empleada (deepfakes o un software de generación de imágenes mediante IA, como Dall-E o Stable Diffusion): podríamos denunciar el uso de nuestra imagen personal sin nuestro consentimiento para estos fines.