¿Y cómo hace para distinguir el pezón de una mujer del de un hombre? Pues no hay una respuesta directa para estas preguntas, pero os contamos lo que sabemos.

Para empezar, hemos preguntado a Facebook qué nos puede decir de su decisión de restringir “algunas imágenes de pechos femeninos que incluyen el pezón”, según la política de “Desnudos y actividad sexual de adultos” que tienen publicada. En ella, la compañía afirma que limitan “la exhibición de desnudos o actividad sexual para proteger a determinadas personas de nuestra comunidad que muestren una especial sensibilidad ante este tipo de contenido”.

La compañía no ha aportado nada adicional a lo que ya pone en sus normas comunitarias, por lo que no defienden en qué se basan para considerar que un pezón femenino puede “ser sensible” para su comunidad y uno masculino no.

En ese documento dicen que sí que permiten la publicación de pechos femeninos desnudos en casos de lactancia, actos de protesta y fotos de cicatrices de mastectomías (además de pinturas, esculturas u obras de arte). Ya ha habido denuncias por parte de artistas que pusieron a prueba si ese tipo de imágenes sobrevivirían a la moderación de la plataforma, también en Instagram, y no fue así.

Para la compañía hay una distinción entre el pezón masculino y el femenino, que una de sus ejecutivas justificó por “razones de seguridad”: “Es muy difícil para nosotros el determinar la edad de una persona en una foto de un desnudo. También es difícil determinar si es consentida, así que aunque esté claro que la persona ha consentido que se tome la foto, es muy difícil saber si la persona consintió que se compartiera”, dice Miranda Brickbert, directora de gestión de Políticas Públicas de Facebook, cuenta Business Insider. Hasta aquí este es un debate más “moral” que técnico.

Herramientas de inteligencia artificial y detección automática de los contenidos

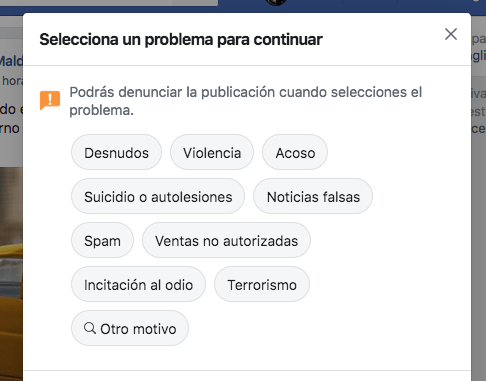

En cuanto a cómo detectan los pezones de mujer a la hora de retirar una imagen o vídeo, Facebook se remite a la acción de sus sistemas de inteligencia artificial para moderar el contenido que se publica, así como a las denuncias de la gente. Según sus reglas, los pezones de mujer se pueden denunciar por incluirse en su política de desnudos si no aparecen en un contexto de protesta, de lactancia, etc.

Cuando tuvo lugar el atentado terrorista de Nueva Zelanda en el que varios hombres entraron disparando contra una congregación en una mezquita y asesinaron a 49 personas y que fue retransmitido en directo en Facebook, la compañía amplió un poco más la información de la manera en la que usaba inteligencia artificial para detectar este tipo de contenidos. Decía que están basados en crear una base de datos gigantesca, con miles y miles de ejemplos (como pezones) de lo que quieres enseñarle al sistema para que aprenda a reconocerlo de forma automática. En ese momento admitió que sus sistemas funcionan bien para detectar desnudez o propaganda terrorista pero para lo demás, anda ahí ahí.

Ya lo dijo presidente de la empresa Mark Zuckerberg en una conferencia en 2018: “Es mucho más fácil crear un sistema de inteligencia artificial para detectar un pezón que lo es para distinguir lo que es el discurso de odio”.

Entrenar algoritmos para detectar el discurso de odio: tarea imposible

Sólo un año después de que Facebook argumentara que les era muy difícil saber si una imagen se había tomado de forma consensuada, anunció que quería entrenar algoritmos para detectar ese tipo de contenido a pesar de las limitaciones de este tipo de tecnología a la hora de interpretar lo que transmite un contenido concreto (ya sea texto o multimedia).

De modo que para responder a vuestra consulta nos quedamos con que pezones femeninos no podemos ver por una serie de decisiones tomadas por la empresa ligadas a la seguridad, a la “sensibilidad” de la comunidad y la posible explotación de una imagen (a pesar de que la del pecho de un hombre no tiene esa limitación), y que tira de sistemas de inteligencia artificial para detectar la diferencia entre uno y otro. El detalle técnico se mantiene en secreto, al igual que el de sus algoritmos de recomendaciones (como te explicamos aquí). ¡Esperamos haberte ayudado!

Primera fecha de publicación de este artículo: 26/06/2020.