El 6 de julio de 2022 se celebró la final de la tercera edición del concurso AI Song Contest, es decir, el conocido como el Eurovisión de la inteligencia artificial. La propuesta de España, la canción gallega ‘AI-lalelo’, quedó segunda y fue favorita del público, lo que llevó a la organización del concurso a decidir celebrar su cuarta edición en A Coruña el 4 de noviembre de 2023. Tras el evento, el grupo neerlandés Synthetic Beat Brigade se ha proclamado ganador de la edición de este año con un tema sobre el amor (inalcanzable) entre el ser humano y la inteligencia artificial. Para la letra han usado un modelo GPT-2 de código abierto y, para la melodía, distintas herramientas de IA.**

Pero, ¿puede realmente un programa basado en inteligencia artificial (IA) componer una canción o sería más bien una herramienta de trabajo colaborativa con un equipo humano? Hemos hablado con compositores y expertos en inteligencia artificial para entenderlo. ¡Pon el oído!

Sonidos gallegos: GPT-3, Google Magenta y revisión humana

En ‘AI-lalelo’, se ha usado inteligencia artificial para la composición de las letras y la melodía, y parte de los ritmos y de los instrumentos. La armonía, estructura, voces y el resto de ritmos e instrumentos corre a cargo del equipo humano. Es decir, es una canción hecha con la ayuda de la inteligencia artificial, no lo ha conseguido un programa por sí mismo.

Como en cualquier modelo de inteligencia artificial, ha habido que nutrir a la máquina. Para la letra, se enseñó al sistema de generación de texto de OpenAI, GPT-3, a escribir en gallego y componer copla con cantigas populares de Galicia. Después, se le pidió que conformara una letra sobre una costurera. “Nosotros hemos intervenido para elegir la letra que más nos convencía y corregir alguna falta de ortografía”, explica Juan Alonso, tecnólogo en aprendizaje automático y redes neuronales y miembro del equipo que ha compuesto la canción que ha representado a España.

Para la música, primero hicieron una selección de melodías para que se adaptaran al estilo que buscaban. “Cuando la IA generaba una que nos gustaba, volvíamos a meterla en Google Magenta [herramienta de Google para usar el aprendizaje automático como herramienta creativa] e iterábamos el proceso estrofa a estrofa”, detalla. Es decir, siempre ha habido un juez humano supervisando y tomando la última palabra. “Sin un humano que filtre, los resultados son dignos pero no se puede hacer un ajuste fino y concreto”, apostilla Alonso.

Inspiración artificial para generar nuevas ideas, pero después de recibir datos de una persona

Pero entonces, ¿esto es realmente inteligencia artificial? “Hoy en día, se considera inteligencia artificial todo lo que lleve aprendizaje automático: modelos que observan grandes cantidades de datos, infieren patrones y aprenden cómo están construidos para imitarlos. Por eso, sí, esta canción del Eurovisión de la IA se ha compuesto utilizando IA”, afirma Carmen Torrijos, lingüista computacional y responsable de Inteligencia Artificial y Datos en Prodigioso Volcán.

¿Y sería posible hacerlo sin un humano? Aunque los modelos de aprendizaje automático son mucho más autónomos que antes, no componen por sí solos, explica Torrijos: “El trabajo de recopilar las cantigas, convertirlas a texto plano, organizarlas e introducirlas en el modelo es humano. La máquina recibe instrucciones. Lo único que es artificial y autónomo es el centrifugado. Además, el resultado está cocinado, porque no se ha seleccionado lo primero que ha salido”.

Aunque la inteligencia artificial no pueda componer una canción tal y como la entendemos por sí misma, sí es una herramienta de la que pueden servirse artistas y compositores. “En procesos creativos es muy útil porque, al centrifugar la información de manera más ágil, puede generar ideas nuevas. Es como una inspiración artificial”, sugiere la experta de Prodigioso Volcán.

Herramienta creativa: de reproducir una zanfoña a imitar el sonido de un koala

Veamos un par de ejemplos prácticos. ¿Podría la IA replicar cómo suena cualquier instrumento? “Pedimos a un miembro del equipo que tocara durante 15 minutos la zanfoña. Con esa información, entrenamos a una red neuronal que no solo aprendió a imitar el sonido de cada nota, también a hacerlo más suave o más fuerte o a pasar de una nota a otra deslizándose (como en un violín), algo que no se puede hacer con una zanfoña real”, explica Alonso del equipo de ‘AI-lalelo’.

¿Y para qué quieres tú una zanfoña reconstruida por IA pudiendo tener una real? Alonso responde: “Puede que no tengas acceso a alguien que la sepa tocar o que quieras agregarle esos matices. Con esto se crea un instrumento que suena como una zanfoña pero tiene mayores posibilidades expresivas”.

Aún más allá: ¿se puede hacer lo mismo con el sonido de los animales? Sí. Es lo que llevó al equipo de Australia a ganar el primer AI Song Contest en 2020. Entrenaron redes neuronales con los sonidos del koala y la cucaburra para darle ‘sabor australiano’ a la canción.

“Era un enfoque muy, muy colaborativo con la IA. Cuando te presentas al concurso, tienes que escribir un documento del proceso técnico completo; en esa fase te das cuenta de que se trata de una colaboración entre humanos y máquinas”, explica a Maldita.es Caroline Pegram, directora de Estrategia de Innovación de Uncanny Valley, el estudio australiano que creó la canción ganadora, y jueza del Eurovisión de la IA los dos últimos años.

Pegram agrupa todo lo analizado en una clarificadora conclusión: “Pulsar un botón y producir una canción pop completa con inteligencia artificial no es una realidad... todavía. ¿Lo será algún día? Soy escéptica sobre que un ordenador pueda inyectar la emoción que los humanos pueden aportar a la composición de una canción. Sin embargo, hay muchas posibilidades para utilizar el aprendizaje automático y la IA como herramienta en las industrias creativas. Es fundamental que no provoquemos innecesariamente el miedo y la ansiedad de los artistas por pensar que serán sustituidos por una máquina. Tenemos que buscar diseñar soluciones teniendo en cuenta todo el sistema: las personas, la tecnología y el entorno”.

Por cierto, el ganador de la edición de 2022 fue Tailandia, porque, según una miembro del jurado, “el uso de la IA para crear la melodía, entonación y efectos de esa línea de oboe eléctrico es una combinación que no había visto antes”. Veremos si la IA es capaz de sorprender (junto a su equipo humano) en la siguiente edición.

Meta y Google están desarrollando inteligencias artificiales que permiten generar sonidos o música a partir de texto*

Los artistas del AI Song Contest se valen de todo tipo de programas para implementar la inteligencia artificial en sus composiciones, y a su caja de herramientas se podrán añadir nuevas opciones: en los últimos meses de 2023 han surgido ideas que permiten generar efectos de sonido o incluso música a partir de descripciones de texto.

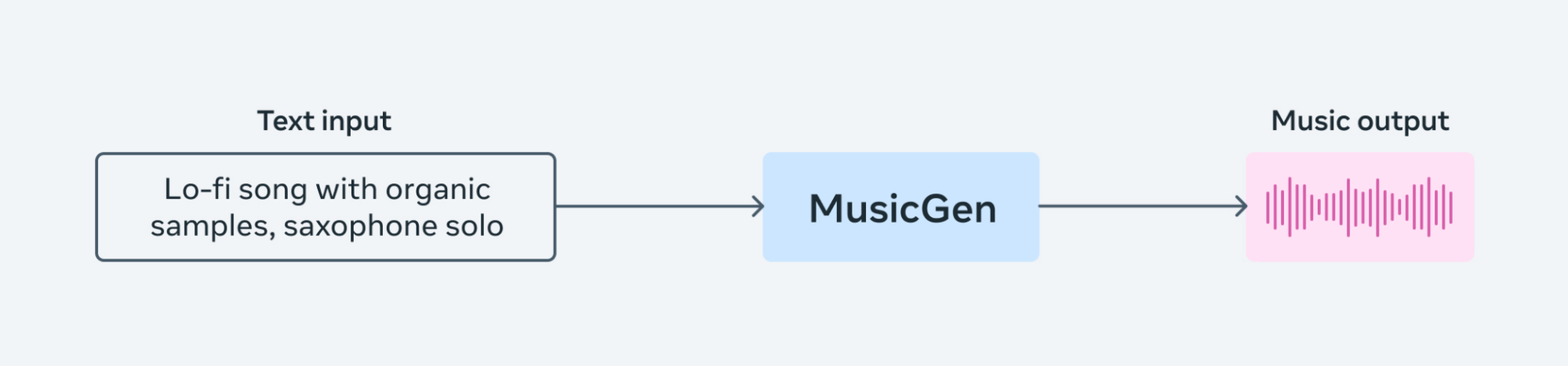

El 2 de agosto de 2023 Meta lanzó al público AudioCraft, un conjunto de herramientas que utilizan la IA para mejorar audio, generar nuevos sonidos y crear composiciones a partir de nuestras instrucciones. La iniciativa, que es de código abierto, se compone de diferentes modelos de inteligencia artificial, entre los que se encuentra MusicGen. Este programa permite generar pistas breves de música a partir de las instrucciones que le demos, según asegura Meta. En este caso, podríamos solicitarle a la IA que nos genere una canción de jazz o una obra orquestal pidiendo instrumentos en particular o un contexto determinado.

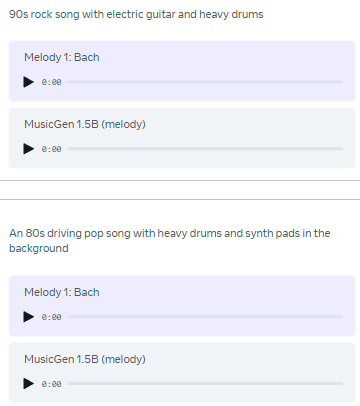

MusicGen también es capaz analizar una melodía existente y transformar su instrumentación, como interpretar a Bach como si fuera una canción de rock de los años 90. Meta también promete otras funciones, como registrar pequeños fragmentos de audio y convertirlos en composiciones de varios minutos. En esta publicación puedes encontrar más detalles sobre cómo la IA es capaz de generar estas composiciones.

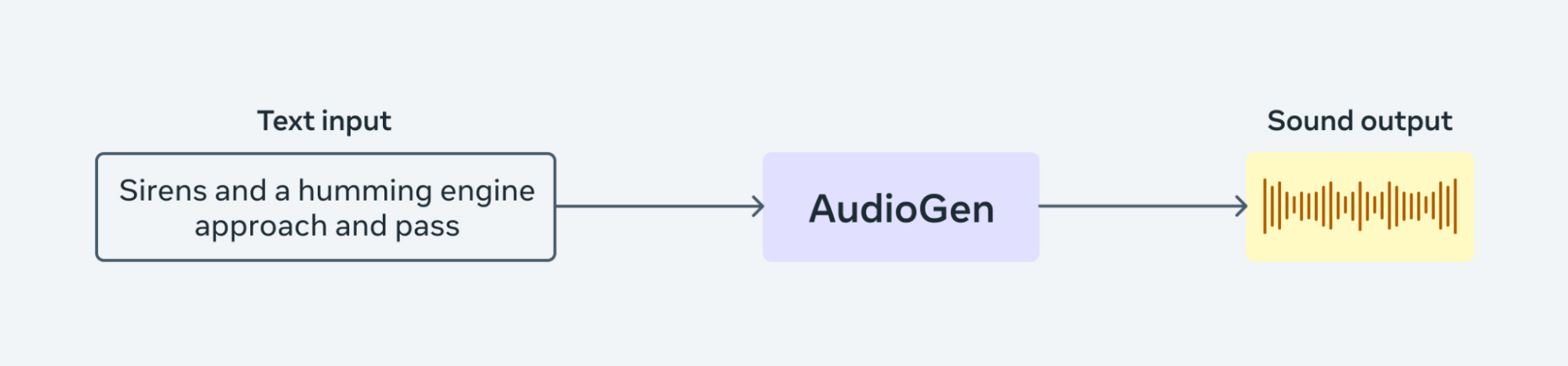

Esta tecnología también se puede emplear para generar efectos de sonido a partir de una descripción del audio que queramos, a través de otro de los modelos desarrollados por Meta, AudioGen. En este caso, le podemos pedir a la IA que genere el ruido de una máquina de escribir o el de una ambulancia al pasar, y el modelo te devolverá cinco segundos de audio, asegura la compañía. En este artículo puedes encontrar más información sobre su funcionamiento.

No es la única (ni la primera) herramienta que permite generar efectos de sonido o música a partir de descripciones de texto. Google también anunció en enero de 2023 MusicLM, su propia IA que permite crear música o sonidos a partir de las instrucciones que le demos a la máquina, y que tiene funciones bastantes similares a AudioCraft. La compañía Futureverse lanzó el 10 de agosto JEN-1: una IA que busca competir con MusicLM y MusicGen, y que también promete la creación de ideas musicales a partir de nuestras peticiones. Riffusion o Moûsai son otros programas que empiezan a sonar dentro del mundo de las IA especializadas en la creación de música.

*Este artículo ha sido actualizado el 16 de agosto de 2023 para incluir nuevas herramientas de IA que generan música a partir de texto.

** Este artículo ha sido actualizado el 6 de noviembre de 2023 para incluir mención a los ganadores del AI Song Contest de este año.

En este artículo ha colaborado con sus superpoderes la maldita Carmen Torrijos Caruda, experta en inteligencia artificial aplicada al lenguaje y texto.

Carmen Torrijos Caruda forma parte de Superpoderosas, un proyecto de Maldita.es que busca aumentar la presencia de científicas y expertas en el discurso público a través de la colaboración en la lucha contra la desinformación.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.

Primera fecha de publicación de este artículo: 18/07/2022