En los días de la manifestación contra la reforma de las pensiones en Francia, circularon por redes sociales unas fotografías de unos supuestos antidisturbios abrazando a mujeres durante una manifestación. Sin embargo, estas imágenes no son reales: se trata de tres imágenes generadas con inteligencia artificial (IA). El usuario que las ha difundido dice haberlo hecho para “concienciar sobre los efectos adversos” de esta técnica.

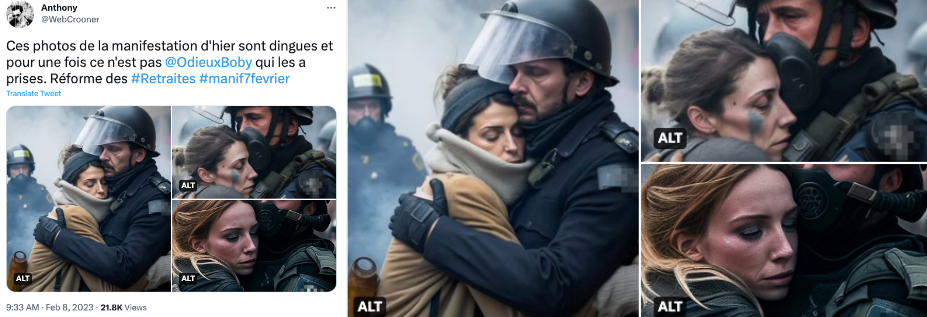

El pasado 8 de febrero de 2023, el usuario de Twitter WebCrooner compartió unas imágenes en las que se veía presuntamente a unos antidisturbios abrazando a tres mujeres en lo que parecía el escenario de una manifestación o un conflicto. Según explicaba en el mensaje, fueron tomadas en alguna parte de Francia, durante las protestas contra el aumento de la edad de jubilación de los 62 a los 64 años de ahora a 2030 celebradas el martes 7 de febrero de 2023.

“No creáis todo lo que veis en Internet”, publicó este mismo usuario al día siguiente. En este segundo tuit reconoce que las tres fotografías de los antidisturbios (Compañías republicanas de seguridad o CRS en Francia) fueron creadas con inteligencia artificial. Además, comparte una cuarta imagen: esta vez de un hombre abrazado a un peluche en forma de oso, que también está creada con esta tecnología, según explica en el breve texto.

“Mi objetivo es sensibilizar a la opinión pública sobre los problemas que plantean las imágenes generadas por robots”, explicó el autor de las fotos en esta entrevista para la emisora de radio francesa Franceinfo.

No es la primera vez que usuarios comparten sus experimentos con aplicaciones de IA. En este otro ejemplo, que se viralizó en Twitter a mediados de enero de 2023, el creador también anuncia que no son fotografías reales y advierte del peligro que supone esta nueva tecnología.

Qué peligros implica difundir sin contexto una imagen generada por IA

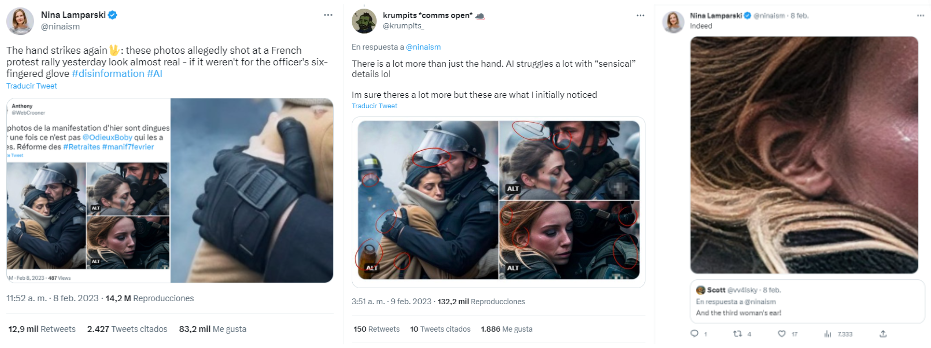

En esta ocasión, varios usuarios advirtieron que se trataban de imágenes falsas. “Estas fotos supuestamente tomadas ayer en una manifestación de protesta en Francia parecen casi reales, si no fuera por el guante de seis dedos del oficial”, compartía Nina Lamparski, directora de AFPFactCheck África, miembro como Maldita.es de la International Fact-Checking Network (IFCN), en su perfil personal de Twitter horas después de que se publicaran las imágenes virales.

A este se sumaron más comentarios resaltando los fallos de estas imágenes: la forma del pelo, mascarillas y prendas de ropa que no encajan con el personaje, orejas deformadas…

Sin embargo, hay otros ejemplos de imágenes creadas con inteligencia artificial que han logrado desinformar. Por ejemplo, en Maldita.es hemos desmentido este supuesto vídeo de Macarena Olona, la exportavoz de Vox en el Congreso de los Diputados y en el Parlamento de Andalucía, bailando la última canción de Bizarrap y Shakira. El clip fue creado con la aplicación Reface, que permite añadir diferentes caras a vídeos ya grabados para generar deepfakes (vídeos manipulados con inteligencia artificial para suplantar la identidad de una persona).

Guía para detectar una imagen creada con IA

El usuario que publicó las supuestas imágenes de las manifestaciones en Francia eliminó el tuit “para no dejar imágenes falsas en la red”, según explicó en la entrevista para Franceinfo. Además, compartió varios consejos para identificar estas imágenes. En Maldita.es hemos recopilado un listado con recomendaciones para que no te la cuelen:

- Pregúntate de dónde salen las imágenes. En este hilo de Twitter, el creador de las imágenes analizadas en este artículo recomienda hacer una búsqueda inversa de las fotografías dudosas. “Si son utilizadas solo por cuentas de redes sociales, es mala señal”, escribe.

- Busca marcas de agua. Algunas aplicaciones como DALL-E-2 dejan marca de agua en las imágenes creadas en su plataforma. En este caso, hay cinco cuadrados de distintos colores en la esquina inferior derecha.

- Cuenta los dedos de la mano. La directora de la plataforma de verificación AFPFactCheck África, Nina Lamparski, recomienda este artículo de Buzzfeed News que explica por qué las manos generadas con IA son caóticas. Es frecuente encontrarnos con manos de seis o nueve dedos o que sean demasiado largos. Según explica este texto, esto es porque “la inteligencia artificial se entrena con miles de millones de imágenes extraídas de Internet, no entiende realmente qué es una mano. En las imágenes, tienen bastantes matices: se aferran a algo o a otra persona”.

- Fíjate en los detalles, como los dientes o las orejas de los protagonistas, pendientes desiguales, gafas que se mezclan con la piel… Son pequeños detalles que pueden apreciarse a simple vista y deben hacernos desconfiar de la veracidad de esas imágenes.

- No te fíes de las caras simétricas. Generalmente, las personas creadas con inteligencia artificial tienen unos rasgos faciales casi simétricos y expresiones faciales neutras. Además, la textura de la piel (e incluso los tejidos) nos recuerdan a las figuras de cera. Puedes ver varios ejemplos en This Person Doesn’t Exist, una página web que genera una imagen generada con IA nueva con cada búsqueda.

- Amplía el fondo de la imagen. ¿Qué ves en el fondo de la imagen? Es frecuente que esté desenfocado, con texturas confusas o incluso con objetos extraños ajenos al contenido de la imagen.