Sin querer entrar en debates filosóficos demasiado densos... ¿hasta qué punto las decisiones que tomamos pueden estar influenciadas por la opinión de terceros? ¿Y si ese tercero es un ordenador? En este caso, hablamos de los algoritmos, esas secuencias informáticas que afectan a nuestro día a día de muchas formas, ya sea preparándonos una selección de música afín a nuestros gustos o decidiendo si somos aptos para la concesión de un crédito, entre muchas otras cosas.

Una investigación desarrollada por Ujué Agudo, de Bikolabs, y Helena Matute, del laboratorio de Psicología Experimental de la Universidad de Deusto, afirma que “las personas se muestran dispuestas a aceptar las sugerencias de los algoritmos en terrenos de decisión tan comprometidos como el voto político o la búsqueda de pareja online”.

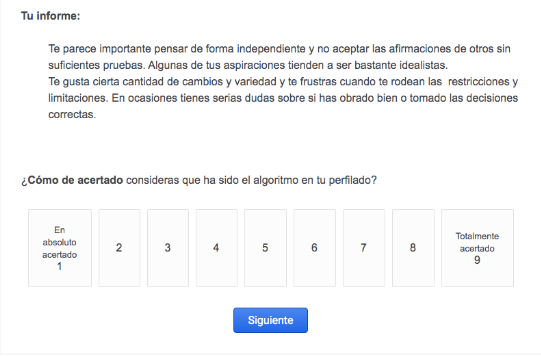

La investigación basa sus conclusiones en cuatro pruebas distintas. Antes de ponerse con ellas, a los 441 participantes se les dijo que tenían que pasar una fase previa en la que un algoritmo supuestamente analizaba las respuestas que daban a determinadas preguntas a fin de entrenarlo con nuestros gustos para elaborar un perfil de personalidad. .

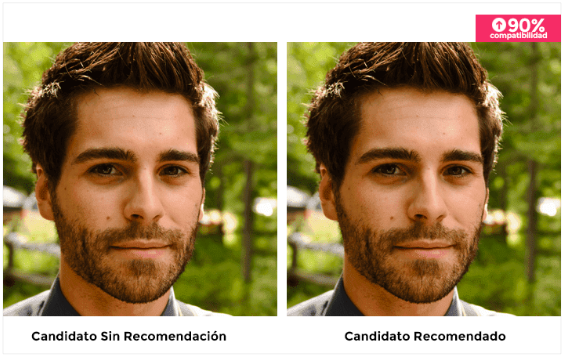

En realidad, este algoritmo no existía pero se usó como excusa para destacar algunas de las fotografías que se presentaban ante los participantes señalando que se trataba de recomendaciones algorítmicas en base a su perfil, ya sea en supuestos de políticos que te ofrecen más confianza (y a los cuales darías el voto) o para escoger ligues.

En los experimentos, tanto para los de temas políticos como los amorosos, se colocaba un cartel junto a la cara de los candidatos que avisaba que la persona en cuestión era altamente compatible contigo. Esta “recomendación explícita” era vista con buenos ojos por los participantes en las pruebas relacionados con los candidatos políticos, mientras que con las citas estos carteles de “90% de compatibilidad” no tuvieron tanto éxito.

Modificar la respuesta de las personas a través de la familiaridad

Además de esa “recomendación explícita”, en la que un supuesto algoritmo directamente te recomendaba a quién elegir, las investigadoras también aplicaron la denominada “influencia sutil” de los algoritmos. ¿De qué se trata? Pues en este caso se buscó aplicar un sesgo de familiaridad, “pre-exponiendo repetidamente las fotografías de algunos de los candidatos” para comprobar si los encuestados mostraban “preferencia por aquello que nos es familiar frente a lo desconocido”.

Los resultados fueron curiosos: mientras que esta manipulación sutil no fue muy efectiva en el ámbito político, en el contexto afectivo y de las citas tuvo mucho más impacto que la recomendación explícita.

“En el contexto político, nuestro algoritmo (ficticio) fue capaz de influir en la disposición a votar por algunos candidatos mediante la persuasión explícita, pero al mismo tiempo nuestro algoritmo encubierto no influyó en las preferencias de voto. (...) En un contexto de citas la influencia encubierta de un algoritmo puede ser poderosa para manipular las preferencias de la gente, mientras que este contexto es más resistente a la persuasión explícita”, detalla el estudio.

Esto no significa que un votante vaya a votar a alguien que esté en el polo opuesto de su espectro ideológico, ni mucho menos, solo porque te lo recomiende un algoritmo. Pero los experimentos sí que “muestran claramente la capacidad de los algoritmos para inclinar la balanza en la elección de unos candidatos frente a otros cuando no existe una fuerte preferencia previa”, según detallan las impulsoras de la investigación.

Las investigadoras concluyen en su estudio que la credibilidad que le damos al consejo del algoritmo depende, en buena medida, del “contexto de la decisión”. Así, en los casos en los que predomina el gusto personal y los valores más subjetivos (como en las citas), “la gente prefiere los consejos de los amigos” antes que los de una máquina. En otros ambientes que se suponen “más racionales”, como en unas elecciones o un debate político, “las personas preferirán la recomendación de los algoritmos antes que las del humano”, concluye el estudio.

Confiamos más en los algoritmos que en nuestro entorno según la tarea se vaya haciendo más complicada

Este no es el único estudio que, en los últimos años, ha apuntado en la misma dirección. De hecho, un reciente estudio publicado en la revista Nature avanza sus resultados ya desde el propio título: “Los humanos confían más en los algoritmos que en la influencia social a medida que una tarea se vuelve más difícil”.

El mecanismo de la investigación es sencillo: a los encuestados se les presentaba una imagen en la que salía mucha gente y tenían que estimar cuántas personas había en ella. Después se les daba un consejo relacionado con la imagen: podía venir respaldado por la opinión ponderada de 5.000 personas o por un algoritmo que basaba su sabiduría en el análisis de 5.000 imágenes similares.

Los resultados son claros: “La gente confía mucho más en el asesoramiento algorítmico para las preguntas difíciles que para las fáciles, incluso después de tener en cuenta los conocimientos numéricos, la precisión, la confianza, la calidad del asesoramiento y el número de preguntas contestadas anteriormente”.

En este otro estudio de 2018 elaborado conjuntamente entre investigadores de las universidades de Harvard y California se arrojan conclusiones parecidas. A través de seis experimentos se demuestra que los ciudadanos no expertos en una materia “se adhieren más a los consejos cuando creen que provienen de un algoritmo que de una persona”

Resulta interesante ver que la confianza en los algoritmos disminuyó cuando las personas tenían que elegir entre la estimación de la máquina y la suya propia o cuando ya tenían experiencia en la materia que se les presentaba.

“Paradójicamente, los profesionales con experiencia, que realizan previsiones con regularidad, confiaron menos en los consejos de los algoritmos que los profanos, lo que perjudicó su precisión”, sostiene el estudio.