Yolanda Díaz, Florentino Pérez, Pedro Sánchez o Ana Botín. Son algunas de las personas públicas que aparecen en vídeos de YouTube y publicaciones de Facebook promocionando una supuesta plataforma de inversión con la que poder ganar hasta 20.000 o 30.000 euros al mes. Cuidado porque los vídeos están manipulados con inteligencia artificial para alterar sus declaraciones. Las herramientas que permiten generar vídeos con IA son cada vez más accesibles y no hace falta tener conocimientos técnicos para usarlas. La Comisión Nacional del Mercado de Valores (CNMV) ya ha alertado sobre este tipo de “deepfakes” que utilizan a personajes reconocidos para recomendar “inversiones fraudulentas”.

Los vídeos usan voces clonadas y logos falsos para intentar colártela

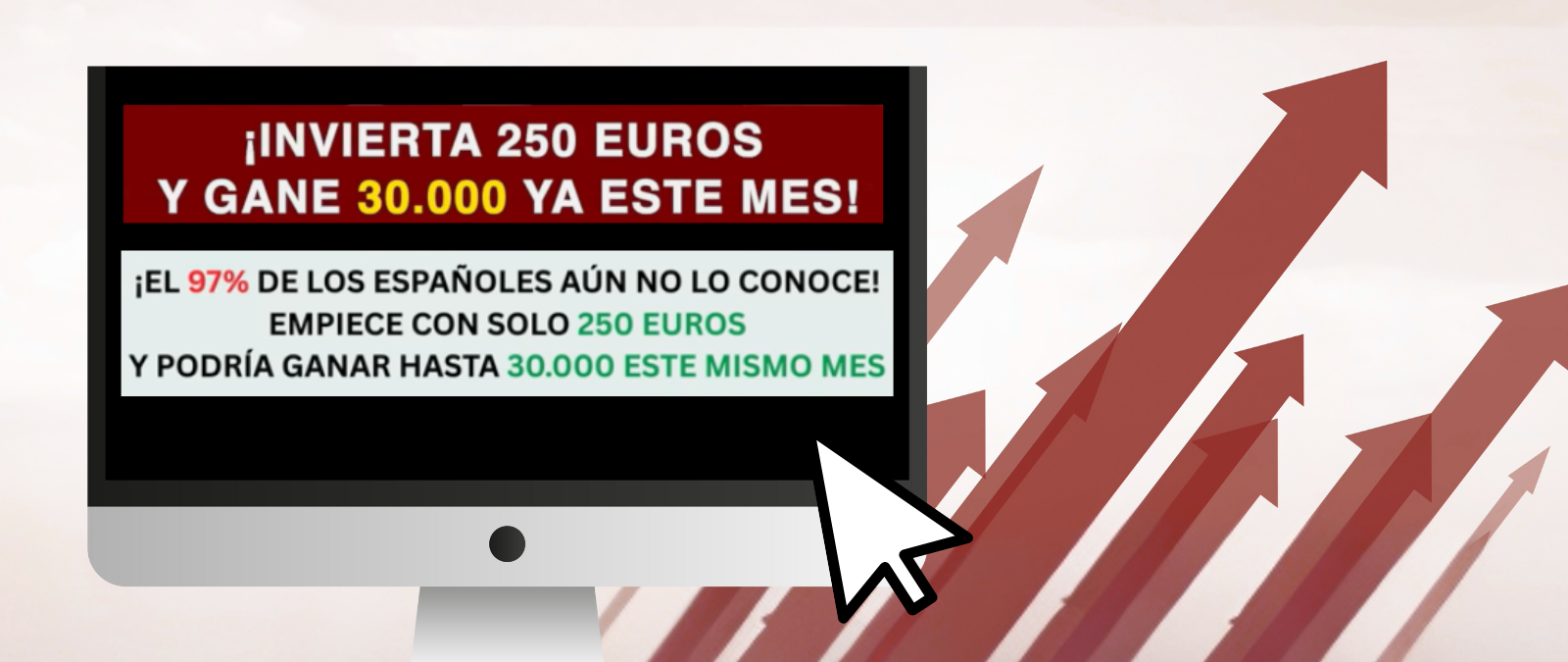

Los vídeos solicitan una inversión inicial de 250 euros y aseguran que la plataforma está “avalada” por el Gobierno de España, el Banco de España e incluso la CNMV. Incitan a acceder a un enlace que redirige a la supuesta plataforma en la que nos piden nuestros datos de contacto. Además, en algunos casos se asegura que en la plataforma de inversión “todo está automatizado y no necesitas experiencia previa”.

Para manipular los vídeos, los ciberdelincuentes utilizan inteligencia artificial para clonar las voces de personajes públicos, sincronizar el movimiento de sus labios y generar declaraciones falsas. Algunos de los contenidos incluyen el logo de RTVE, pero no hay rastro de ellos en su página web ni en redes sociales.

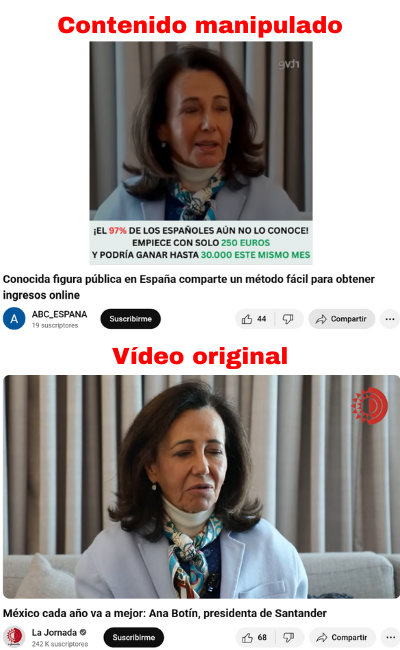

Los vídeos han sido alterados a partir de grabaciones originales en los que no se menciona ninguna plataforma de inversión. Por ejemplo, el vídeo de Yolanda Díaz procede de una rueda de prensa en Sevilla el 1 de julio y el de Ana Botín lo publicó el diario La Jornada (México) el 19 de febrero de 2025 durante la visita de la presidenta del banco Santander al país para presentar OpenBank.

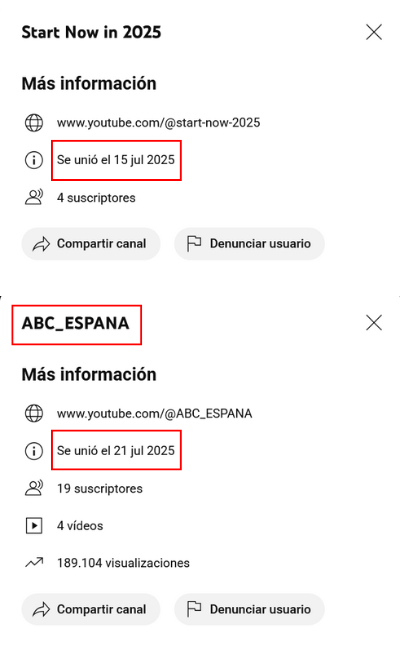

Por otro lado, la cuenta de YouTube que ha difundido los vídeos de Sánchez y Díaz, llamada Start Now in 2025, fue creada recientemente, el 15 de julio. El perfil que publica el vídeo manipulado de Ana Botín también es de nueva creación —se registró el 21 de julio—, utiliza el nombre del diario ABC y tiene otros vídeos manipulados de la presidenta del Banco Santander.

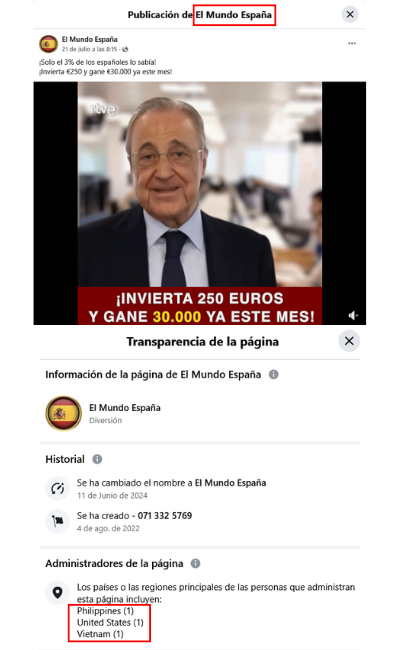

En el caso del vídeo de Florentino Pérez, ha sido compartido por una cuenta de Facebook que emplea el nombre del diario El Mundo y que está administrada desde Vietnam, Estados Unidos y Filipinas.

La Comisión Nacional del Mercado de Valores ya alertó de vídeos “falsos” que recomiendan “inversiones fraudulentas”

La CNMV alertó en diciembre de 2023 sobre intentos de “fraude” en los que se suplanta la identidad de famosos, e incluso de “responsables públicos”, para asignarles declaraciones que nunca se han producido.

“Entre los formatos utilizados, destacan vídeos falsos en los que se simula la voz de un personaje o de un responsable público para recomendar estas inversiones fraudulentas, lo que se conoce como deepfake”, afirma el organismo. Y añaden: “También se utilizan los diseños y apariencia de medios online para acreditar falsas informaciones sobre esos personajes”.

Este organismo recomienda a los usuarios extremar el cuidado, no facilitar ningún dato personal o dinero y animan a consultar las entidades autorizadas para captar legalmente inversiones por la CNMV en el buscador de registros oficiales disponible en su página web.

Las herramientas para generar vídeos con IA están al alcance de cualquier persona

Las herramientas que permiten generar vídeos con inteligencia artificial “son cada vez más accesibles, tanto para usuarios comunes como para ciberdelincuentes”, asegura Almudena Barreiro, experta en inteligencia artificial y maldita con superpoderes.

No hace falta tener conocimientos técnicos ni grandes recursos ya que estas herramientas “suelen ser muy asequibles o incluso gratuitas, ya que muchas de ellas obtienen ingresos a partir del uso masivo y de los datos que recopilan de sus usuarios”, afirma Barreiro. Esto facilita que los timadores generen vídeos que, aunque no sean perfectos, cumplen su objetivo: parecer creíbles y engañar a los usuarios.

Hacer un deepfake requiere tiempo y conocimientos en edición de vídeo y tratamiento de imágenes. En cambio, crear un cheapfake es muchísimo más sencillo. Los cheapfakes (adulteraciones baratas) son vídeos de baja calidad manipulados, editados o descontextualizados con el objetivo de difundir desinformación e intentos de timo.

Según Nieves Ábalos, cofundadora de Monocero Labs, estos contenidos utilizan tecnología más antigua o que requiere de menos inversión, por lo que “genera un resultado de peor calidad, más cheap”, de ahí el origen del nombre. Aún así, como ya os explicamos en Maldita.es, cualquier vídeo (más o menos cutre) sacado de contexto puede colárnosla.

Cómo evitar el timo de las falsas inversiones en criptomonedas

Hay varios consejos que te pueden ser de utilidad para no ser víctima de este tipo de timos:

Los timadores suelen utilizar la imagen de personajes conocidos y de medios de comunicación para promocionar el timo. Incluso usan testimonios falsos de supuestos expertos o clientes satisfechos.

Párate a pensar en cómo te ha llegado esa supuesta oportunidad única de inversión. Desconfía si la supuesta oferta te ha llegado por redes sociales y sin que la hayas solicitado.

Sospecha de supuestas inversiones sin riesgo que prometen una gran rentabilidad en poco tiempo y para la que piden una inversión inicial baja.

Debemos entender a la perfección el producto que estamos contratando. Desconfía si no te solicitan información sobre tu experiencia y conocimientos como inversor, tu situación financiera o tus objetivos de inversión.

Ojo con las llamadas y los correos electrónicos inesperados. Los timadores buscan ganarse la confianza de la víctima y también presionarla psicológicamente para que tome una decisión rápida.

Antes de invertir, debemos comprobar si la entidad con la que estamos tratando está autorizada por la CNMV para prestar servicios de inversión.

¿Qué puedes hacer si has sido víctima de este timo?

Dado que nos habéis escrito decenas de personas contándonos que habéis sido víctimas de este tipo de timos, hemos escrito un artículo con algunas recomendaciones para intentar recuperar el dinero o que, al menos, la situación no vaya a peor. Te dejamos aquí algunas claves:

Denuncia: si te han timado y has perdido dinero a través de estas webs es importante que acudas a la policía e interpongas una denuncia.

Acude a tu sucursal bancaria: una vez hayas puesto la denuncia, dirígete con ella a tu banco para que te asesoren e indiquen si puedes recuperar el dinero de alguna forma.

Ojo con las comunicaciones: la empresa que se esconde detrás del timo se pondrá en contacto contigo por correo electrónico y teléfono para formalizar la inversión y presionarte para que inviertas más dinero. No respondas.

No descargues ningún programa: nos contado que, tras invertir, los timadores os pidieron que os bajarais el programa de asistencia remota AnyDesk. No lo hagáis.

Cuéntanos tu caso: En Maldita.es estamos constantemente intentando averiguar cómo funcionan los timos que nos están intentando colar, por lo que nos gustaría hablar contigo para que nos cuentes el proceso. Puedes escribirnos a [email protected].

En este artículo han colaborado con sus superpoderes la maldita Almudena Barreiro Carrillo, experta en inteligencia artificial y ética.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.