“México ha declarado la guerra a Estados Unidos”, dice una supuesta periodista en lo que simula ser un telediario, pero ni ella ni la supuesta noticia son reales: el vídeo ha sido creado con inteligencia artificial (como identifica la etiqueta de TikTok). Como este, hay muchos otros vídeos en redes sociales que usan IA generativa para representar a periodistas (en su mayoría, mujeres) que relatan y muestran situaciones que no han ocurrido y que pueden desinformar a los usuarios, generar relatos falsos y alterar la percepción sobre personajes o hechos de actualidad. De hecho, algunos comentarios de usuarios indican que estos podrían creer que se trata de vídeos reales.

Expertos consultados por Maldita.es afirman que estos contenidos aprovechan la credibilidad y el rol social de las periodistas como “aliadas y voces del público” para transmitir estos mensajes de forma convincente. Por ejemplo, China, Venezuela y el Daesh han usado estos vídeos con IA de periodistas para promover propaganda. Los especialistas advierten que esto puede erosionar la confianza en los periodistas, medios de comunicación e instituciones.

Estos vídeos creados con IA de supuestas periodistas comunicando noticias y eventos que nunca sucedieron pueden desinformar

Usar IA generativa para crear vídeos y audios de supuestos periodistas, en su mayoría mujeres, comunicando situaciones que no ocurrieron es una práctica viral. Hay cuentas de TikTok que se dedican únicamente a publicar estos contenidos. Algunos usan el hashtag #humor en sus vídeos, como el de una señora mayor diciéndole a un periodista que no se meta en su vida.

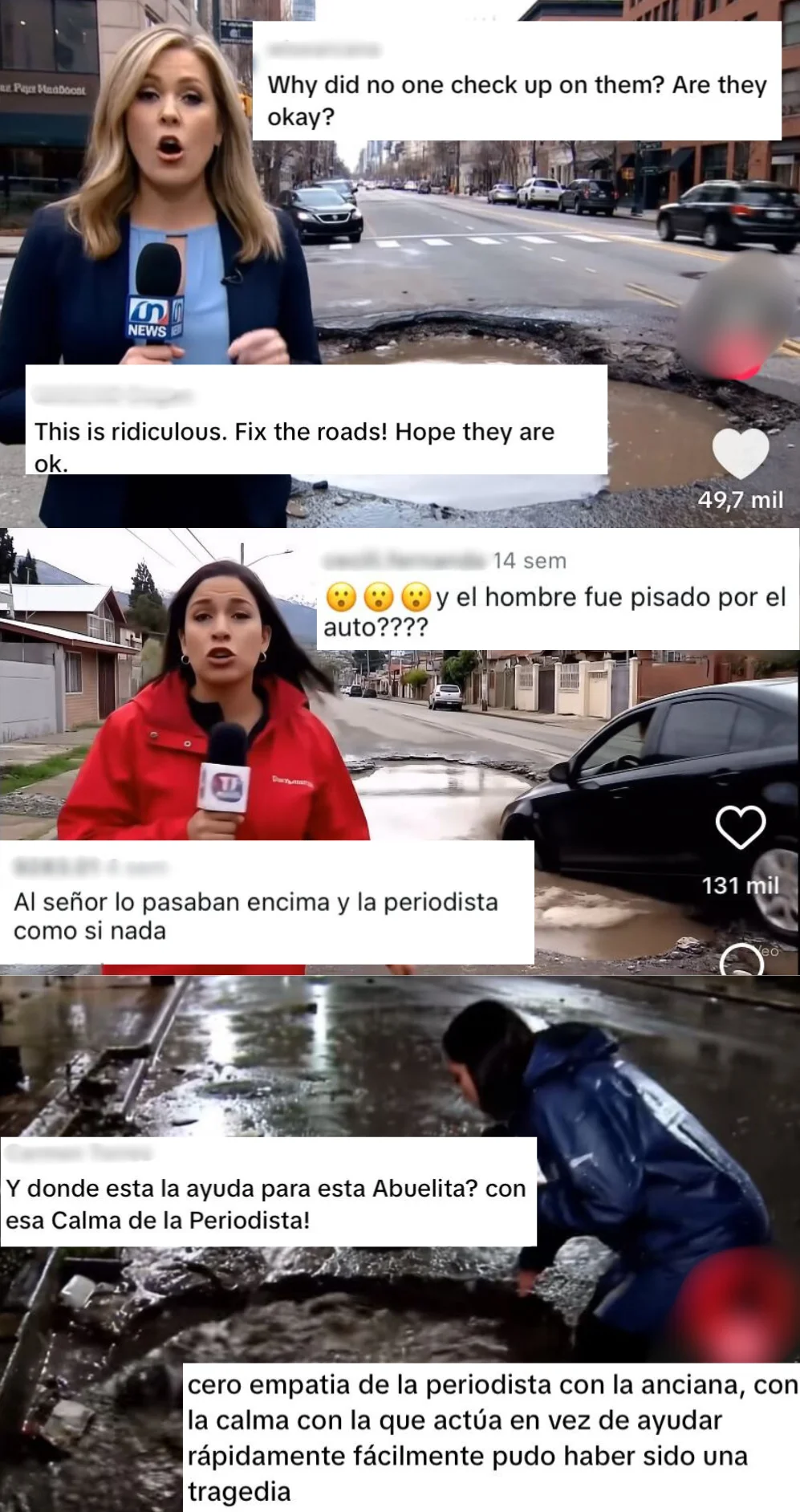

Pero en otros el objetivo no es tan claro a simple vista. Por ejemplo, en Maldita.es hemos identificado diversos vídeos creados con IA (que simulan ocurrir en distintos países) que muestran escenas similares de periodistas transmitiendo en directo desde socavones por los que caen personas y coches, contenidos que ya hemos desmentido en otras ocasiones. Por ejemplo, uno de ellos muestra a una supuesta reportera en Bariloche (Argentina), mientras un coche y una persona desaparecen dentro de un agujero en la calzada. A pesar de que en los comentarios hay usuarios advirtiendo del origen sintético de estos contenidos, otros parecen no saber que han sido creados con inteligencia artificial.

También circulan contenidos que simulan otros accidentes, como un vídeo creado con IA que muestra el derrumbe de un puente mientras una reportera está en directo.

Otros vídeos creados con IA de este tipo alertan de situaciones más graves. Por ejemplo, los hay de supuestas presentadoras de noticias anunciando que México ha declarado la guerra a Estados Unidos o que EEUU estaría a punto de recuperar el reclutamiento militar (no hay registro en fuentes fiables de ninguno de los supuestos hechos). También de reporteras comunicando sucesos como huracanes y supuestos homicidios, sin especificar dónde ni cuándo se habrían dado estos hechos.

También los hay ambientados en España. Es el caso de una cuenta de TikTok que se dedica a publicar “noticias falsas y realizadas con inteligencia artificial”, según su descripción, en las que se habla de supuestas medidas tomadas por el Gobierno español. Un ejemplo es el vídeo creado con IA donde aparece una supuesta periodista anunciando un nuevo impuesto a la cerveza desde el 1 de enero de 2026, algo que no es verdad. Los vídeos publicados por este usuario tienen la marca de agua de Sora, la red social de OpenAI que permite crear vídeos con IA y compartirlos, y que se está usando para la producción en masa de vídeos desinformadores. Los tres vídeos más populares de este perfil acumulan más de 1,3 millones de visualizaciones.

Varios de estos contenidos incluyen logos o nombres de canales de televisión reales, lo que puede engañar a los usuarios. Aunque estos vídeos cuentan con etiquetas en TikTok que indican su origen sintético, es fácil que circulen fuera de su contexto original y que esa etiqueta ya no sea visible. Todo esto puede provocar desinformación, generar falsos relatos y alterar la percepción sobre personajes y hechos de actualidad o históricos.

Usar la figura de una periodista permite simular credibilidad, pero esto puede erosionar la confianza en los periodistas, medios de comunicación e instituciones

¿Por qué crear periodistas con IA? Estos contenidos aprovechan el rol de los periodistas y medios de comunicación en la sociedad para simular credibilidad. Algo de lo que han tomado nota actores estatales y no estatales que también crean vídeos con IA de periodistas para amplificar sus narrativas. Ha sucedido en Venezuela para compartir desinformación y propaganda a favor del régimen de Maduro, y en China para “influenciar las elecciones taiwanesas”, según un análisis de The Guardian.

También lo ha hecho el Daesh (organización terrorista que se autodenomina “Estado Islámico”) con vídeos creados con IA de reporteros que comparten propaganda y simulan ser “un noticiario de Al Jazeera”, según The Washington Post, para “crear propaganda disfrazada de manera inocua, como una transmisión de noticias, lo que hace que sea más difícil para las empresas tecnológicas moderarla”.

“Los actores estatales y no estatales prefieren generar periodistas para difundir desinformación porque el periodismo se considera el ‘cuarto poder’ de la democracia”, indica a Maldita.es Viola Keta, periodista experta en desinformación. “A diferencia de otras figuras, los periodistas tienen un peso considerable porque son vistos como aliados y voces del público y, en cierto sentido, se convierten en las marionetas perfectas en manos de esos actores”.

En conversación con Maldita.es, Raúl Magallón, profesor del Departamento de Comunicación de la Universidad Carlos III que investiga sobre desinformación, sostiene que “su función es generar confusión en escenarios donde la información internacional hace que no conozcamos las fuentes de las que provienen este tipo de contenidos”.

Al igual que con las granjas de contenidos (sitios web que simulan ser medios de comunicación, pero con artículos de baja calidad), al disfrazarse de periodistas y medios reales, estos contenidos pueden engañar más fácilmente a los usuarios. “Con el lanzamiento público de poderosas herramientas de IA, hemos visto proliferar sitios de noticias de baja calidad difíciles de distinguir de una fuente confiable para el consumidor promedio, lo que reduce aún más la confianza en los medios”, sostuvo a Maldita.es McKenzie Sadeghi, editora de IA e influencia extranjera en NewsGuard, servicio de herramientas para combatir la desinformación.

Como sugiere Sadeghi, este uso de la imagen de los periodistas puede perjudicar la confianza en ellos y en los medios de comunicación, y también generalizar la desconfianza. “Esta erosión de la confianza crea un clima de sospecha y marca una regresión social, ya que intensifica la polarización y la desconfianza general hacia las instituciones, no sólo hacia los medios de comunicación”, advierte Keta.

Otros usos de la IA generativa para representar a periodistas

Estos vídeos creados con IA de periodistas se pueden usar para desinformar, pero también para concienciar sobre problemas reales. Es lo que hace un proyecto llamado AI Witness TV, que busca denunciar la dificultad que tienen los periodistas para entrar en Gaza y reportar sobre los ataques de Israel en la zona. "Israel prohíbe a los periodistas occidentales informar como testigos presenciales en Gaza. Imaginemos por un momento que un equipo logra entrar. Un experimento de IA que muestra cómo podría ser uno de sus reportajes. Los acontecimientos descritos son reales, pero nuestro reportero es generado con IA", señala la descripción del vídeo.

En este artículo ha colaborado Viola Keta, periodista experta en desinformación, integrante de MigraVoice.

MigraVoice es una comunidad transfronteriza de personas expertas migrantes o con contexto migratorio que se ponen a disposición de periodistas de medios europeos como fuentes de conocimiento de confianza. Si quieres aportar tu conocimiento a los medios de comunicación europeos, puedes registrarte aquí. Si eres periodista, y deseas consultar a las personas expertas de MigraVoice, puedes unirte aquí.

*Este artículo se ha actualizado el 31/10/2025 para incluir nuevos ejemplos de estos contenidos que se viralizan en España. Una versión anterior se puede consultar en este enlace.