En redes sociales se han viralizado imágenes y vídeos de los ataques entre Israel e Irán, pero no todos son reales (aunque se compartan como tal): varios contenidos han sido creados con IA generativa. Durante los 12 días de bombardeos entre Irán e Israel (Donald Trump dijo que era oficial el alto el fuego este 24 de junio), han circulado contenidos generados con IA que muestran, en su mayoría, graves daños provocados por Irán a Israel, como Tel Aviv destruida y aviones israelíes derribados.

Algunos líderes políticos también han compartido en Twitter (ahora X) imágenes con indicios de haber sido creadas con IA sobre el conflicto, como el ayatolá Ali Jamenei, que compartió una imagen con símbolos nacionales iraníes, misiles y un mensaje religioso, y el ministro de Defensa israelí Israel Katz, que publicó una imagen que ridiculiza a Jamenei.

Mientras se viralizaban estos contenidos desinformadores creados con IA, el acceso a la información de los ciudadanos en Irán e Israel ha estado restringido, según reportes. Como sucede con los ataques de Israel a Gaza o la guerra en Ucrania, los contenidos creados con IA sobre hechos históricos o de actualidad que se difunden como reales pueden generar falsos relatos, alterar la percepción sobre personajes y acontecimientos, y aumentar la desconfianza ciudadana.

Circulan vídeos creados con IA que muestran que Israel habría sufrido graves daños por los ataques iraníes

La noche del 12 de junio de 2025 Israel atacó a Irán. En los días siguientes se repitieron ataques y bombardeos entre ambas partes. En redes sociales, circulan vídeos creados con IA que supuestamente muestran los efectos de dichos enfrentamientos, en especial, sobre Israel.

En Maldita.es hemos identificado varios de ellos que muestran a Israel destruida o con graves daños por los ataques iraníes. Por ejemplo, este vídeo en TikTok que supuestamente muestra una gran explosión en Israel por los ataques iraníes que en su publicación original cuenta con la etiqueta de generado con IA. Lo mismo sucede con otro vídeo que supuestamente muestra a Israel en llamas, cuyo autor también etiquetó como creado con inteligencia artificial.

También ha circulado un vídeo que supuestamente muestra el aeropuerto internacional Ben Gurión en Israel “después del ataque con misiles iraníes”. El original fue compartido por un perfil de Instagram y TikTok llamado ‘3amelyon’, en cuya descripción se puede leer el mensaje “la resistencia de la inteligencia artificial”, en una traducción del árabe al español.

La misma cuenta también ha subido otros contenidos con indicios de haber sido creados con IA. Entre ellos, hay un vídeo (publicado el 27 de mayo de 2025) que muestra supuestamente varios edificios destruidos en Tel Aviv. Este vídeo se ha vuelto a viralizar durante los ataques de junio y lo ha compartido el medio iraní Tehran Times en su cuenta de X, donde tiene más de 1,9 millones de visualizaciones, con el mensaje: “El día del juicio final en Tel Aviv”.

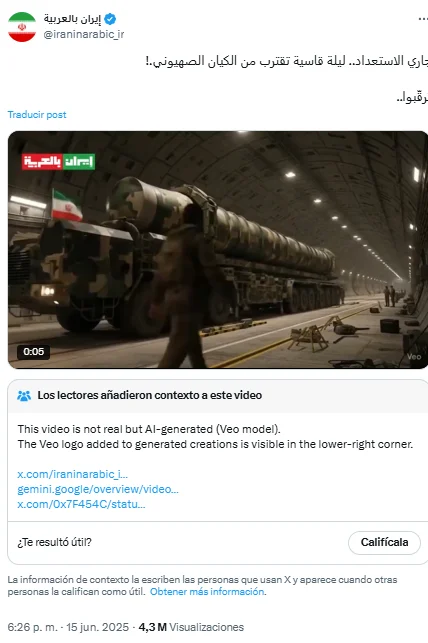

Otro vídeo, que ha sido visto más de 4,3 millones de veces en X, muestra un misil enorme y se comparte con mensajes como “preparándose... ¡Se acerca una noche dura para la entidad sionista! Estén atentos…”. El contenido tiene en la esquina inferior derecha una marca de agua de Veo, el modelo de generación de vídeo con IA de Google.

También se difunden imágenes creadas con IA que muestran los supuestos daños a Israel, varias de ellas de aviones israelíes y estadounidenses supuestamente derribados por Irán

Además de vídeos, han circulado imágenes creadas con IA que simulan ser fotografías y que también muestran los supuestos graves daños que habría provocado Irán a Israel, particularmente de aviones israelíes y estadounidenses derribados o dañados.

Un ejemplo de ello es esta imagen que supuestamente muestra un bombardero B-2 estadounidense que ha sido derribado por Irán (según el mensaje que la acompaña). Los verificadores de Snopes la han identificado como creada con IA y han señalado que el usuario que la publicó ha dicho que “es sarcástica”. Según el análisis de Snopes, algunos indicios de que ha sido creada con IA son que la nave parece más pequeña que un bombardero B-2 real, que no hay sombras bajo la bandera o detrás de los soldados y que el palo que sostiene el cartel no llega al suelo.

También hay imágenes que representan los aviones israelíes F-35 que, según los medios de comunicación de Irán, habrían sido derribados por el ejército iraní (algo que las Fuerzas de Defensa de Israel han negado). Una de ellas que muestra al supuesto avión de combate derribado en el desierto y rodeado de personas que parecen ser más altas que las casas y edificios que tienen detrás, ha sido identificada por AFP Fact Check como creada con IA.

En Maldita.es hemos usado la búsqueda inversa de Google, donde se indica que la imagen ha sido “creada con la IA de Google”. La compañía etiqueta así las imágenes cuando tienen datos que indican que han sido generadas con esta tecnología. Estos datos pueden venir de dos lugares: por un lado, la Coalition for Content Provenance and Authenticity (C2PA), un estándar técnico que rastrea el origen del contenido; y por otro, la marca de aguaSynthID, que está insertada en los contenidos creados con la IA de Google.

Otra imagen circula con mensajes como “una foto de uno de los F-35 derribados por Irán. Israel está perdiendo”. En esta, el avión aparece sobre hierba, con la cola desprendida y el motor encendido. Tanto los verificadores de Demagog (Polonia) y de Greece Fact Check (Grecia), miembros del European Fact-Checking Standards Network (EFCSN) al igual que Maldita.es, aseguran que la imagen ha sido creada con inteligencia artificial.

Hay varios indicios de ello: la imagen viral tiene la estrella de David en la parte trasera del avión, pero fotos compartidas por el Ministerio de Defensa de Israel muestran que los F-35 reales la tienen en la parte delantera (además de que el diseño de las estrellas no coincide). Otra señal es que uno de los estabilizadores del avión (la aleta en la parte superior) está orientado en la dirección incorrecta.

También hay imágenes creadas con IA de los ataques. Por ejemplo, esta imagen que, según los mensajes que la acompañan, muestra un bombardeo sobre la ciudad de Israel con varios misiles iraníes cayendo del cielo. Maldita.es ha podido comprobar a través de la búsqueda inversa que algunos contenidos incluyen la misma imagen con la firma de ‘Mhamad Yusif’, un diseñador gráfico de Egipto que trabaja “con contenido de inteligencia artificial” y publicó la imagen en sus redes sociales (como Facebook e Instagram) el viernes 13 de junio de 2025.

Líderes políticos también han compartido imágenes con indicios de haber sido creadas con IA como propaganda o para burlarse del otro bando

También hay imágenes con indicios de haber sido creadas con IA sobre el conflicto que no vienen de usuarios comunes, sino de los líderes políticos de Irán e Israel que la usan como propaganda o para ridiculizar al otro bando. Los periodistas Matthew Gault y Emanuel Maiberg de 404 Media advierten en su newsletter de ello: “Los líderes de estos países están compartiendo bazofia de IA [contenidos de baja calidad creados con IA] para difundir las formas más antiguas de xenofobia y propaganda”.

Un ejemplo de ello es la imagen publicada por el ayatolá Ali Jamenei en la que aparece el emblema de Irán y misiles saliendo de su alrededor. La publicó el 6 de junio de 2025 y tiene más de 6,1 millones de visualizaciones, con el mensaje: “La República Islámica triunfará sobre el régimen sionista por la voluntad de Dios”.

La imagen tiene indicios de haber sido creada con IA. Por ejemplo, las banderas no flamean en la misma dirección, la forma de las nubes y del humo de los misiles parece demasiado perfecta, y hay un brillo poco natural en toda la imagen. Según la búsqueda inversa de Google, tampoco ha sido compartida por fuentes fiables de información.

El ministro de Defensa de Israel, Israel Katz, lo hizo antes en relación a este mismo conflicto. En septiembre de 2024 publicó esta imagen que muestra el rostro del ayatolá dentro de un huevo roto. La publicación, con más de 174.000 visualizaciones en el momento de publicación de este artículo, dice: “Irán es como un huevo: duro por fuera y blando por dentro”.

El acceso a la información se ha visto limitado durante el conflicto. A la vez, se viralizan estos contenidos que desinforman, crean falsos relatos y alteran la percepción sobre lo que de verdad ha sucedido

Todos estos contenidos desinformadores han circulado en un contexto en el que el acceso a la información de los ciudadanos iraníes e israelíes ha sido limitado. Irán restringió el acceso a internet durante días y prohibió a corresponsales internacionales informar desde el país, mientras que Israel “está reduciendo la libertad de expresión” en el país, según DW.

“El contenido generado con IA de origen desconocido está llenando el vacío creado por los apagones mediáticos sancionados por el Estado con desinformación”, explican Gault y Maiberg.

Esto puede tener un impacto en las personas en el presente y a largo plazo, ya que los contenidos creados con IA sobre hechos históricos y de actualidad que se difunden como reales pueden provocar desinformación, generar falsos relatos, alterar la percepción sobre personajes y hechos, y aumentar la desconfianza ciudadana.

Según Esther Escudero, arqueóloga, ilustradora y maldita que nos prestó sus superpoderes, en estos casos en los que los contenidos tratan eventos históricos el peligro puede ser mayor, “llegando a consecuencias políticas peligrosas”. Esto es algo que ya sucedía con otras herramientas digitales de edición de imagen, como Photoshop. Así que con la IA no nace un nuevo peligro, pero sí que se puede perpetuar y extender gracias a la popularización de estas herramientas.

“La víctima de esta guerra de IA es la verdad”, afirmó Hany Farid, profesor de la Universidad de California Berkeley, a 404 Media. El experto en detección de deepfakes sostuvo que los contenidos creados con IA permiten a las partes alegar que cualquier vídeo que muestre, por ejemplo, un ataque o violaciones a los derechos humanos es falso. “Encontrar la verdad en tiempos de conflicto siempre ha sido difícil, y ahora, en la era de la IA y las redes sociales, es aún más difícil”, sostiene.

Los contenidos creados con IA se han vuelto recurrentes en las situaciones de conflicto. Ya lo hemos visto con los bombardeos de Israel sobre Gaza, de los que han circulado vídeos manipulados, imágenes creadas con IA y se han clonado voces de personas relevantes; o con la famosa imagen creada con IA de ‘All Eyes on Rafah’, que se viralizó en redes sociales en señal de protesta contra los ataques en la zona. También ha sucedido con la guerra en Ucrania: en marzo de 2022 circuló un vídeo creado con IA del presidente Volodímir Zelenski en el que pedía a sus tropas que se rindieran.

En este artículo ha colaborado con sus superpoderes la maldita Esther Escudero, arqueóloga e ilustradora.

Esther Escudero forma parte de Superpoderosas, un proyecto de Maldita.es que busca aumentar la presencia de científicas y expertas en el discurso público a través de la colaboración en la lucha contra la desinformación.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.