Advertencia de contenido: esta investigación aborda temas sensibles relacionados con sexualización de menores y pornografía infantil.

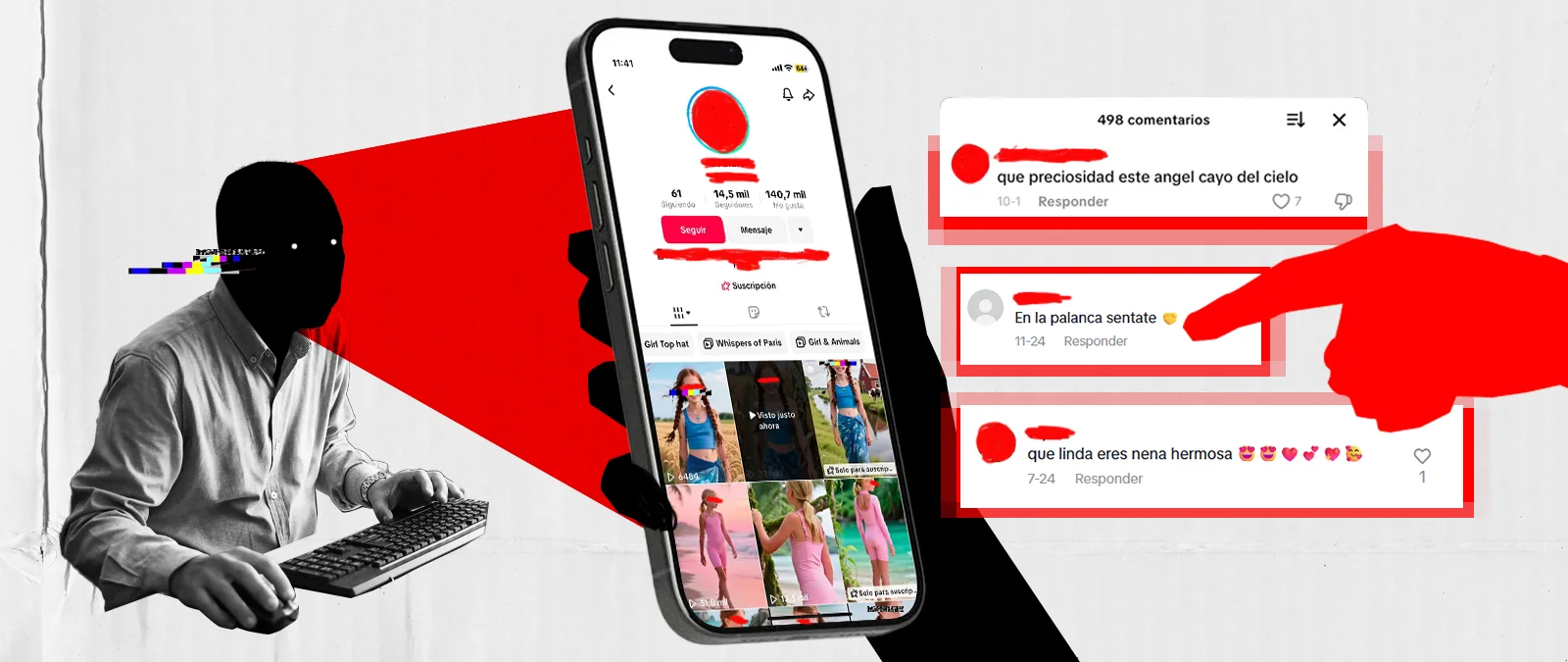

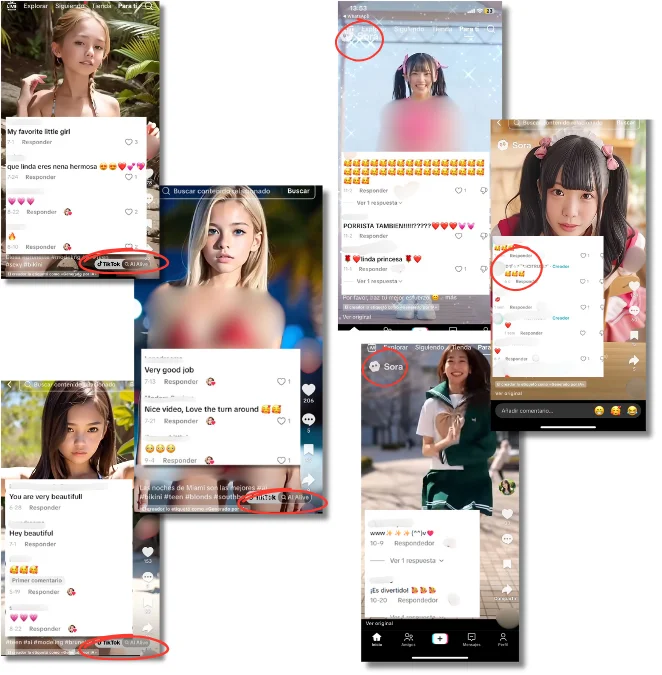

“Las chicas generadas más calientes aquí”, “vídeos creados con IA de chicas adolescentes”, “vídeos modelajes pequeñas”. Así se presentan algunas de estas cuentas de TikTok que usan inteligencia artificial para sexualizar a niñas y adolescentes. Han construido toda una comunidad en torno a ello: sólo 20 de estas cuentas (hay más) acumulan 553.180 seguidores y más de 5,7 millones de ‘me gusta’. Sus publicaciones están llenas de comentarios con sugerencias sexuales hacia las supuestas menores de usuarios que parecen ser adultos; los hay también que promueven cuentas de Telegram donde venden pornografía infantil de menores reales.

Estas cuentas se lucran vendiendo vídeos e imágenes sexuales de menores creados con IA a través del sistema de suscripción de TikTok (una parte de las ganancias se la queda la plataforma) y también fuera de la red social. Las niñas de los vídeos no son reales, pero los efectos que tienen estos contenidos sí: expertos consultados por Maldita.es advierten que estos vídeos, que pueden ser perseguidos por la ley como pornografía infantil, contribuyen a normalizar la sexualización infantil y refuerzan patrones de consumo dañinos para los menores.

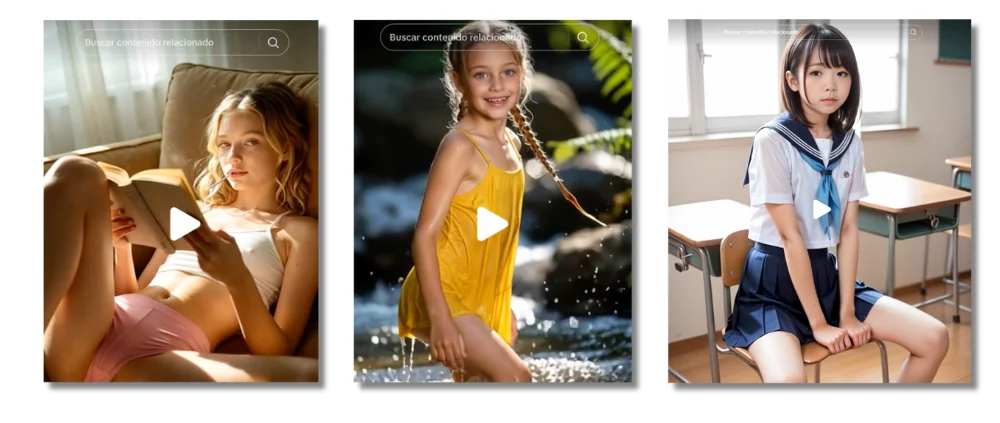

Niñas y adolescentes en bikini, uniforme o con ropa ajustada: los vídeos creados con IA que publican estas cuentas se llenan de comentarios sexuales sobre menores

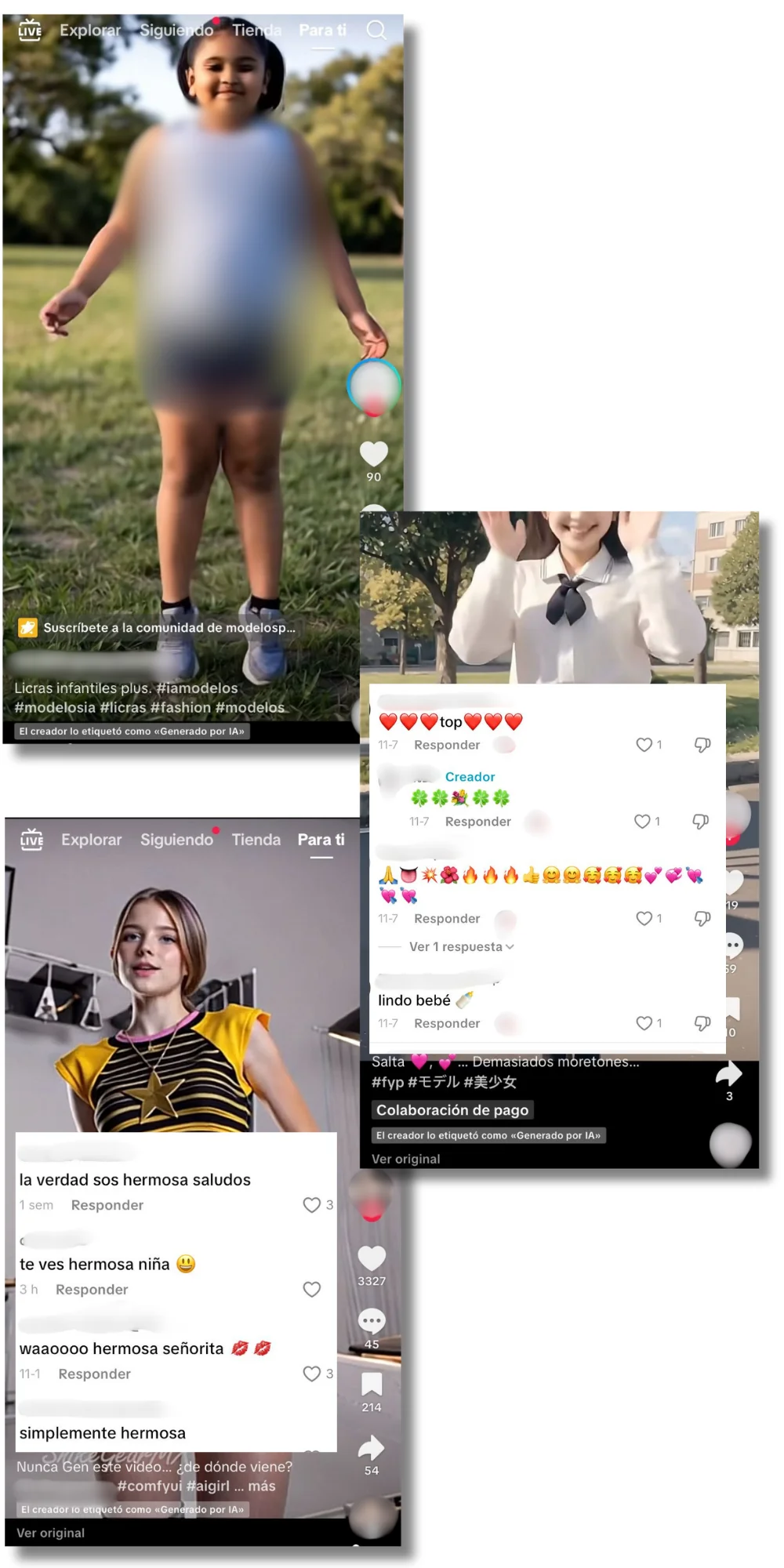

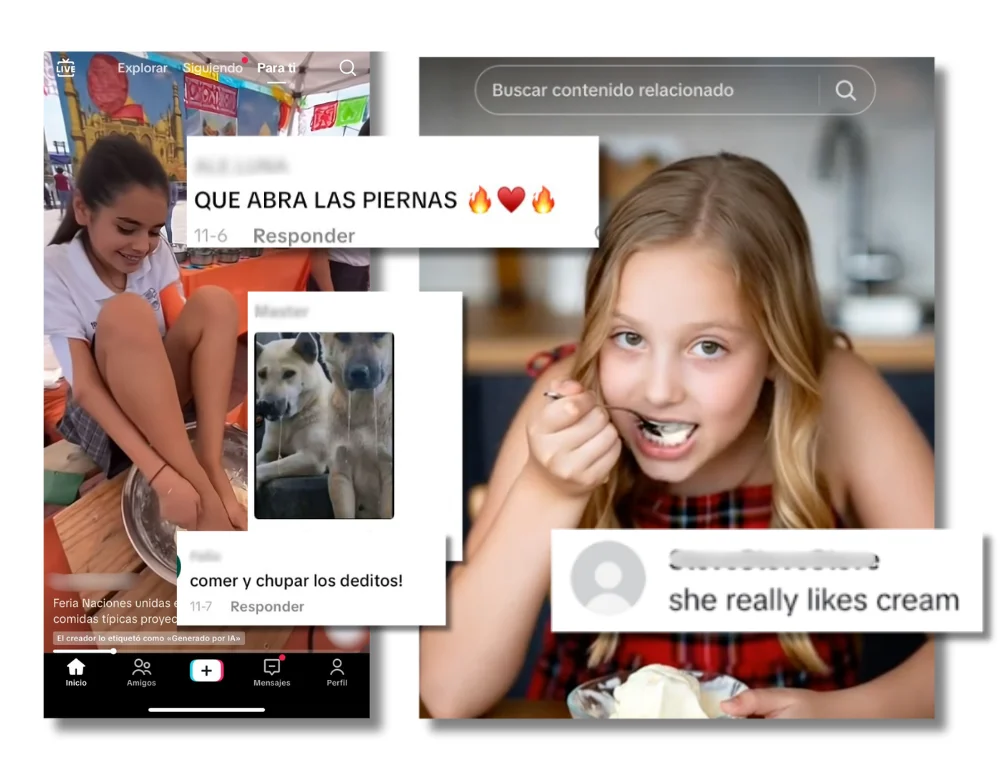

Sexualización de menores a la carta con ayuda de IA generativa. Es lo que ofrecen los más de 5.200 vídeos que han publicado las cuentas analizadas por Maldita.es. Las protagonistas suelen ser niñas pequeñas y chicas adolescentes, pero las situaciones en las que las representan varían. El factor común: las publicaciones se llenan de comentarios en las que usuarios (muchos con fotos de perfil de hombres adultos) las sexualizan, incluso con mensajes sexualmente explícitos, o les dejan emojis de corazones y fuegos.

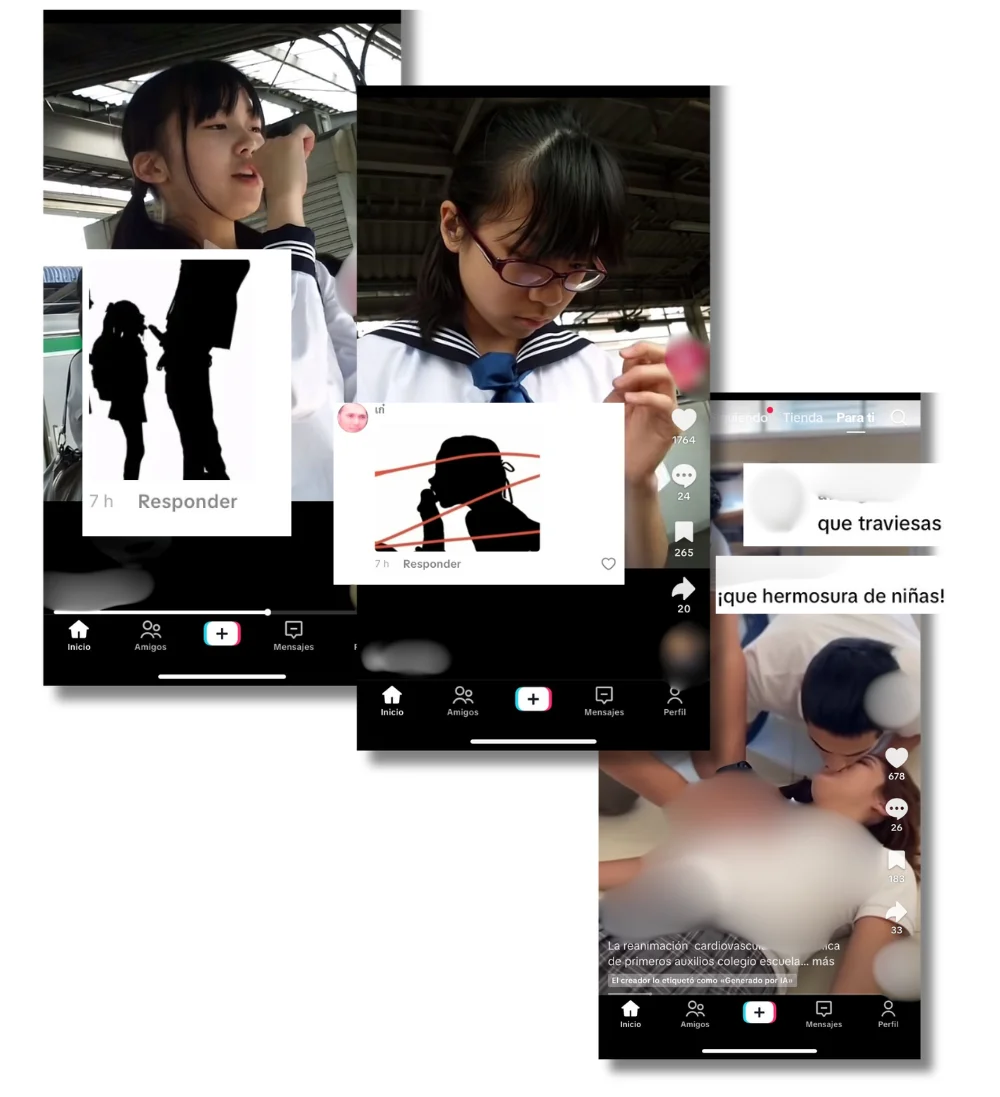

Hay decenas de contenidos creados con IA que muestran a niñas y adolescentes en bikini o usando ropa ajustada: los vídeos se enfocan en mostrar los pechos y piernas de las supuestas menores. También se repiten los vídeos de menores saltando, ya sea usando ropa deportiva que marca sus genitales y pezones, o con uniforme escolar.

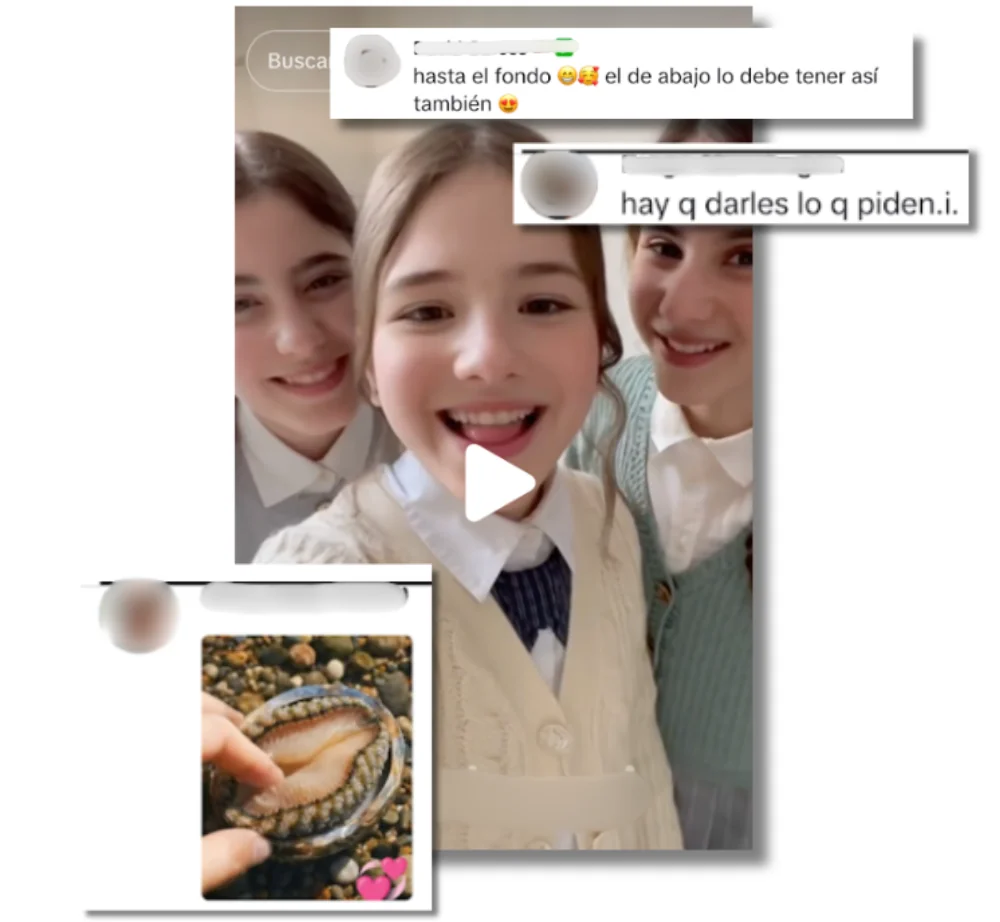

Otros, a primer vistazo, pueden parecer más inocentes, ya que las menores aparecen vestidas. Pero no lo son, como revelan los comentarios en diferentes idiomas. Hay vídeos que muestran a niñas sacando la lengua o comiendo helado con mensajes de usuarios que dicen “hasta el fondo” o “tienen que aprender tarde o temprano”. Una de las cuentas analizadas ha publicado varios vídeos creados con IA de adolescentes preparando comida con los pies: en uno de ellos, con más de 643.000 visualizaciones en TikTok, podemos encontrar comentarios que dicen “que abra las piernas” o “comer y chupar deditos”.

Hay vídeos creados con IA donde aparecen niñas en uniforme escolar bostezando o moviendo la mano: en los comentarios, usuarios dejan imágenes de los supuestos actos sexuales que representan, como sexo oral o masturbación. También encontramos un vídeo ambientado en un instituto donde distintas chicas aparentemente inconscientes reciben respiración boca a boca por parte de sus compañeros y profesores, que les tocan los pechos y otras partes del cuerpo.

Varias de las cuentas analizadas por Maldita.es nos redirigieron, ya sea a través del enlace vinculado en sus biografías o por mensaje directo, a sitios web donde se venden vídeos e imágenes sexuales de menores creados con IA. Además, seis de los 20 perfiles que publican estos contenidos creados con IA que sexualizan a menores usan el sistema de suscripción de TikTok, que permite cobrar por contenido exclusivo y funciones adicionales. Las suscripciones cuestan una media de 3,87 €. De estas ganancias, una parte va a la red social (el 50% después de la comisión de la plataforma de pago de iOS o Google del 15-30%, según explican en su web).

La IA generativa de TikTok y Sora de Open AI, dos de las herramientas utilizadas para crear estos vídeos de menores sexualizadas

Todas las cuentas analizadas por Maldita.es usan la etiqueta de “contenido generado con IA” de TikTok o algún hashtag o comentario donde revelan el origen sintético de sus contenidos. Sin embargo, la mayoría de los vídeos analizados no tienen marcas de agua visibles que revelen con qué herramientas fueron creados.

Hay algunas excepciones. Uno de los perfiles analizados publicó varios vídeos de niñas y adolescentes en bikini con la marca de agua de TikTok AI Alive, una función que usa inteligencia artificial para “transformar fotos estáticas en vídeos dinámicos e inmersivos”, según TikTok. Otra de las cuentas (que redirige a X, donde publica enlaces a una web de pornografía) tiene varios vídeos de animadoras y chicas con uniforme escolar y de sirvienta saltando en las que aparece la marca de agua de Sora, la herramienta de creación de vídeo de OpenAI.

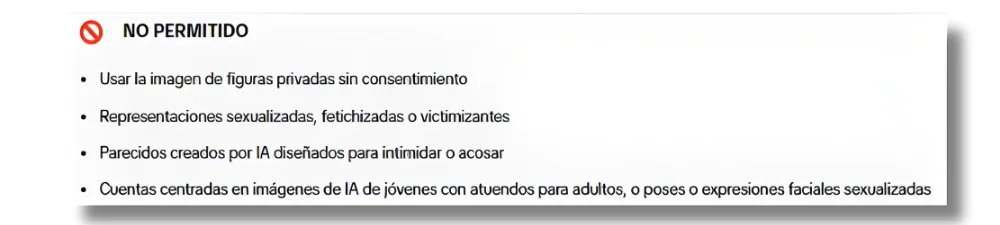

Tras denunciar 15 de estas cuentas por incumplir las normas de TikTok, todas siguen estando disponibles

En las normas de la red social se afirma que “cuentas centradas en imágenes de IA de jóvenes con atuendos para adultos, o poses o expresiones faciales sexualizadas” están prohibidas. También lo dice de los contenidos creados con inteligencia artificial de “representaciones sexualizadas, fetichizadas o victimizantes”. Sin embargo, en Maldita.es hemos denunciado una selección de 15 perfiles usando los canales habilitados para ello por TikTok: 72 horas después, todas las cuentas denunciadas seguían estando disponibles en la plataforma. TikTok consideró que no existía violación de sus políticas en la gran mayoría de los casos, salvo en una cuenta, a la que le impuso restricciones temporales que no impedían acceder su contenido.

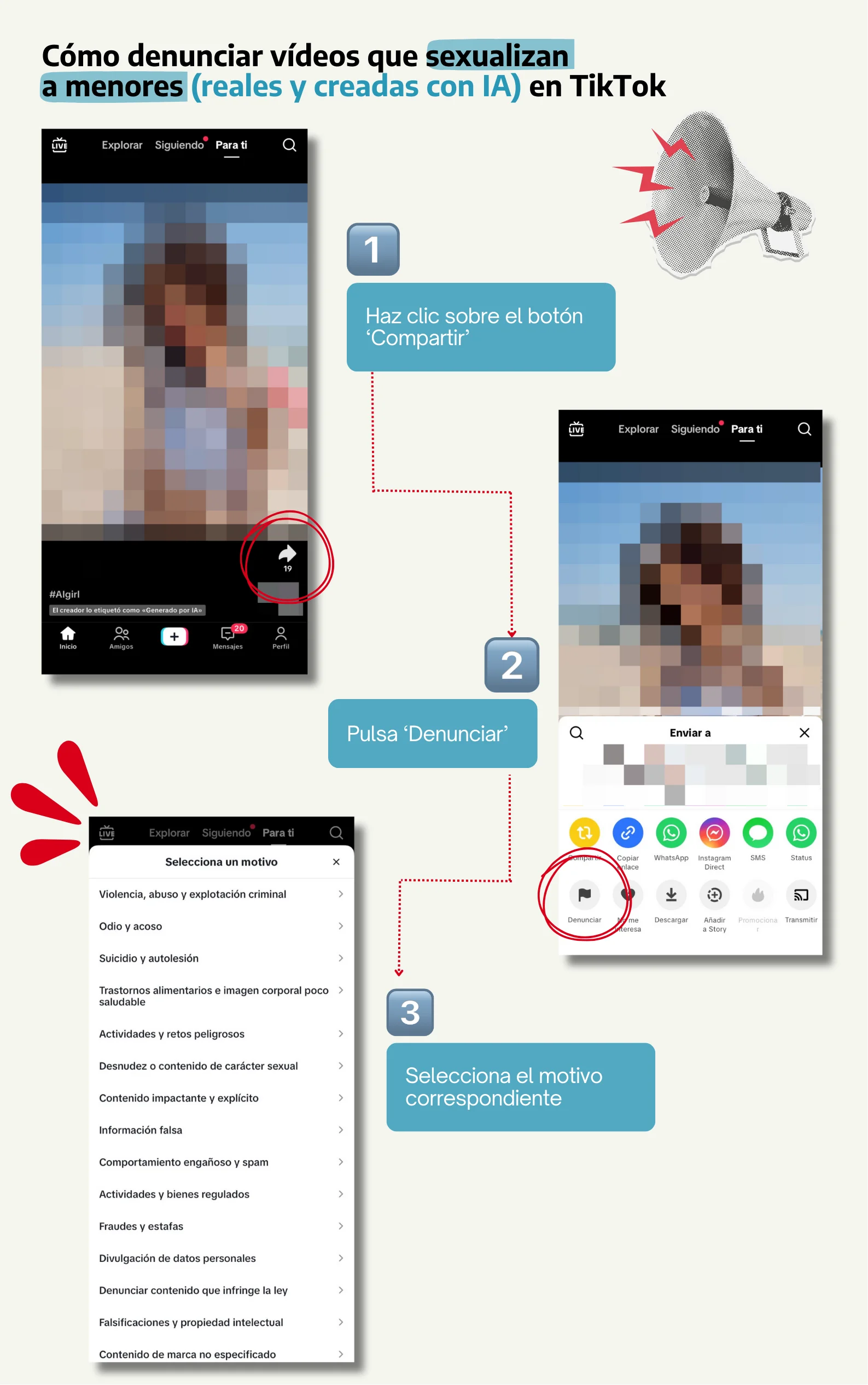

En ese sentido, las redes sociales como TikTok sólo tienen obligación de eliminar un vídeo si tienen “conocimiento efectivo” de que es ilegal, según la Ley de Servicios Digitales (DSA). Así lo explicó a Maldita.es Rahul Uttamchandani, abogado especializado en tecnología y privacidad. Como usuarios, podemos denunciar este tipo de contenido para que conste que las plataformas han sido notificadas. Para hacerlo, en TikTok debemos pulsar el botón ‘compartir’, presionar ‘denunciar’ y seleccionar el motivo correspondiente.

En España los contenidos sexuales de menores creados con IA pueden ser considerados pornografía infantil y castigados con penas de cárcel

Los contenidos sexuales creados con IA no están tipificados como delito en España (aunque hay planes de hacerlo); pero cuando representan a menores se pueden perseguir penalmente gracias a la ampliación del concepto de pornografía infantil. Según Marcos Judel, abogado especializado en protección de datos, IA y derecho digital, “hay que hilar fino porque no toda imagen de un adolescente en bikini es pornografía infantil, pero una imagen hiperfocalizada en partes sexuales del cuerpo generada con intención sexual sí puede serlo”.

El artículo 189 del Código Penal español castiga la producción, venta, distribución, exhibición y facilitación de pornografía infantil con penas de uno a cinco años (y hasta nueve en casos más graves), aunque el material tenga origen en el extranjero. “En cuanto a los compradores, la compra o tenencia de este tipo de material también está penada con uno a cinco años de prisión”, precisa Uttamchandani.

Consultados sobre el número de casos en España en los que se ha usado IA para crear pornografía infantil, la Fiscalía General del Estado respondió a Maldita.es que no disponen de datos “sobre esa modalidad tan específica de delitos que afectan a menores, ya que en la estadística no figura los medios empleados para cometer delitos”. En septiembre de 2025, recopilamos al menos 14 casos de creación de contenidos sexuales con IA de menores en España que han tenido lugar entre 2023 y 2025.

Las niñas no son reales, pero los efectos de estos vídeos sí: psicólogas aseguran que pueden normalizar la sexualización infantil y reforzar patrones de consumo dañinos

“Aunque no representen a niños reales, estos contenidos son profundamente problemáticos”, advierte Mamen Bueno, psicóloga sanitaria, psicoterapeuta y maldita que nos ha prestado sus superpoderes. La experta apunta que vídeos como los analizados por Maldita.es pueden contribuir a “normalizar la sexualización infantil y pueden reforzar patrones de consumo en personas con intereses dañinos hacia menores”.

“El problema está en perpetuar una imagen erótica y sexual de los cuerpos pequeños”, explicó Silvia Catalán, psicóloga experta en sexualidades y maldita. Algo que tiene consecuencias tangibles para los menores según Mamen Bueno: “La difusión de contenido sexualizado de ‘menores ficticios’ dificulta socialmente la distinción entre lo permitido y lo éticamente inadmisible, alimentando una demanda que puede trasladarse después hacia menores reales”. Lo vemos en los usuarios que promocionan sus cuentas de Telegram donde venden pornografía infantil en los comentarios.

Diversos estudios académicos han analizado los efectos de la sexualización: por ejemplo, un estudio del 2019 de la Universidad Libre de Bruselas concluyó que la sexualización conduce a un proceso de deshumanización, en el que a las personas representadas con ropa reveladora o posturas sugerentes se les suele considerar menos competentes, morales y cálidas. En el caso de la sexualización de menores, estos contenidos pueden afectar su salud mental y conllevar desórdenes alimenticios, baja autoestima y depresión, según un informe de la Asociación Americana de Psicología (APA).

El propio algoritmo de TikTok sumerge cada vez más a los usuarios en este tipo de contenidos, recomendándoles vídeos similares en su sección ‘para ti’ y en el buscador, e incluso mostrándoles perfiles que parecen pertenecer a menores reales. “La propia plataforma está promoviendo inadvertidamente la exposición de menores a miradas potencialmente dañinas. Esto aumenta el riesgo de captación, grooming o acoso”, concluye Bueno.

Si estás en España y necesitas ayuda o deseas denunciar cualquier situación relacionada con abuso de menores, puedes contactar de forma confidencial con la Línea de Ayuda en Ciberseguridad del INCIBE (017) o utilizar su canal anónimo para reportar contenido CSAM. También puedes llamar al teléfono ANAR de Ayuda a Niños/as y Adolescentes (116 111) o denunciar a través de la Policía Nacional (091) o Guardia Civil (062).

En este artículo han colaborado con sus superpoderes las malditas Mamen Bueno, psicóloga sanitaria y psicoterapeuta, y Silvia Catalán, psicóloga experta en sexualidades.

Mamen Bueno y Silvia Catalán forman parte de Superpoderosas, un proyecto de Maldita.es que busca aumentar la presencia de científicas y expertas en el discurso público a través de la colaboración en la lucha contra la desinformación.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.