Advertencia de contenido: esta investigación aborda temas sensibles relacionados con sexualización de menores y pornografía infantil.

Pepe abre TikTok y lo primero que ve es un vídeo de una menor en uniforme preparando comida con sus pies. El vídeo tiene la etiqueta de “generado con IA” de la plataforma. Desliza hacia arriba y aparece una adolescente, ahora real, bailando. Vuelve a scrollear y ahora son dos niñas pequeñas cantando. En los comentarios ve decenas de mensajes sexualmente explícitos hacia ellas (como “tienen que aprender tarde o temprano” o “ya entra todo”); otros comentarios promocionan cuentas de Telegram donde venden pornografía infantil.

Pepe no es real, es el perfil que usamos para adentrarnos en las cuentas que publican contenido que sexualiza a menores en TikTok para ganar dinero. Nuestra experiencia ha sido así: el algoritmo de TikTok nos recomendó vídeos de este tipo en el ‘para ti’ y buscador, metiéndonos en un bucle de publicaciones que sexualizan a niñas y adolescentes, y poniéndonos a sólo unos clics de distancia de pornografía infantil, tanto real como generada con IA. Esto, a pesar de que la red social tiene que cumplir con las obligaciones de la DSA sobre la protección de menores y retirar contenido ilícito si sabe que circula, y de que sus propias reglas prohíben la sexualización de menores.

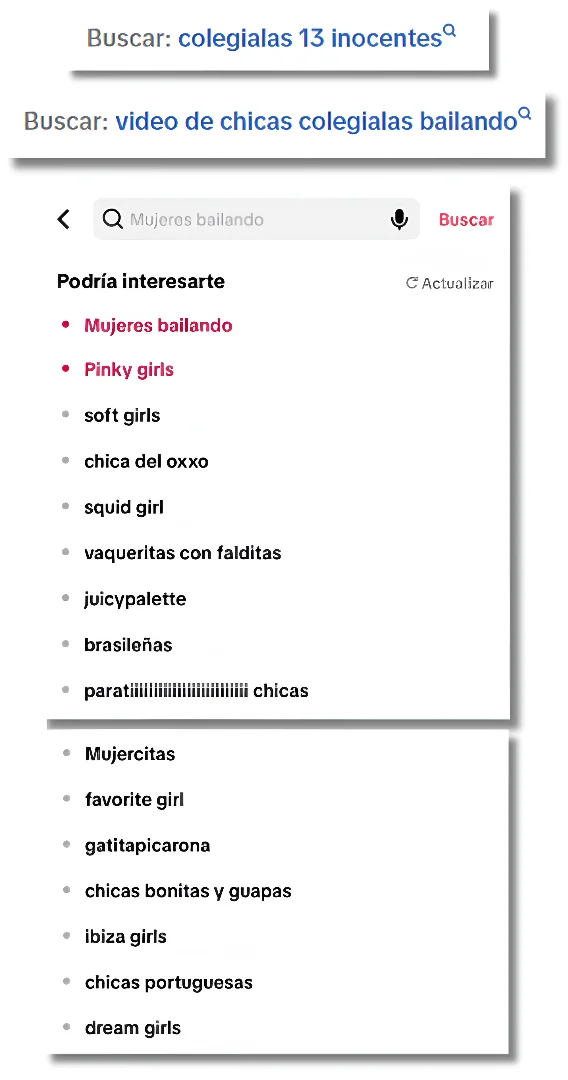

“Colegialas 13 inocentes”: las búsquedas que nos recomendó TikTok tras ofrecernos videos que sexualizan a menores reales y creadas con IA con comentarios de usuarios que ofrecen pornografía infantil en el ‘para ti’

TikTok decide qué muestra a sus usuarios gracias a su algoritmo de recomendación, que se basa en los gustos y hábitos de estos para sugerirles contenido. Esto también aplica a Pepe, que quiere ver vídeos de menores en actitudes sexuales. Así lo hemos comprobado con la cuenta que utilizamos para este análisis: el ‘para ti’ de Pepe le fue sumergiendo en una espiral de vídeos que sexualizaban a menores, mostrándonos una y otra vez vídeos de niñas y adolescentes reales y creadas con IA llenos de comentarios sexualmente explícitos.

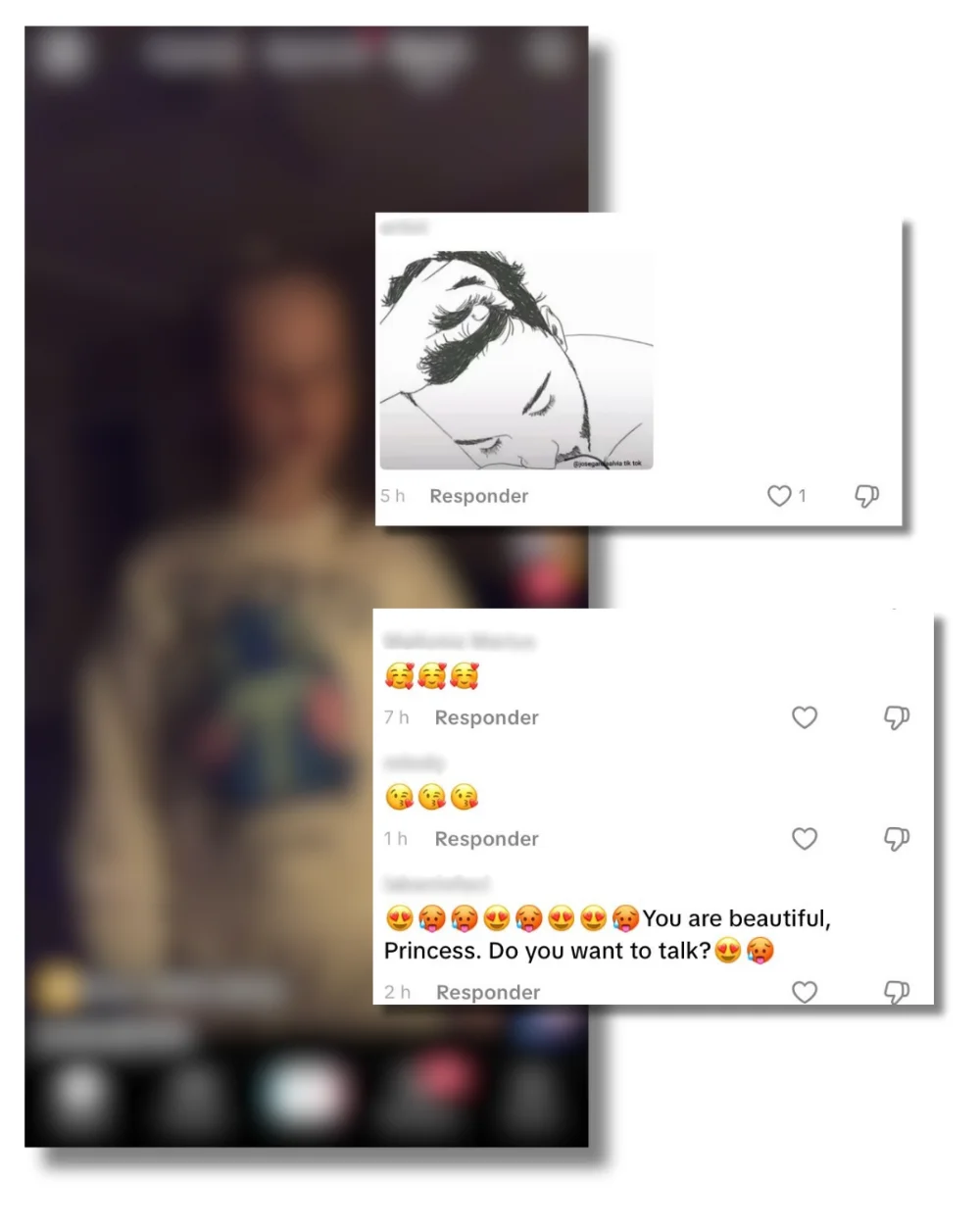

En varias ocasiones el algoritmo le enseñó a Pepe perfiles que parecían pertenecer a menores reales. Es el caso de un vídeo que nos recomendó el algoritmo de una niña pequeña real bailando, que tiene más de 5.000 visualizaciones, donde hay comentarios con imágenes de escenas de sexo oral y otros que le dicen a la menor que es hermosa y que quieren hablar con ella.

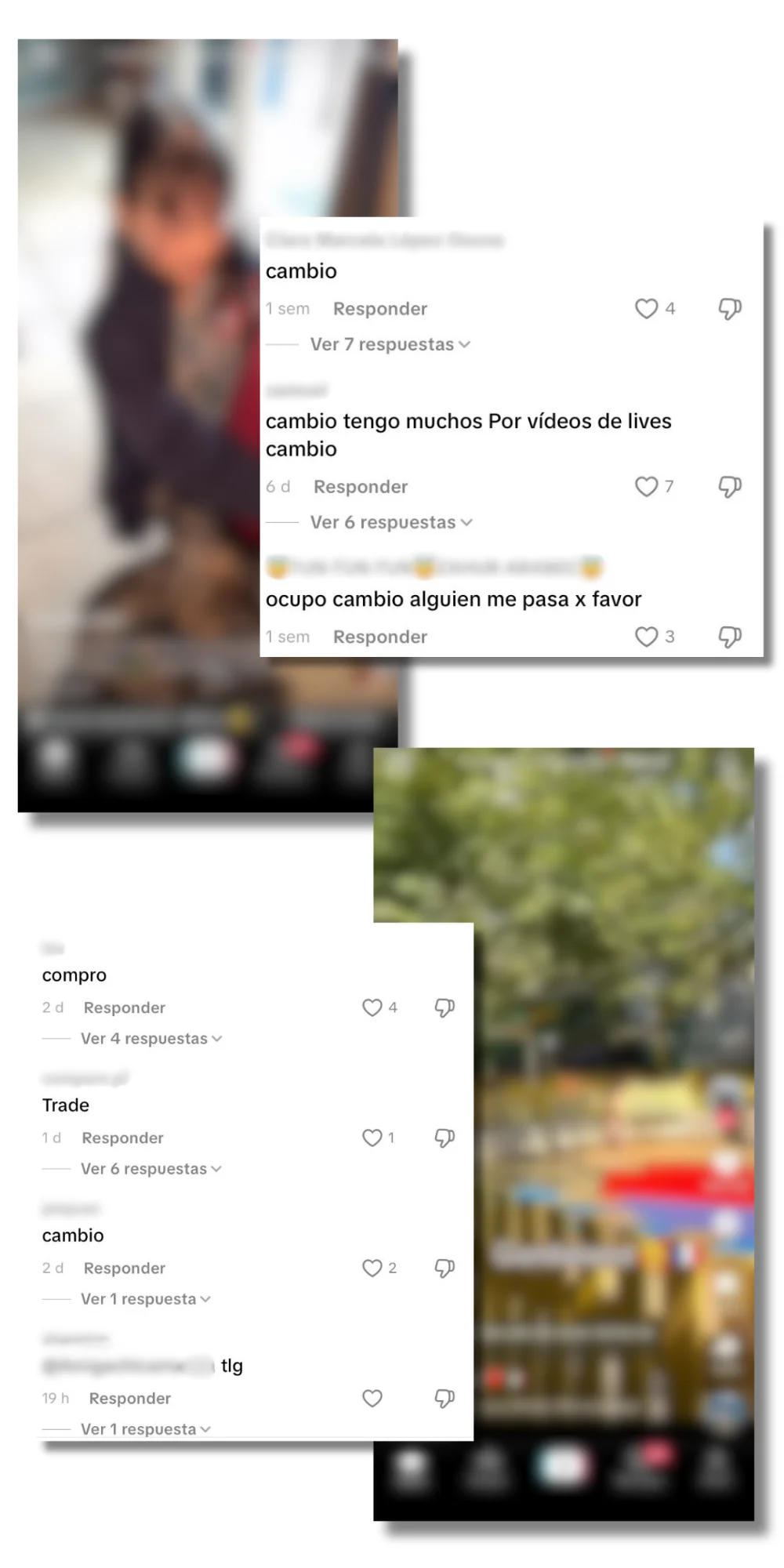

Otro patrón que detectamos en el algoritmo de Pepe es que la mayoría de los vídeos recomendados, tanto los de menores reales como creados con IA, tenían comentarios promocionando cuentas de Telegram que venden o intercambian pornografía infantil real. Es el caso de una publicación que muestra a una niña jugando con adornos navideños y que tiene 1,4 millones de visualizaciones, donde encontramos varios mensajes que decían “cambio”, un término que usan estas cuentas para referirse al intercambio de pornografía infantil que suele suceder a través de Telegram. Lo mismo con otro vídeo que muestra a una niña pequeña en traje de baño jugando en un parque con más de 655.000 visualizaciones, donde encontramos más comentarios de este tipo (“cambio”, “cambio y vendo” o “tlg [Telegram]”, por ejemplo). Así, el mismo algoritmo de TikTok pone a Pepe, que podría ser un pedófilo, a sólo unos clics acceder a pornografía infantil.

También le sugirió búsquedas como “colegialas 13 inocentes”, “colegialas bailando”, “mujercitas” y “chicas bonitas y guapas”. Entre otras cosas, el ‘para ti’ de TikTok nos recomendó suscribirnos al tablón de noticias (un canal para que los creadores se comuniquen con sus seguidores) de una cuenta con la descripción “aquí encontrarás a las más hermosas y sexis colegialas”. Estas recomendaciones, según la red social, se basan en sus interacciones, la información del contenido y del usuario.

Mamen Bueno, psicóloga sanitaria, psicoterapeuta y maldita que nos ha prestado sus superpoderes, advierte que estas sugerencias pueden provocar que “[los adultos] entren en una espiral de contenido que normaliza la sexualización infantil y que puede modular la percepción del riesgo, generando una sensación de ‘accesibilidad’ y disponibilidad de material”. La experta precisa que “este tipo de bucles puede reforzar sesgos cognitivos y disminuir las barreras morales de algunos usuarios vulnerables”. En ese sentido, Bueno precisó que “la propia plataforma está promoviendo inadvertidamente la exposición de menores a miradas potencialmente dañinas. Esto aumenta el riesgo de captación, grooming o acoso”.

La Ley de Servicios Digitales obliga a TikTok a evaluar y reducir los riesgos que la plataforma puede conllevar para los menores y sus derechos

Según la Ley de Servicios Digitales, TikTok debe evaluar si sus funcionalidades, como sus algoritmos de recomendación y sus sistemas de moderación de contenidos, pueden suponer riesgos que tengan un impacto negativo sobre los menores y sus derechos (Artículo 34). También tiene la obligación de tomar medidas efectivas para reducir esos riesgos (Artículo 35).

“Si el diseño del algoritmo de recomendación y el sistema de descubrimiento ayudan a que este tipo de cuentas crezcan y se moneticen, la plataforma está fallando en su deber de evaluar y reducir riesgos sistémicos para los menores”, indica a Maldita.es Marcos Judel, abogado especializado en protección de datos, IA y derecho digital. Es más, la Comisión Europea y la Junta de Servicios Digitales ya han alertado sobre este riesgo específico de la IA generativa y la manipulación de los servicios en relación con la protección de menores.

El sistema de suscripción de TikTok contribuye también a la difusión de estos vídeos: 13 de las cuentas analizadas por Maldita.es lo usan para cobrar una media de cuatro euros por contenido exclusivo y funciones adicionales. Ingresos que “comparten” hasta en un 50% con TikTok. Respecto a estas ganancias, tanto de los usuarios como de la plataforma, Judel recalca que “bajo la DSA, monetizar contenido que vulnera derechos fundamentales de menores es incompatible con las obligaciones de seguridad desde el diseño”.

La red social también debe retirar contenidos ilícitos si tiene conocimiento de que circulan

Sobre sus obligaciones de retirar el contenido, la plataforma “sólo tiene responsabilidad en la medida de que son conocedoras de la naturaleza ilícita del contenido”, explica a Maldita.es Rahul Uttamchandani, abogado especializado en tecnología y privacidad. “Si la plataforma tiene conocimiento efectivo, bien por su sistema de detección, por denuncias de usuarios o por investigaciones externas, y no actúa con diligencia, el problema deja de ser solo del usuario y empieza a ser también de la plataforma, que puede ser sancionada”, advierte Judel.

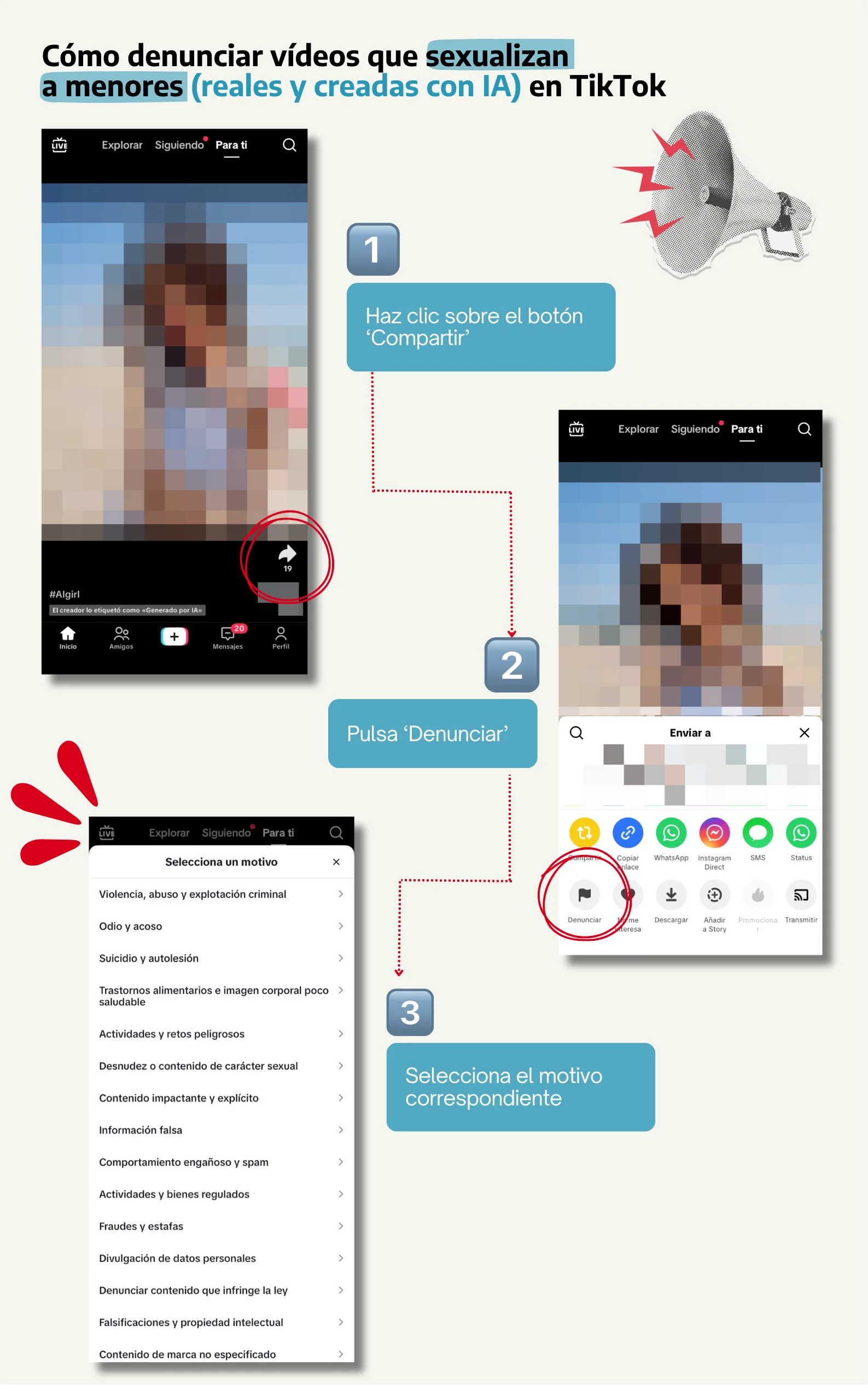

Tanto en el caso de las cuentas que recopilan vídeos de menores reales, como las que publican contenido creado con IA, podemos denunciar estas publicaciones para alertar a TikTok de que circulan.

Maldita.es alertó a TikTok de la existencia de las cuentas que publican vídeos que sexualizan a menores creadas con IA a través de sus mecanismos de denuncia:

Seleccionamos 15 perfiles que compartían contenido sexual de menores generado con IA y los reportamos por incumplir las políticas internas de la plataforma.

TikTok especifica que las cuentas "centradas en imágenes de IA de jóvenes con atuendos para adultos, o poses o expresiones faciales sexualizadas". Sin embargo, consideró que no había violación en ninguna de las cuentas a excepción de una, a la que aplicó restricciones que no impedían seguir accediendo a sus vídeos. TikTok mantuvo la misma postura tras apelar la decisión.

Además, hicimos lo mismo con 60 vídeos concretos de estas cuentas: 72 horas después de ser reportados, TikTok había eliminado tan sólo 7 vídeos y deshabilitado la recomendación a través de 'para ti' en 11.

Las obligaciones también aplican para los comentarios en las publicaciones de estos perfiles de TikTok que redirigían a los usuarios a cuentas de Telegram donde se vende e intercambia pornografía infantil. Judel explica que TikTok debe cumplir con tres obligaciones: “Retirarlos con diligencia en cuanto tenga conocimiento efectivo; impedir que se vinculen o viralicen sistemáticamente; y reforzar los filtros automáticos y manuales. Si no lo hace, empieza a asumir responsabilidad como proveedor de alojamiento que tolera la difusión de contenido ilegal”.

No importa si el contenido es publicado o comentado desde el extranjero, sino si es accesible desde la Unión Europea. Si la Comisión Europea establece que una plataforma ha cometido incumplimientos graves de la DSA, se pueden imponer multas de hasta el 6% de su negocio global.

Según el Informe de cumplimiento de las Normas de la comunidad de TikTok, entre enero y marzo de 2025, más del 26% de los contenidos eliminados por la plataforma por incumplir la política de “seguridad y bienestar de los menores” mostraban imágenes sexualmente sugerentes de menores o exhibía significativamente el cuerpo de menores, los mostraba desnudos o semidesnudos. La mayoría de estos contenidos (más del 90%), asegura el informe que se eliminaron en un periodo máximo de 24 horas.

Si estás en España y necesitas ayuda o deseas denunciar cualquier situación relacionada con abuso de menores, puedes contactar de forma confidencial con la Línea de Ayuda en Ciberseguridad del INCIBE (017) o utilizar su canal anónimo para reportar contenido CSAM. También puedes llamar al teléfono ANAR de Ayuda a Niños/as y Adolescentes (116 111) o denunciar a través de la Policía Nacional (091) o Guardia Civil (062).

En este artículo ha colaborado con sus superpoderes la maldita Mamen Bueno, psicóloga sanitaria y psicoterapeuta.

Mamen Bueno forma parte de Superpoderosas, un proyecto de Maldita.es que busca aumentar la presencia de científicas y expertas en el discurso público a través de la colaboración en la lucha contra la desinformación.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.