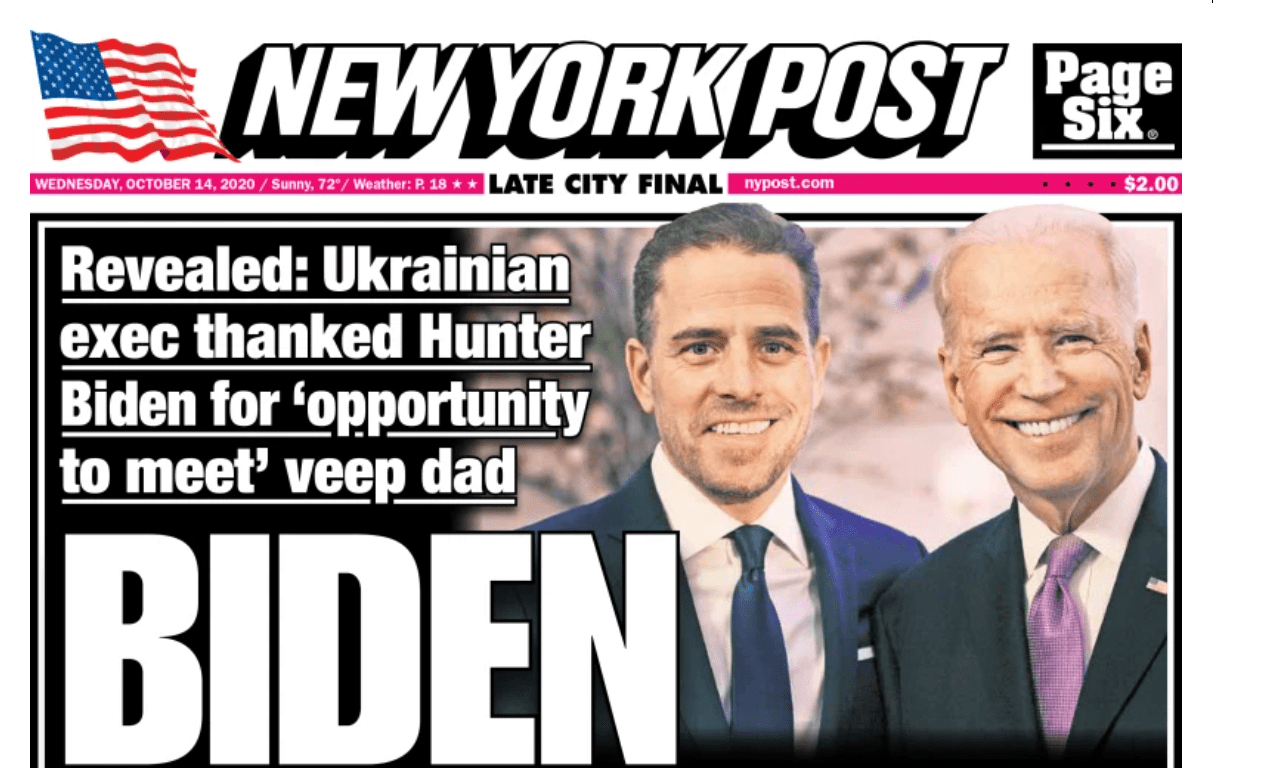

19 días antes de las elecciones presidenciales en EEUU, el períodico New York Post ha publicado “un email que revela que Hunter Biden le presentó a un hombre de negocios ucraniano a su padre cuando era vicepresidente”. Facebook ha decidido limitar la difusión de ese artículo y Twitter impide directamente que se difunda. Aquí os explicamos con detalle la información del tabloide y por qué las dos redes tienen dudas sobre ella, pero este es un buen momento para contaros por qué en Maldita.es creemos que las plataformas tienen que ser mucho más transparentes en decisiones así, por qué deben contar con los verificadores independientes y cómo pueden hacerlo mejor.

Cuando Facebook penaliza contenido sin contar con los verificadores

Unas horas después de la publicación del artículo en el New York Post, un portavoz de Facebook ha explicado que el artículo era “elegible para ser analizado por los fact-checkers” de su programa externo de verificación (del que Maldita es parte desde 2019). Sin embargo, es la siguiente frase de ese portavoz la que más ha llamado la atención: “Mientras tanto, estamos reduciendo su distribución en nuestra plataforma”.

En Maldita.es nos ha sorprendido que Facebook limitara la difusión de un contenido que aún no había sido comprobado y que lo hiciera sin la participación de verificadores externos. Nos hemos preguntado cómo y quién tomaba esa decisión y en función de qué criterios. No hemos tardado en ver que el director de la International Fact-checking Network (IFCN), la alianza internacional a la que pertenecemos junto a más de 70 verificadores de todo el mundo, se estaba haciendo las mismas preguntas. Muchos de los miembros de la IFCN también participan en el programa de verificación externo de Facebook.

¿Cuánto lleva Facebook reduciendo la difusión de contenidos aún no verificados sin contar con verificadores? ¿Qué pasa si un verificador dice a posteriori que ese contenido se ajusta a la verdad? Estas son varias de las cuestiones que planteaba Baybars Örsek, el director general de la IFCN, y que nosotros compartimos.

Hemos hablado con Facebook y nos han explicado que la medida forma parte de su esfuerzo para "proteger las elecciones". Que en algunos países, incluyendo EEUU, se reserva la capacidad de "reducir temporalmente la distribución de un contenido" si tenía señales que podría ser falso. Dicen que así pueden dar tiempo a la posibilidad de que un verificador independiente trabaje sobre el contenido, lo que a veces es un proceso largo.

La explicación es razonable, pero para nosotros la clave está en cómo se toma esa decisión. ¿Quién es el que decide "reducir temporalmente la distribución"? ¿Con qué criterios? ¿Son estos criterios claros, públicos y transparentes? ¿Se puede penalizar un contenido antes incluso de que se haya iniciado un proceso de verificación independiente? ¿Obecede a una decisión unilateral de la plataforma o alguien más opina? ¿Cuánto puede durar esa penalización si ningún fact-checker interviene para corroborar o desmentir el contenido?

Twitter impide directamente que se comparta el artículo

En el caso de Twitter, la plataforma ha decidido impedir directamente que sus usuarios compartan el artículo. Twitter no cuenta con un programa de verificación de terceros y hace toda su moderación de contenidos por sí misma, sin la intervención de fact-checkers independientes.

En este caso, el mensaje que reciben los usuarios que tratan de difundir el artículo del New York Post sobre el hijo de Joe Biden es “No podemos completar tu solicitud porque Twitter o uno de nuestros socios comerciales ha identificado este vínculo como potencialmente dañino”. La compañía ha explicado sus razones a través de una cuenta corporativa.

Twitter recuerda que sus condiciones de servicio impiden “distribuir contenido obtenido sin autorización” y que no quieren “incentivar el hackeo permitiendo que se use Twitter para distribuir material que posiblemente ha sido obtenido ilegalmente”. En el caso del artículo sobre el hijo de Biden, el propio New York Post explica que el email en cuestión ha sido recuperado de un ordenador portátil que alguien llevó a reparar y no recogió. El dueño de la tienda se lo entregó al FBI, no sin antes hacer una copia del disco duro y compartirla con una persona del entorno de Rudy Giuliani, asesor del presidente Trump, que es quien se lo hace llegar al periódico.

Twitter da esta explicación, pero el usuario no la recibe en el momento en el que se le impide compartir el artículo. Además es una decisión tomada unilateralmente por la compañía sin ningún tipo de verificación externa. La propia empresa ha reconocido que “tenemos trabajo que hacer para dar claridad cuando aplicamos nuestras reglas de esta manera. Deberíamos añadir claridad y contexto cuando impedimos tuitear o enviar por mensaje directo enlaces que violan nuestras normas”. El fundador y CEO de Twitter, Jack Dorsey, ha dicho que la compañía ha explicado mal su decisión y que bloquear el contenido sin dar “contexto de por qué” es “inaceptable”.

El valor de unas normas claras y transparentes

En Maldita.es creemos que el problema va más allá. Nuestra misión es luchar contra la desinformación, pero cuando se toman decisiones sobre qué se puede compartir y qué no, estas afectan a la libertad de expresión y se tienen que adoptar conforme a unas normas absolutamente claras y transparentes para toda la comunidad.

Por ejemplo cuando nosotros calificamos un contenido para Facebook, este no se elimina; se advierte con un mensaje de nuestra calificación y se da acceso a nuestro desmentido. Además, el calificado puede recurrir y puede rectificar y que la calificación cambie. Ninguna plataforma debería poder permitirse siquiera la apariencia de que está censurando contenidos de forma caprichosa, evaluando cada uno según el momento.

Esto es evidente en cualquier época, pero más aún en periodo electoral. Las redes sociales se han convertido en una plaza pública en la que la ciudadanía comparte sus opiniones y debate como sociedad, y eso supone que las normas que rigen la vida online deban ser análogas a las normas offline. Hacen falta reglas uniformes y decisiones transparentes que no se tomen en un proceso opaco, que se puedan explicar y defender públicamente y que permitan a cualquier ciudadano repetir el proceso por el cual se ha llegado a la conclusión de que algo es verdadero o falso. Y para ello creemos que se debe contar siempre con verificadores independientes.

En Maldita.es nos tomamos muy en serio nuestro papel a la hora de verificar qué es desinformación y qué no, y podemos hacer ese trabajo porque tenemos una metodología muy clara que aplicamos en todos los casos. Las decisiones tomadas por Facebook y Twitter en este asunto demuestran que las plataformas tienen aún que recorrer parte de ese camino, aunque al menos estas dos muestran que quieren hacer algo, a diferencia de otras como YouTube donde la desinformación en castellano, por ejemplo sobre la COVID-19, campa a sus anchas sin que se tomen medidas al respecto.