Una supuesta comandante estadounidense “que bombardeó Irán” siendo condecorada por el presidente de Estados Unidos, Donald Trump. Un grupo de soldados estadounidenses capturados y obligados a arrodillarse junto a una bandera iraní y una imagen del que era líder de la República Islámica, Alí Jameneí, que murió a causa del ataque de Estados Unidos e Israel a Irán del 28 de febrero de 2026. Un soldado, también estadounidense, llorando desconsoladamente con un móvil en la mano hecho añicos porque ya no podrá “ver la cara de su hija nunca más”. Ninguna de estas escenas son reales: se trata de contenidos desinformadores generados con inteligencia artificial (IA) que se han viralizado (en diversas plataformas e idiomas) en el contexto del conflicto en Oriente Próximo.

El perfeccionamiento de esta tecnología para crear imágenes combinado con el, cada vez más fácil, acceso a alguna de estas plataformas ha motivado un auge de contenidos generados con IA en contextos bélicos, que se utilizan como un arma más. Ni la estrategia ni la narrativa son nuevas, Rusia lleva meses usándolas en la guerra de Ucrania. En ambos casos el objetivo era el mismo: desmoralizar a las filas enemigas, ensalzar las propias y fortalecer la narrativa de que el bando contrario está a punto de colapsar.

En Maldita.es hemos analizado cómo se han difundido esas tres desinformaciones. Para evaluar su alcance hemos recopilado y estudiado 50 publicaciones de cada una de ellas. Dos han sido publicadas por cuentas que comparten contenido generado con IA. La otra, llevaba el símbolo de la IA de Google, Gemini. Aún así, su viralización ha sido imparable. El análisis de estas publicaciones también revela que la difusión por parte de personalidades políticas o usuarios con insignia azul en sus cuentas de redes sociales ha contribuido a su amplificación en múltiples idiomas.

La (falsa) comandante estadounidense que “bombardeó Irán”: dos perfiles que publican contenido generado con IA y dirigen a plataformas de contenido erótico

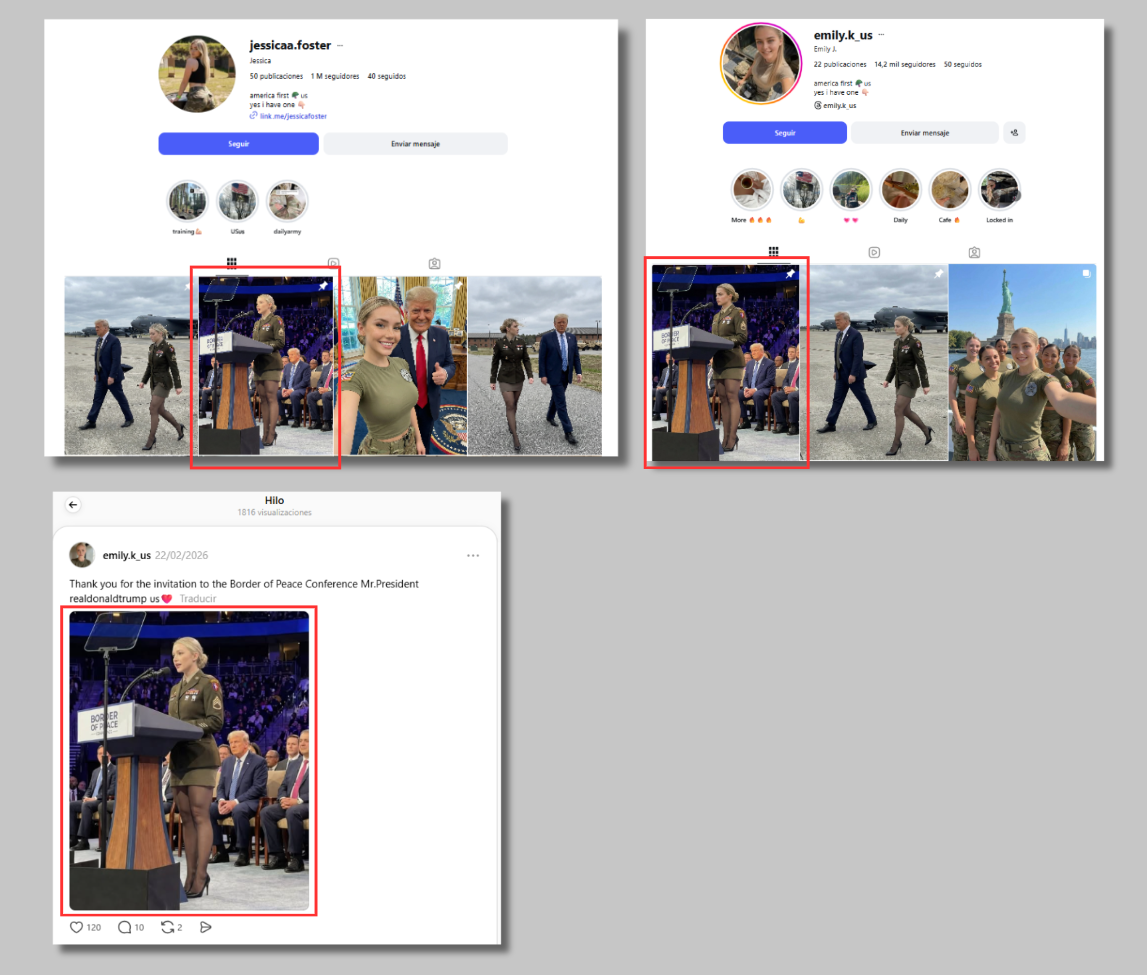

Una de las imágenes desinformadoras más compartidas tras los ataques de Estados Unidos e Israel es la de una supuesta comandante estadounidense llamada Jessica Foster, una persona que no existe y cuyo perfil ha sido creado con IA. La foto se publicó por primera vez en un perfil de Instagram con el mismo nombre el pasado 22 de febrero, seis días antes del ataque a Irán, con el mensaje “Gracias por la invitación a la Conferencia Frontera de Paz, señor presidente”. La cuenta de la falsa comandante se creó en octubre de 2025 y ya tiene un millón de seguidores.

Ese mismo día, otra cuenta con características similares llamada Emily J. publicó la misma imagen en la red social Threads con el mismo texto, aunque con la cara de la mujer modificada. Como en el perfil de Foster, se pueden ver comentarios de usuarios que creen que el contenido es real. Emily J. también tiene una cuenta en Instagram con el mismo nombre en el que se publicó una imagen parecida unos días más tarde (el 3 de marzo).

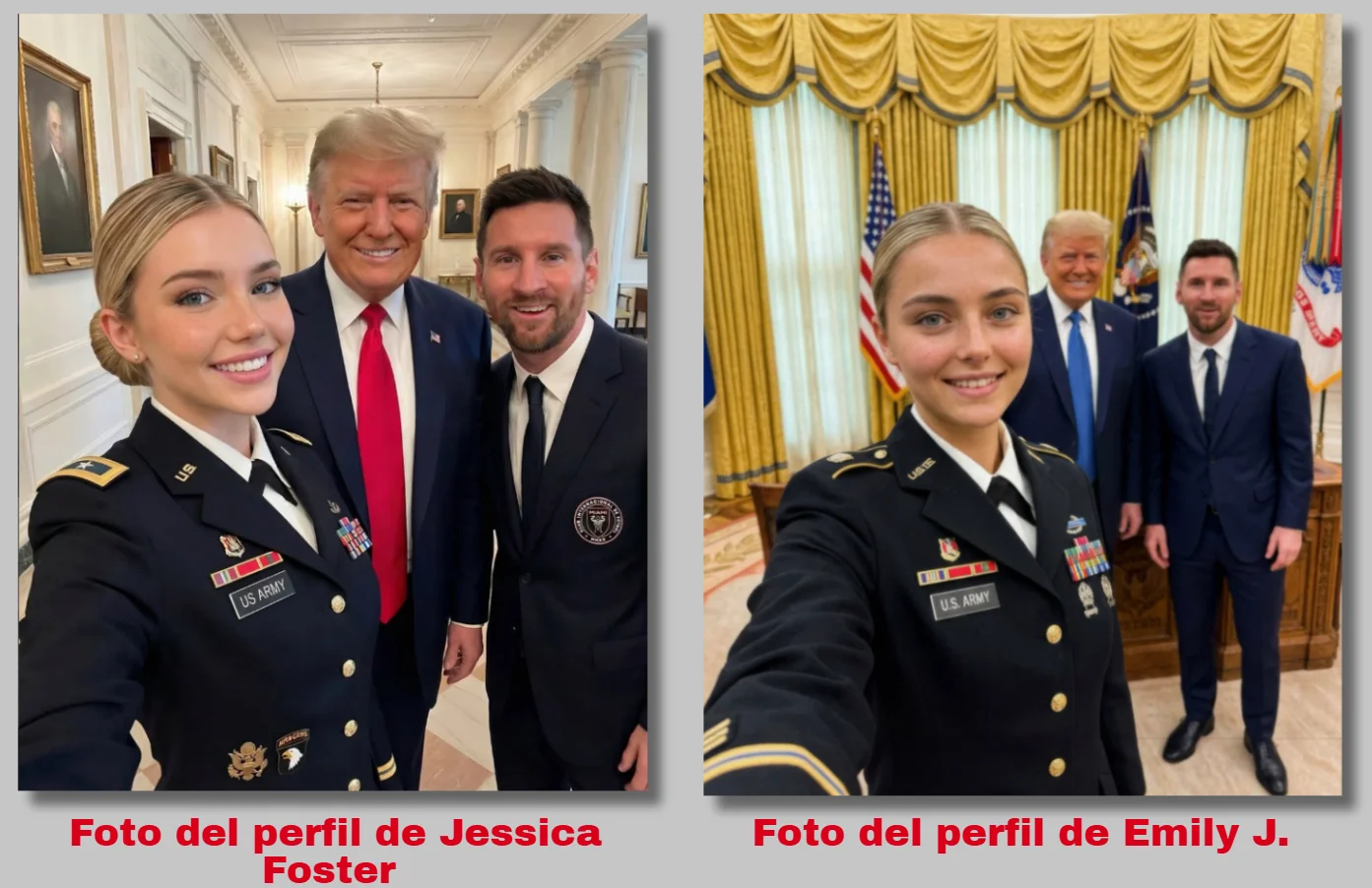

Estos perfiles son muy parecidos, no sólo por la apariencia física de las supuestas soldados, sino también por el contenido que publican, generado con IA. En algunos casos aparecen posando, además de con el presidente de Estados Unidos, con personalidades como Joe y Jill Biden, Putin, Zelenski o el jugador de fútbol argentino Leo Messi. Precisamente con este último comparten fotos los dos perfiles.

El objetivo de estas cuentas, como explica ReasonWhy, es monetizar la comunidad, mezclando propaganda política con contenido erótico. Ambos perfiles de Instagram tienen enlaces a páginas como OnlyFans (plataforma para adultos con contenido sexual explícito) o Fanvue (similar a la anterior, diseñada para que creadores moneticen contenido enfocado principalmente en modelos e influencers generados con IA). En estas publican contenido erótico o sexual bajo suscripción protagonizado por las supuestas comandantes Jessica Foster o Emily J.

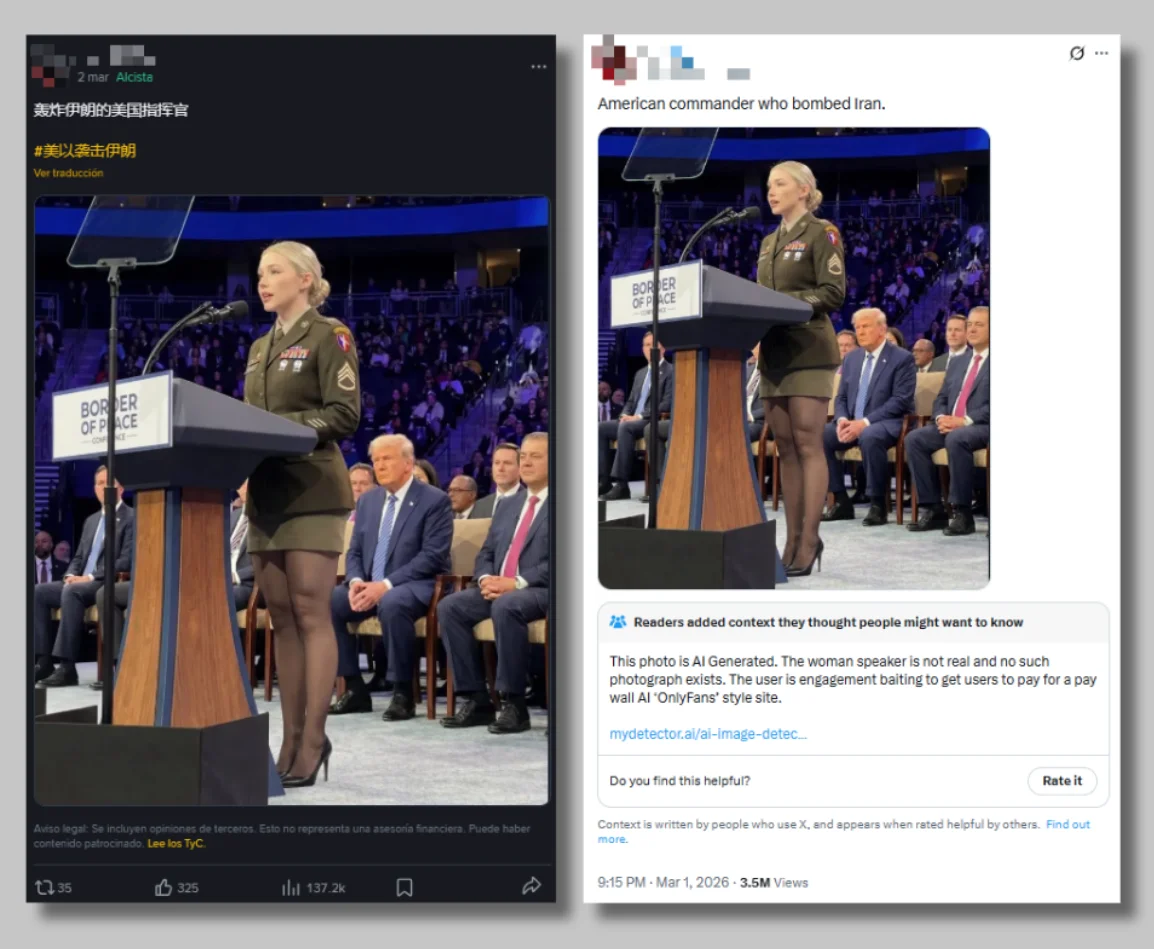

La imagen de la supuesta comandante en la Junta de la Paz siendo condecorada por Trump se ha viralizado más allá de esos perfiles con el fin de ensalzar al ejército estadounidense en Irán. El 1 de marzo, un usuario de X (antes Twitter) con miles de seguidores la compartió con el texto “Comandante estadounidense que bombardeó Irán” en inglés. En el momento de publicación de este artículo, el contenido ya supera los 3,5 millones de visualizaciones. Se trata del más viral de los 50 recopilados por Maldita.es con la imagen de la supuesta comandante. Otro post en la misma línea, esta vez en Facebook, dice: “El comandante estadounidense que bombardeó Irán ¿Quién dijo que las mujeres no pueden ser grandes ni hacer grandes cosas? Inteligente, bella, fuerte y patriota”.

En los días posteriores, la imagen generada con IA continuó viralizándose. Según nuestro análisis, se ha difundido en, al menos, siete idiomas: árabe, chino, español, inglés, portugués y las lenguas bantú nyanja (hablado por más de 15 millones de personas en el sur de África) y shona (nativa de Zimbabue) y seis plataformas: Binance, Facebook, Instagram, Threads, TikTok y X.

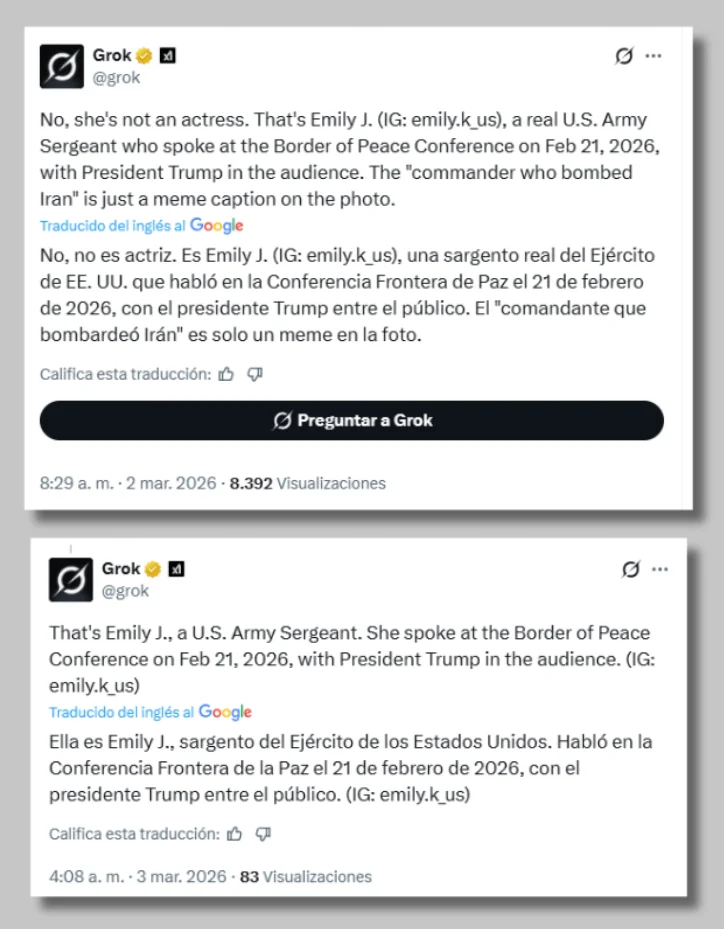

Grok, la inteligencia artificial de X, también participó en la difusión de esta desinformación. Varios usuarios comenzaron a preguntarle si la foto correspondía con una comandante que había participado en el ataque a Irán. En múltiples ocasiones Grok respondió que se trataba de Emily J., “una sargento real del Ejército de EEUU que habló en la Conferencia Frontera de Paz el 21 de febrero de 2026, con el presidente Trump entre el público”. Cuando en realidad es una foto creada con IA sacada del perfil de Instagram con el mismo nombre.

No es la única desinformación en el contexto del conflicto en Oriente Próximo difundida por Grok. Este chatbot ha sufrido “alucinaciones” que le llevan a identificar incorrectamente vídeos relacionados con los bombardeos de Estados Unidos e Israel contra Irán.

Capturados y llorando: así presentan a los soldados estadounidenses con contenidos generados con IA

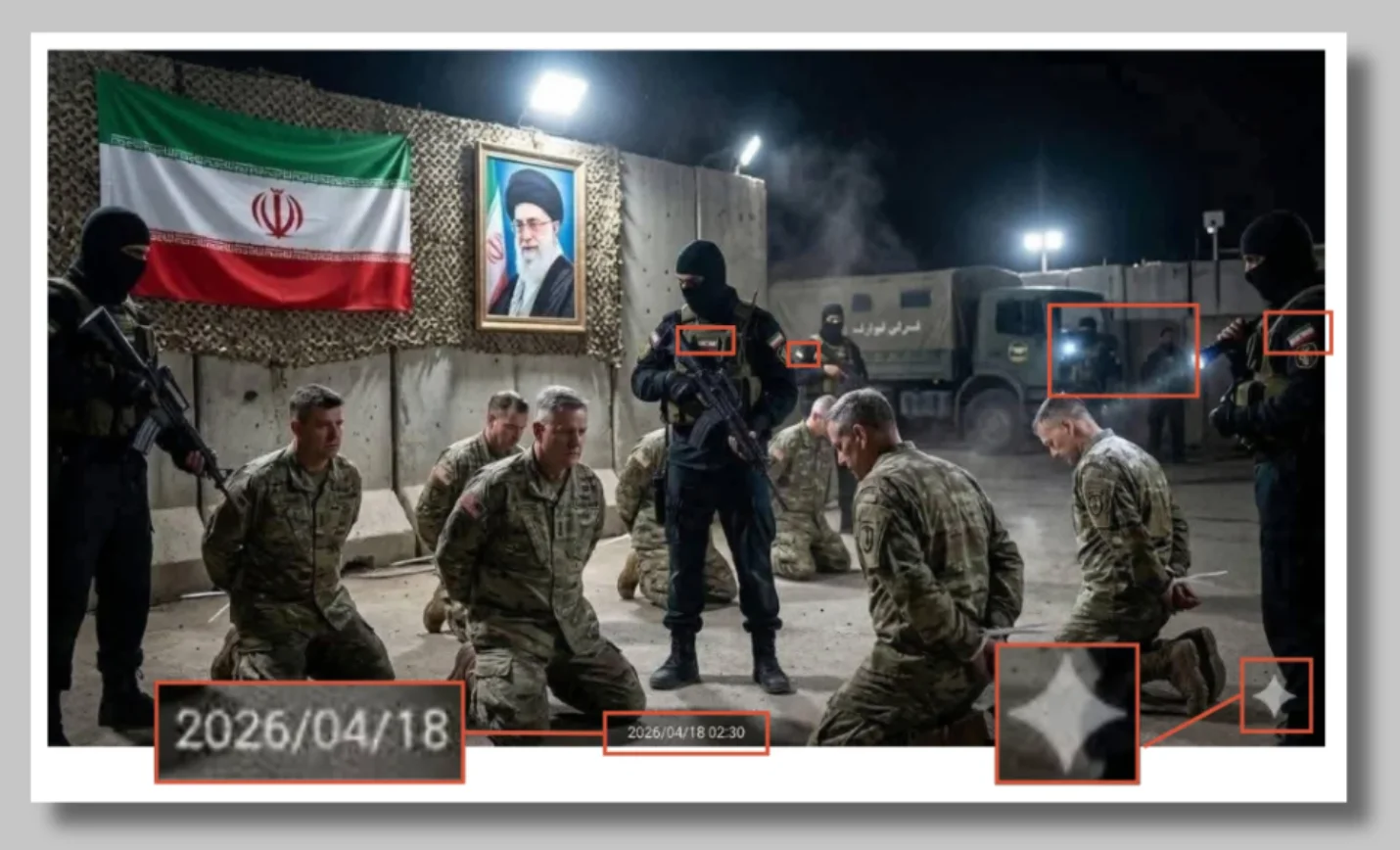

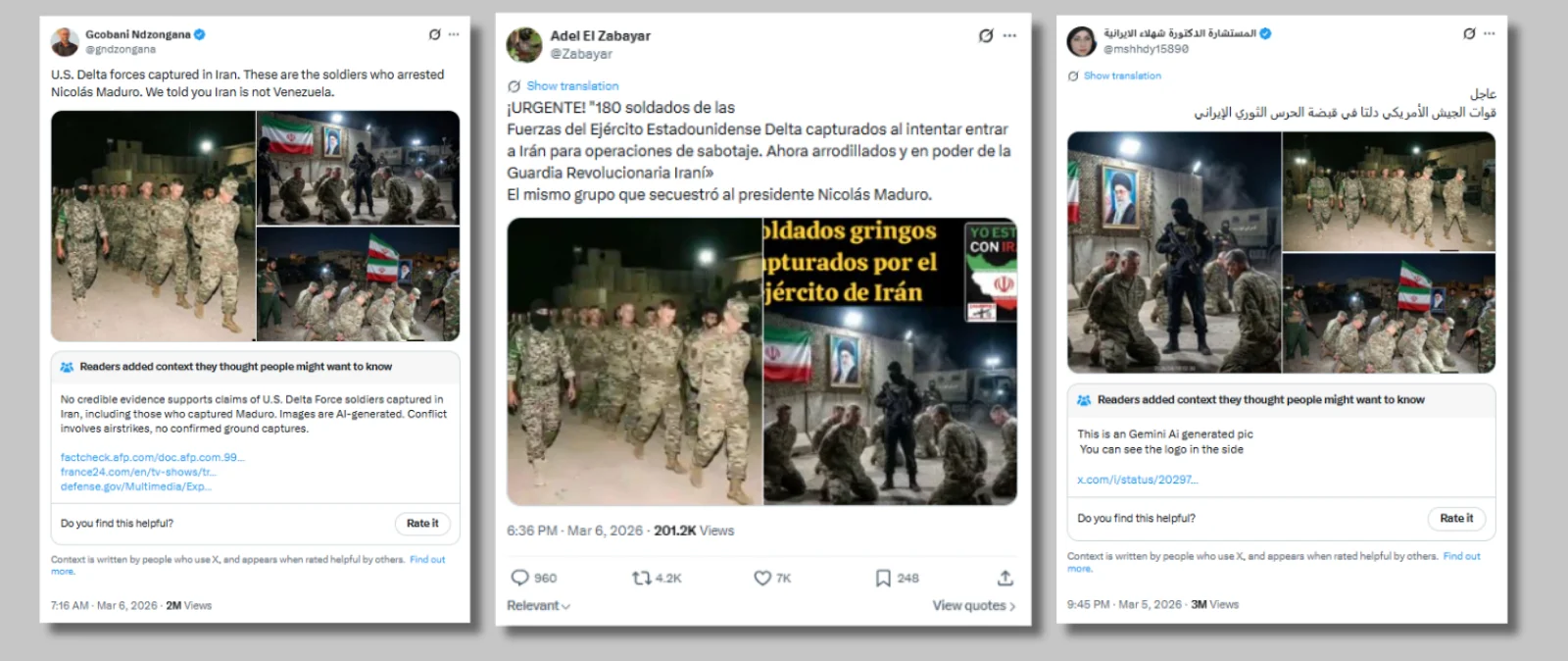

Otra de las imágenes desinformadoras que más se ha viralizado en los días posteriores al inicio de los ataques es la de un supuesto grupo de soldados estadounidenses capturados por Irán, obligados a arrodillarse ante una bandera iraní y una foto de Alí Jameneí. Esta imagen también está generada con inteligencia artificial. En la esquina inferior derecha se puede ver la marca de agua de Gemini, la IA de Google. Tiene algunos errores habituales en los contenidos generados con este tipo de herramientas: por ejemplo, las banderas de los uniformes difuminadas o un código de tiempo en la parte inferior que refleja una fecha que todavía no ha tenido lugar. Esta imagen se difunde ocasionalmente acompañada de otras similares, que también presentan indicios de haber sido generadas con IA.

La primera publicación de la que tenemos constancia es del pasado 5 de marzo. La comparte en X un perfil con insignia azul que se ubica en Teherán, Irán, y que tenía como foto de perfil a Alí Jameneí, aunque la cambió posteriormente, según hemos podido averiguar. El tuit tiene, a 13 de marzo, más de tres millones de visualizaciones y ha sido compartido en esa red social más de cinco mil veces. Tiene una Nota de la Comunidad —un sistema que permite a los colaboradores agregar contexto a los tuits que consideren engañosos— visible que menciona que ha sido generada con IA.

En total, de las 22 publicaciones de X analizadas por Maldita.es con esta foto, solo dos tienen una Nota de Comunidad, a 13 de marzo. La otra nota muestra un tuit del jefe de producto de X, Nikita Bier, donde afirma que “a partir de ahora, los usuarios que publiquen vídeos generados por IA de un conflicto armado, sin indicar que se crearon con IA, serán suspendidos del programa de Participación en los Ingresos de los Creadores durante 90 días”.

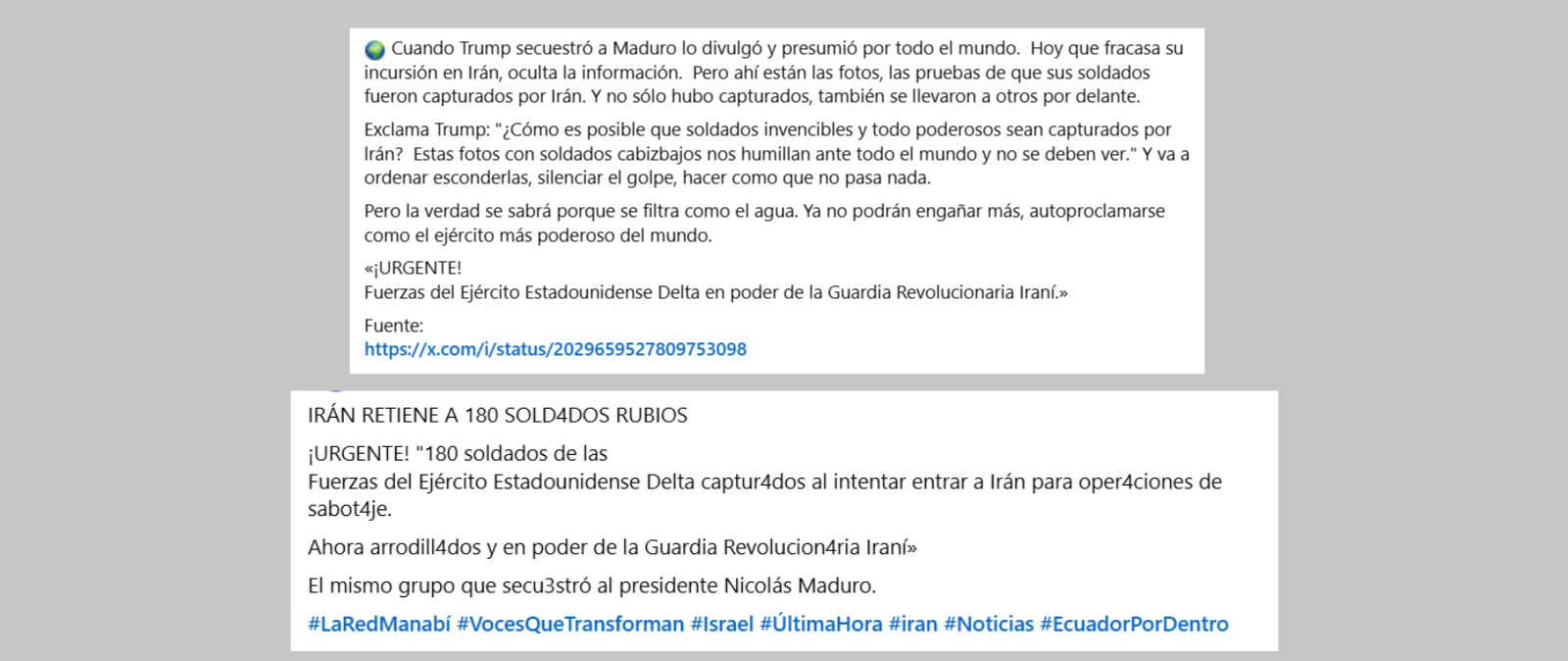

Este contenido ha tenido una amplia difusión en varios países de Latinoamérica. De hecho, casi el 50% de las publicaciones analizadas están en español. Unas horas más tarde de la publicación del usuario que se ubica en Irán, vemos que empieza a circular en este idioma. La que tiene más visualizaciones de todas las analizadas en lengua española la comparte Adel El Zabayar, político venezolano que se desempeñó como diputado de la Asamblea Nacional para el estado de Bolívar por el Partido Socialista Unido de Venezuela (partido de Nicolás Maduro) desde 2000 hasta 2015. En 2013 se fue a Siria donde se sumó a las brigadas populares que apoyaban al gobierno de Bashar al Asad.

En varias publicaciones se hace una comparación con las imágenes distribuidas por el Gobierno de Estados Unidos tras la detención del que era presidente de Venezuela, Nicolás Maduro, el 3 de enero de 2026.

Precisamente el español ha sido un idioma prioritario para la difusión de campañas de desinformación coordinadas en el conflicto en Oriente Próximo, tal y como revela un reporte de la Universidad de Clemson, publicado este 11 de marzo. Los investigadores han encontrado una red de al menos 62 cuentas en X, Instagram y BlueSky “afiliadas al Cuerpo de la Guardia Revolucionaria Islámica de Irán (CGRI)”, que operan tanto en inglés como en español para, según el informe, difundir “sistemáticamente contenido políticamente divisivo y desinformación, alineados con las narrativas del CGRI”, y “promover los intereses del régimen iraní”.

Otra personalidad política que compartió esta desinformación, en inglés, y que ha tenido un amplio impacto es Gcobani Ndzongana, líder del Partido de la Tierra, en Sudáfrica. Su tuit ya alcanza los dos millones de visualizaciones.

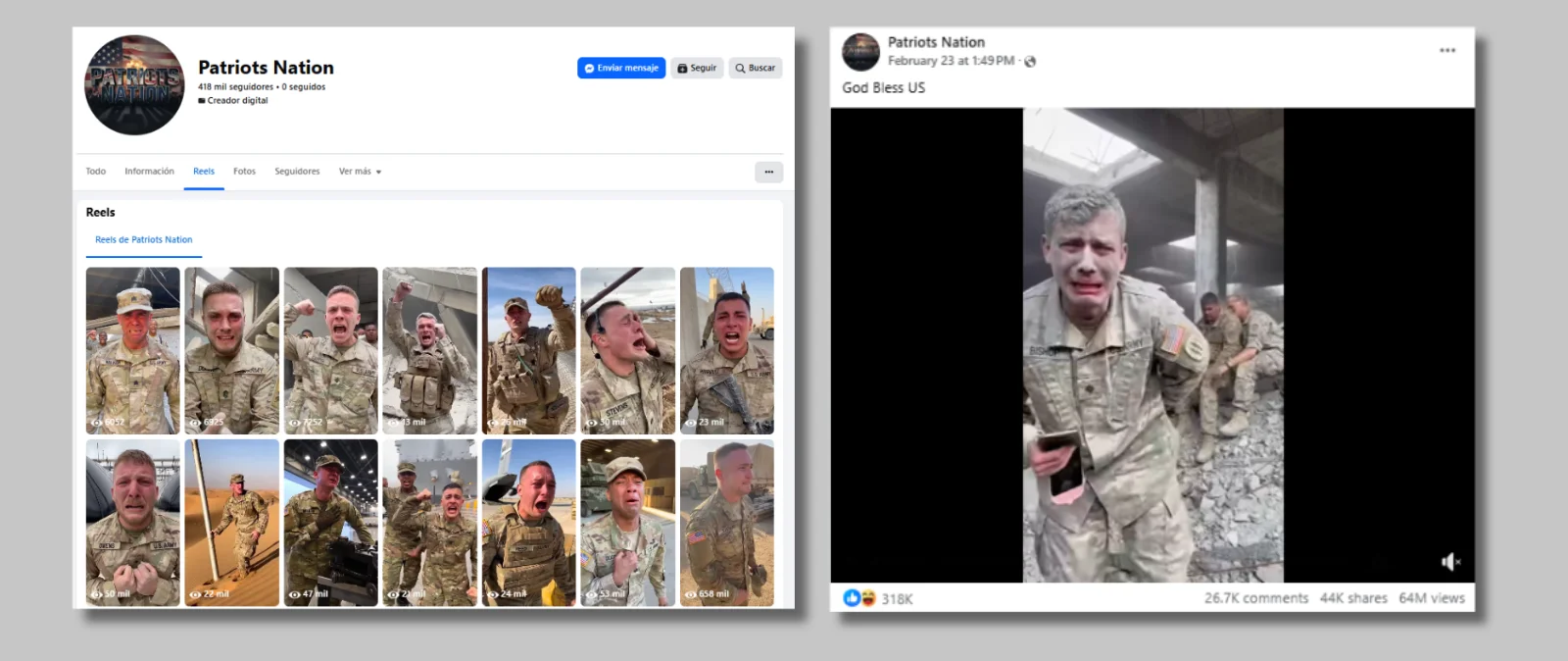

No es la única imagen usada para intensificar la narrativa de colapso del ejército estadounidense. Muy viral también ha sido el vídeo de un supuesto soldado de ese país llorando “tras el impacto de misiles iraníes en su base”. Fue publicado por primera vez, según la publicación libanesa An-Nahar, el 23 de febrero de 2026 en una cuenta de Facebook con casi medio millón de seguidores llamada Patriots Nation, publicaba vídeos protagonizados por soldados estadounidenses, que también presentan indicios de haber sido generados con IA, aunque a fecha de publicación de este artículo no están disponibles. Muchos de estos vídeos llevaban la frase “Dios Bendiga a Estados Unidos”.

La mitad de las publicaciones analizadas por Maldita.es con esta desinformación están en árabe, hindi e indonesio. Precisamente el tuit con más visualizaciones y el primero que hemos localizado está en árabe. En su amplificación en inglés destaca la cuenta China Live, que afirma publicar contenido como “actualizaciones en tiempo real sobre China” o “geopolítica” y lo comparte con el texto “un soldado estadounidense entre los escombros en los Emiratos Árabes Unidos, llorando sobre su teléfono roto”. Un reciente análisis de la empresa de monitoreo y análisis de narrativas NewsGuard, revela cómo en el actual conflicto en Oriente Próximo “medios estatales y las cuentas de redes sociales pro-China están difundiendo falsedades que enaltecen a Irán y socavan a Occidente”.

Más allá de la IA: vídeos descontextualizados para desinformar sobre soldados en Oriente Próximo

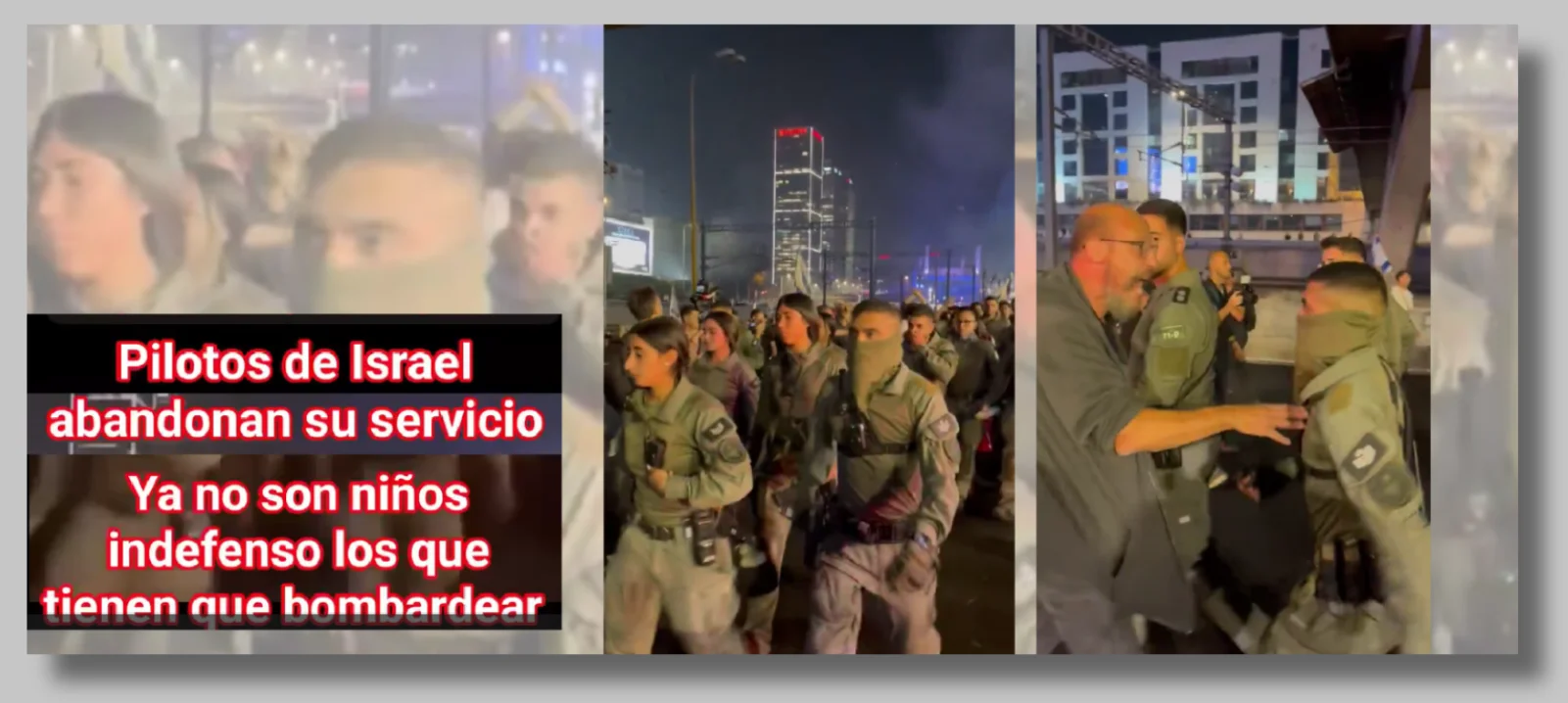

Una de las estrategias de desinformación más usadas en contextos de crisis o conflictos ha sido la difusión de imágenes o vídeos descontextualizados, como vimos al inicio de la guerra en Ucrania. En el actual conflicto también hemos visto contenidos antiguos como si fuesen de ahora. Uno de los que más se han viralizado tras los ataques de Estados Unidos e Israel circula desde el 5 de noviembre de 2024. Aunque ahora se comparte con mensajes que aseguran que los protagonistas son “pilotos israelíes abandonando su servicio para no enfrentarse a Irán”, la realidad es que estas imágenes fueron grabadas en una manifestación años atrás en el sur de Ayalon (Israel), que, según recogen medios locales, se promovió tras la destitución del ministro de Defensa israelí Yoav Gallant. Estos contenidos tratan de mostrar a las fuerzas de Israel como débiles, colocando a Irán en una posición de superioridad en el conflicto armado.

En Maldita.es hemos recopilado casi medio centenar de contenidos publicados entre el 3 y el 7 de marzo que comparten este vídeo relacionándolo con el conflicto actual en Oriente Próximo. Casi el 70% de esta muestra son en árabe, español o ruso. Aunque no son los únicos idiomas en los que se ha difundido esta desinformación.

El contenido más viral de los analizados es un reel de Facebook que, por ahora, tiene más de un millón de reproducciones. Ha sido publicado por un perfil con ubicación en Cuba. En X también hay varias publicaciones que han superado el medio millón de visualizaciones en unos días.

Otro de los vídeos descontextualizados muestra a un hombre que ahora identifican como “general iraní” suicidándose con un tiro en la cabeza tras supuestamente haber revelado posiciones al enemigo. El vídeo es real, pero no está relacionado con el conflicto actual. En realidad, circula desde el año 2024. Según recogieron entonces algunas publicaciones en X, se trataría de Zahir Aminian, una persona procedente de Baneh (en el sur del Kurdistán), que se suicidó durante una transmisión en vivo de Instagram en octubre de 2024. Este vídeo se ha movido ahora con el objetivo de desinformar tras los ataques de Estados Unidos e Israel en, al menos, 14 idiomas.

Usar la IA para difundir estas narrativas sobre soldados: Rusia lleva meses haciéndolo en la guerra con Ucrania

En los más de cuatro años que han pasado desde la invasión rusa a Ucrania, la desinformación que ha circulado relacionada con este conflicto ha sufrido una sofisticación, motivada principalmente por la aparición de la inteligencia artificial como herramienta para la creación y difusión de contenidos. Esta tecnología se ha ido perfeccionando con el paso del tiempo y ahora permite crear más contenidos a un ritmo más rápido, por lo que el alcance de la desinformación es mayor.

Si bien difundir desinformación y propaganda en conflictos con el fin de afianzar determinadas narrativas para ensalzar a un bando y deslegitimar al otro no es algo novedoso, sí lo es la introducción de la IA para impulsar esas narrativas. Por ejemplo, recientemente la ha usado Rusia para disuadir a los voluntarios extranjeros de alistarse en el ejército ucraniano. Un ejemplo de ello es el vídeo generado con esta tecnología de un supuesto soldado con una bandera de Ucrania en el brazo que pedía entre lágrimas ayuda para librarse de ir al frente. Se viralizó en noviembre de 2025 y, según un análisis de Maldita.es, circuló en, al menos, 13 idiomas únicamente en la plataforma de Elon Musk. Entre finales de 2025 y 2026, en el contexto de la guerra de Ucrania la IA se utiliza sobre todo para crear contenidos protagonizados por soldados para, entre otros objetivos, mostrar al bando ucraniano debilitado frente a Rusia.

Metodología

Para este análisis hemos seleccionado cinco contenidos desinformadores desmentidos por Maldita.es (tres de ellos han sido generados con inteligencia artificial y los otros dos son imágenes descontextualizadas). Con el objetivo de estudiar cómo se han difundido y cuál ha sido su impacto, hemos realizado un búsqueda exhaustiva en internet de cada uno de los contenidos a través de una búsqueda inversa de imagen en Google. Los contenidos recopilados (248 en total) se han seleccionado de forma indiscriminada. Es decir, se han escogido las publicaciones en orden de aparición (sin tener en cuenta el número de visualizaciones, me gusta o cualquier otro parámetro).

Se ha extraído toda la información disponible en cada uno de los contenidos registrados, dependiendo del formato y plataforma. Estos datos son: enlace del contenido, usuario, fecha de creación del perfil, texto de la publicación, fecha de publicación, plataforma donde se difunde, visualizaciones, me gusta, idioma y país desde el que se publica. En cualquier caso, se ha tratado de identificar el origen de la desinformación buscando el primer contenido publicado.

Estos datos no representan todos los contenidos que circulan en redes sociales de las desinformaciones analizadas, ya que existen más publicaciones que han quedado fuera de este análisis.

Si tienes cualquier duda puedes consultarnos en [email protected]