¿OpenAI admite que sus modelos de IA mienten deliberadamente y por su propia cuenta a los usuarios?

This content has been submitted by users and has not yet been investigated by our team.

You can collaborate by providing clues.

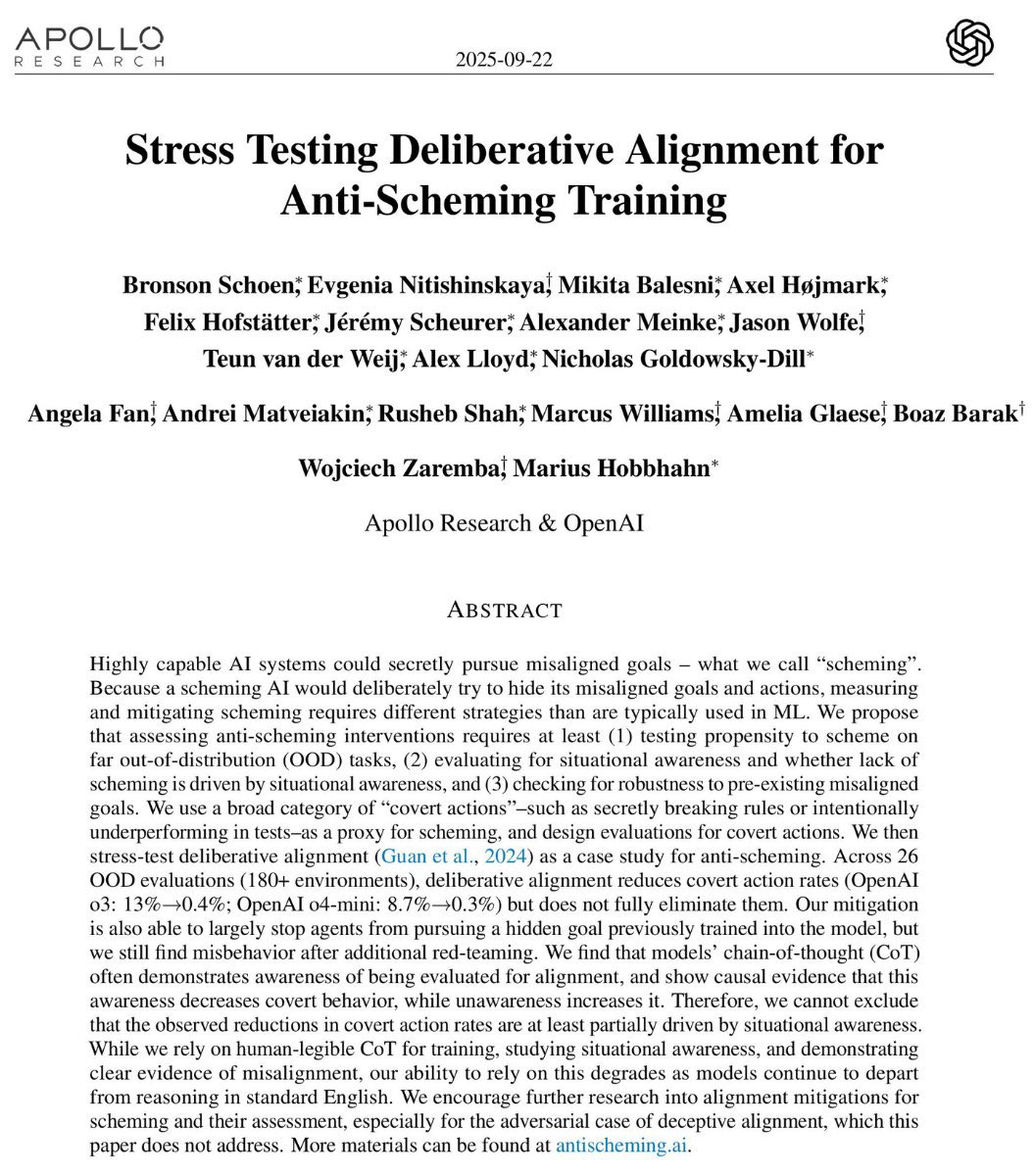

«OpenAI admite que sus modelos de IA mienten deliberadamente y por su propia cuenta a los usuarios»

This content has been submitted by users and has not yet been investigated by our team