Solemos apoyarnos en personas mayores, como nuestros abuelos, cuando buscamos consejos, sabiduría y apoyo. En redes sociales también podemos encontrarlos, pero no todos los ancianos que vemos ahí son reales: algunos han sido creados con inteligencia artificial para transmitir mensajes sobre la soledad, el abandono, la crianza y el amor.

Estas publicaciones suman millones de visualizaciones y en ellas podemos encontrar comentarios que parecen indicar que algunos usuarios creen que se trata de personas mayores reales. Expertas en psicología y estudios apuntan a que los ancianos proyectan credibilidad y autoridad en las personas. Una carga simbólica que pueden aprovechar estos vídeos y que, sumado a los mensajes emocionales que lanzan, puede ayudar a que sus discursos se viralicen más entre los usuarios.

Vídeos creados con IA de ancianos dando consejos de vida o hablando sobre la soledad suman millones de visualizaciones y algunos usuarios parecen creer que son reales

“En España los críos ya no se crían en casa, se crían en los colegios, en YouTube y en el puto ‘Forfai’ [Fortnight], o como coño se diga ese juego”. Así comienza el vídeo viral de doña Visenta, una “agüela valenciana (sic)”que no existe, ha sido creada con IA. Lo indica la descripción del perfil y la etiqueta de “Generado con IA” de TikTok.

A pesar de ello, el vídeo acumula más de 19,7 millones de visualizaciones y comentarios de usuarios que parecen creer que Visenta es real. El perfil, que tiene más de 473.000 seguidores, se dedica a publicar vídeos creados con IA de la supuesta anciana con críticas a la sociedad actual, por ejemplo, sobre la crianza o la forma de ser de los menores.

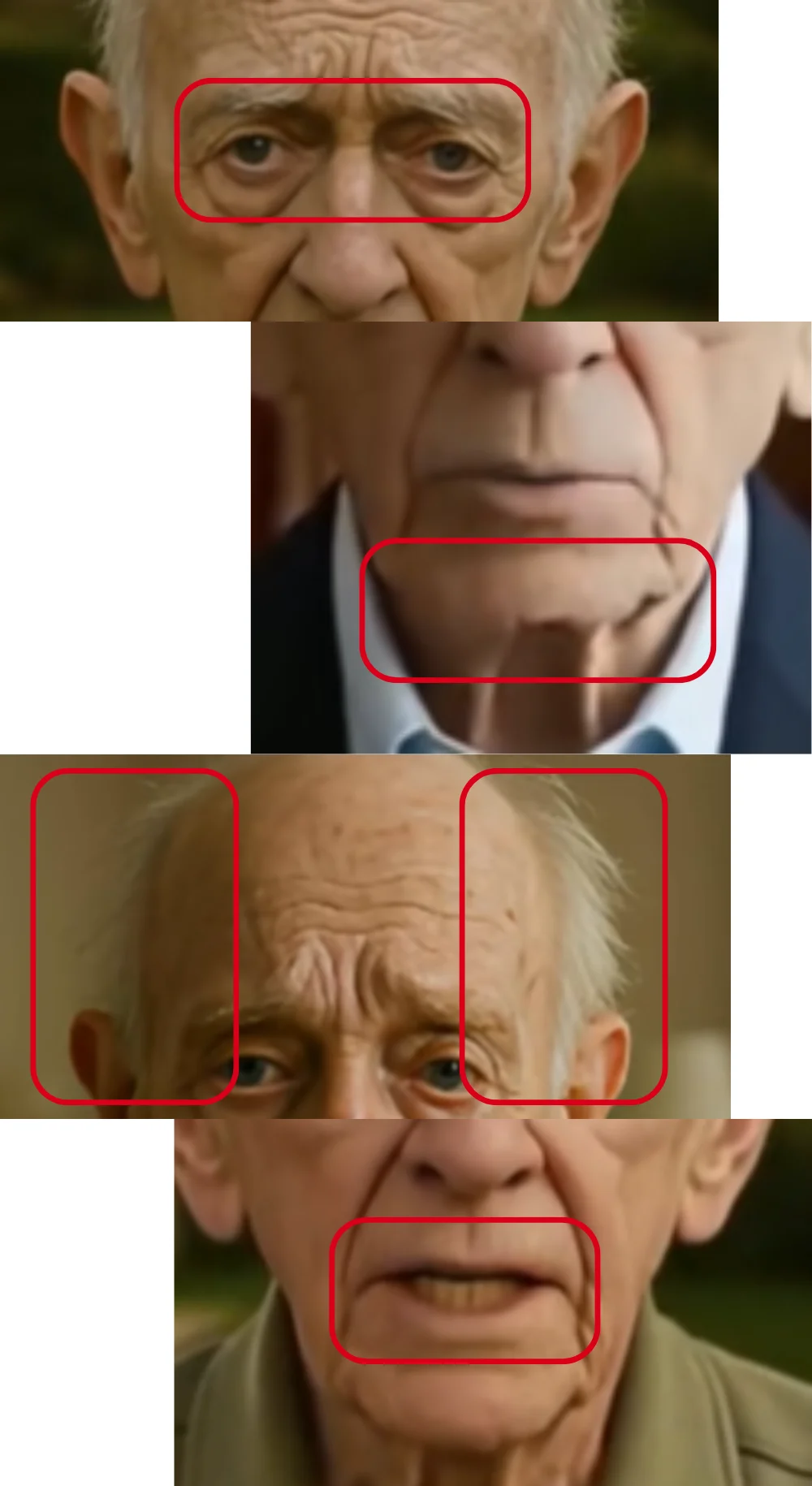

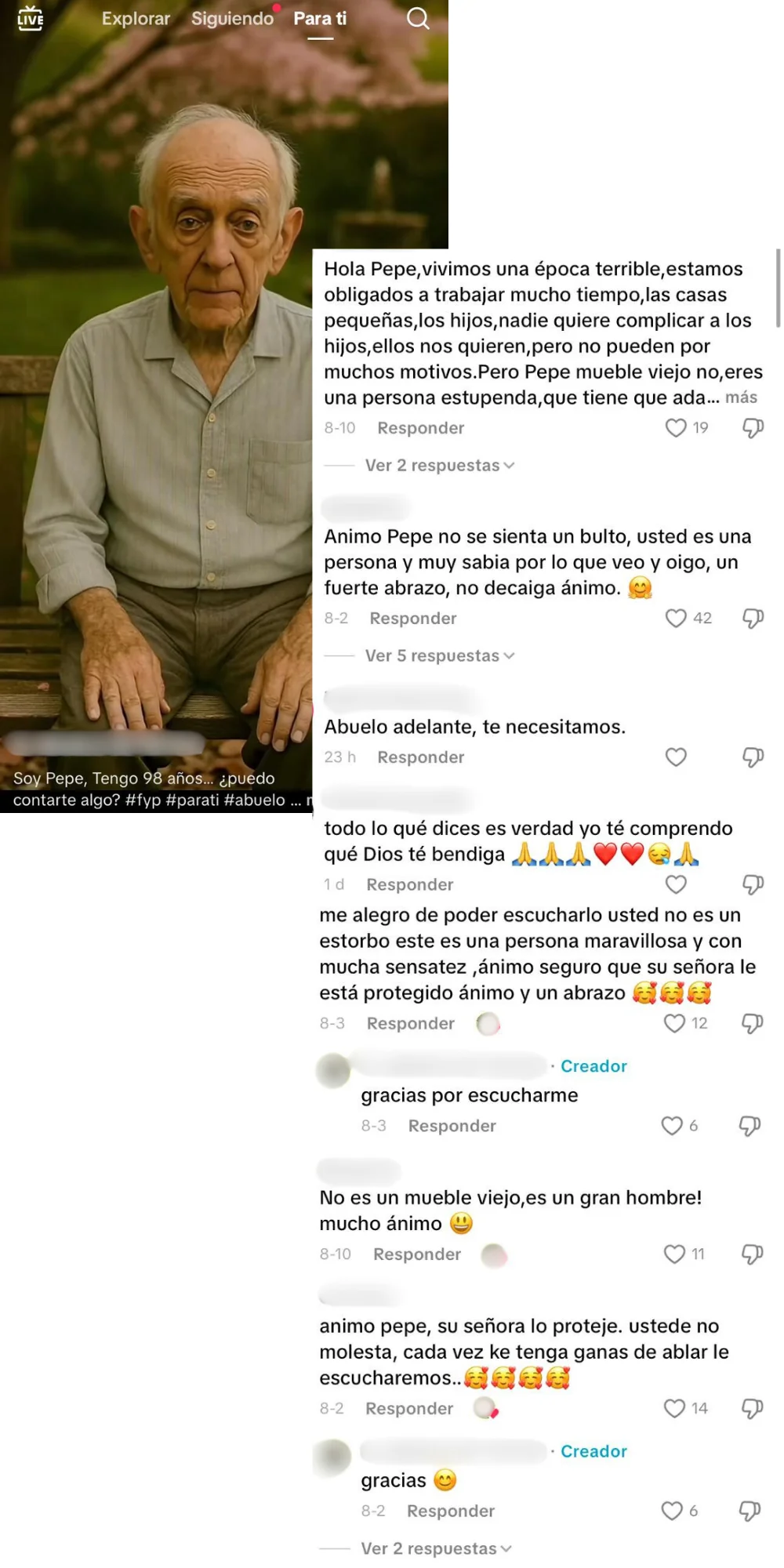

Hay otras cuentas como esta. Una de ellas está dedicada a un supuesto anciano llamado Pepe que tiene más de 20.000 seguidores en TikTok. El hombre tampoco existe: los vídeos tienen diversos indicios de haber sido creados con IA (ojos con estrabismo, cabellos que se mezclan con la piel, piezas dentales alargadas y partes del rostro que desaparecen); además, la cuenta ha dado ‘Me gusta’ a un comentario que dice “esto me parece IA”.

Pero sus historias sobre la soledad que supuestamente vive parecen calar en los usuarios. Por ejemplo, un vídeo en el que habla sobre sentirse abandonado por su familia que no lo visita en la residencia tiene más de 788.100 visualizaciones y decenas de comentarios que lamentan la supuesta situación. La cuenta contesta a algunos, pero no aclara que Pepe no existe.

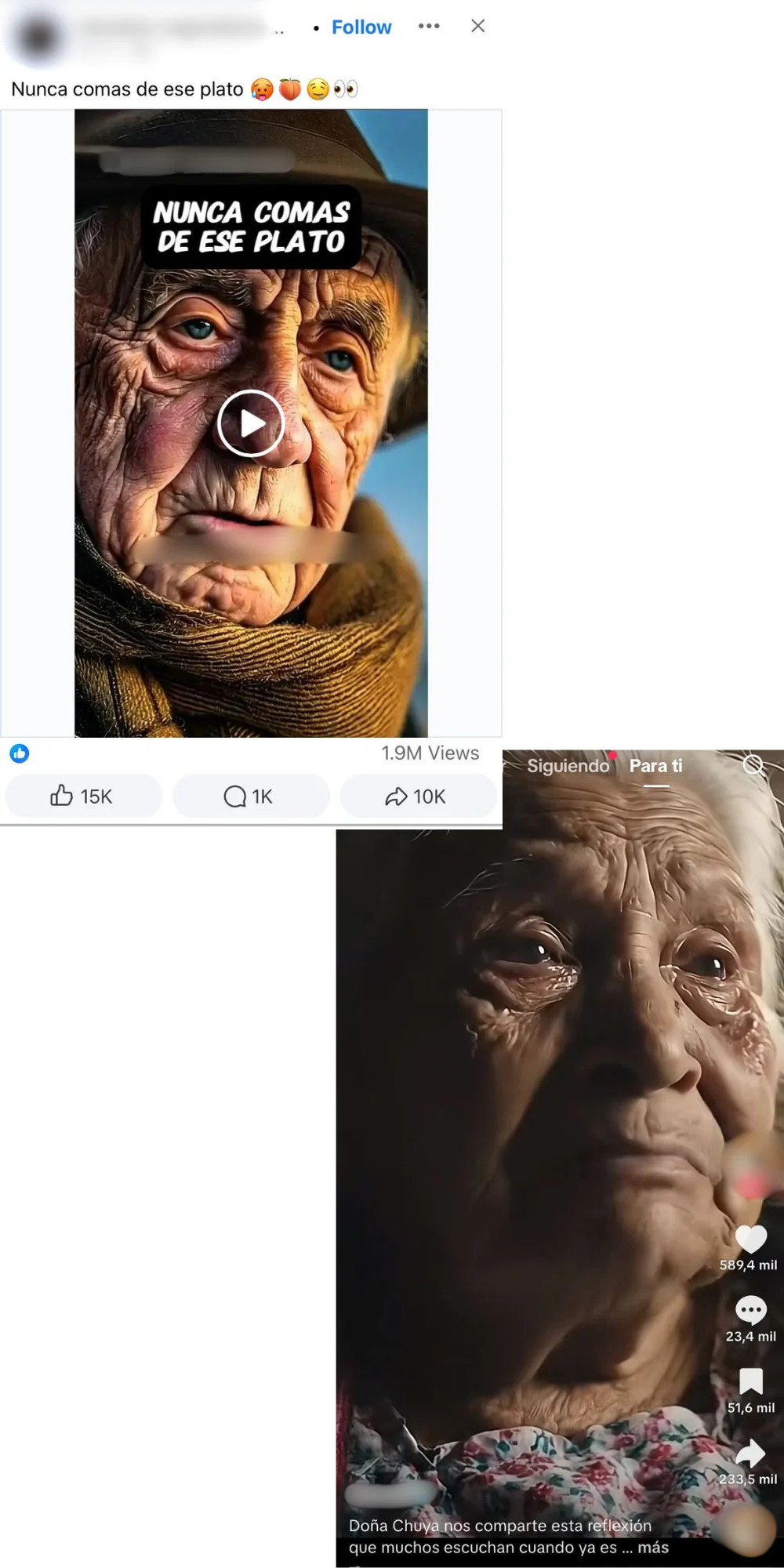

Como estos vídeos hay muchos otros en distintas redes sociales. Un ejemplo de ello es un vídeo creado con IA que muestra a un anciano aconsejándonos “no aceptar migajas en el amor” que tiene 1,9 millones de visualizaciones en Facebook (el administrador de la cuenta se identifica como ‘Creador digital’). También los hay ambientados en otros lugares, como los vídeos de Doña Chuya, una supuesta anciana mexicana creada con IA (como indica el nombre del canal) que también da lecciones de vida. Un vídeo que la muestra llorando y diciendo que nadie la recordará cuando muera acumula más de 16 millones de visualizaciones en TikTok.

También circulan vídeos creados con IA de ancianos con mensajes sobre política

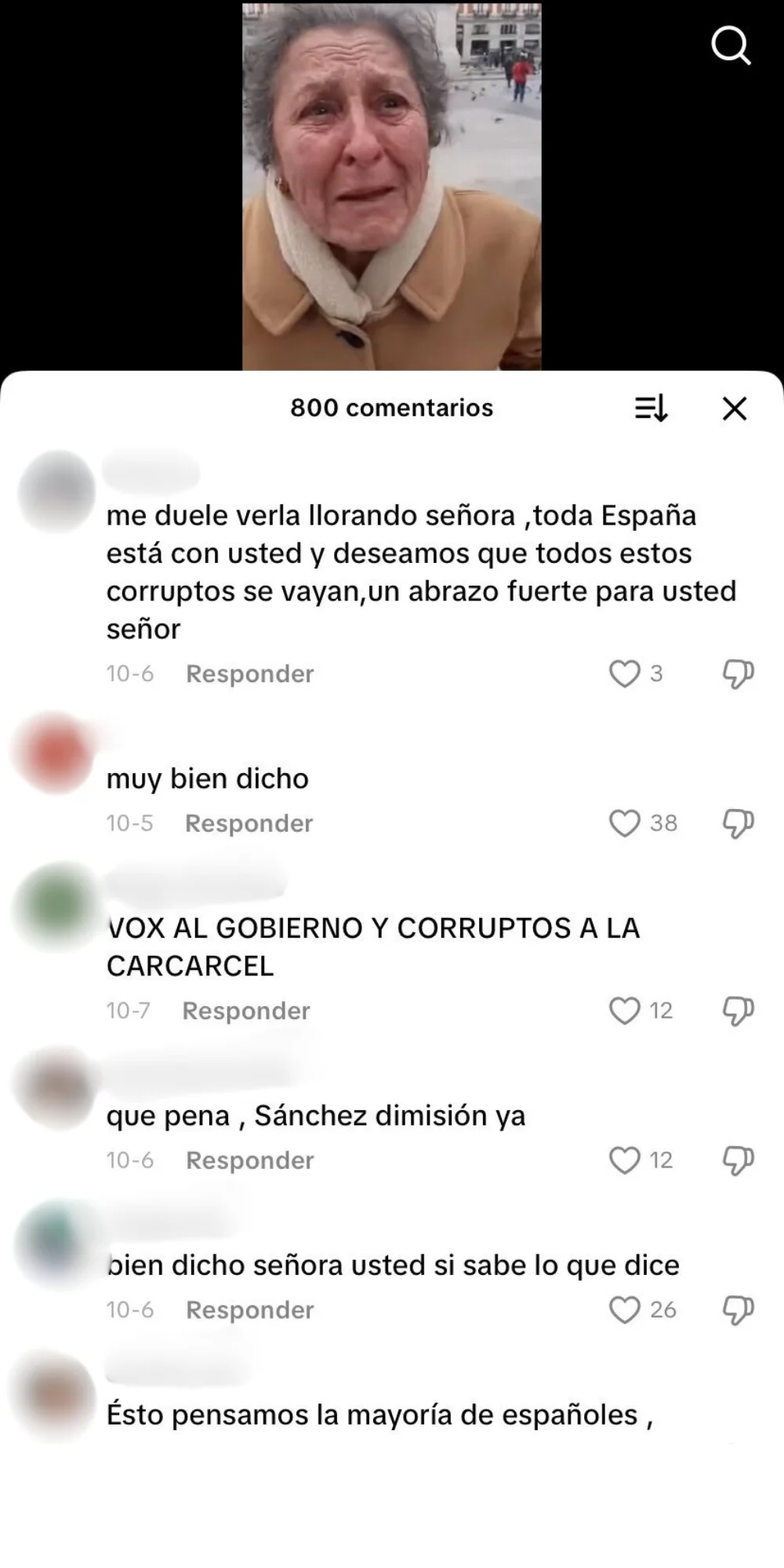

No todo son mensajes emotivos o consejos de vida. También hay vídeos que usan a ancianos creados con IA para lanzar mensajes políticos. Varios cuentan con la marca de agua de Sora, la red social de OpenAI que permite crear vídeos con IA y compartirlos con otros usuarios (y que se está usando para crear vídeos que pueden desinformar). Este es el caso de los vídeos creados con Sora de mujeres mayores llorando y pidiendo la dimisión de Pedro Sánchez, que incluyen el hashtag #pedrosanchezdimision. Tres de estos vídeos acumulan más de 86.700 visualizaciones en TikTok. A pesar de que la marca de agua de la app de OpenAI es visible, también hay comentarios de usuarios que parecen creer que estas personas son reales.

Otro vídeo generado con Sora muestra a una abuela despidiéndose de su nieto, mientras llora y lo abraza supuestamente porque tiene que dejar España porque no hay trabajo. Otro muestra a un hombre mayor que dice “desde el río hasta el mar, todo rojo es subnormal” y tiene indicios de haber sido creado con IA (no tiene ojos, sus dientes desaparecen a lo largo del clip, y la voz tiene un timbre metálico).

Las imágenes de ancianos generan credibilidad y emoción, lo que puede hacer que estos mensajes cuelen más en los usuarios

Natalia Martín, psicóloga y maldita que nos ha prestado sus superpoderes, explica que estos contenidos aprovechan la imagen de los ancianos, ya que “puede activar sesgos cognitivos que refuercen su credibilidad y autoridad moral”. Entre ellos, está el efecto halo que “hace que atribuyamos automáticamente rasgos positivos, como sabiduría, honestidad o bondad, a las personas mayores, no por su aspecto físico (motivo por el que es más conocido este efecto), sino por la carga simbólica que representa la vejez”.

Esto puede provocar que “la apariencia de serenidad y ternura de una persona mayor nos lleve a inferir que también es honesta o sabia, lo que aumenta la credibilidad del mensaje”.

Algo que coincide con las conclusiones de un estudio de 2021 de la Universidad Europea Viadrina (Alemania), que analizó cómo se usa la figura de ancianos en publicidad, y que concluyó que las personas mayores suelen transmitir mayor credibilidad y autoridad a otras personas.

Según la psicóloga, otro factor que puede entrar en juego en estos vídeos es el efecto Forer que provoca que nos sintamos identificados con mensajes vagos y generales, como los que aparecen en estos vídeos sobre la vida, la crianza y la soledad: “La familiaridad y el tono emocional facilitan que el público acepte el mensaje sin cuestionarlo”.

A esto se suma que los contenidos que apelan a nuestros sentimientos, como estos, nos vuelven más manipulables y pueden secuestrar nuestra capacidad de razonar a favor de su propio discurso, volviéndonos también más susceptibles a la desinformación.

En este artículo ha colaborado con sus superpoderes la maldita Natalia Martín, psicóloga.

Natalia Martín forma parte de Superpoderosas, un proyecto de Maldita.es que busca aumentar la presencia de científicas y expertas en el discurso público a través de la colaboración en la lucha contra la desinformación.

Gracias a vuestros superpoderes, conocimientos y experiencia podemos luchar más y mejor contra la mentira. La comunidad de Maldita.es sois imprescindibles para parar la desinformación. Ayúdanos en esta batalla: mándanos los bulos que te lleguen a nuestro servicio de Whatsapp, préstanos tus superpoderes, difunde nuestros desmentidos y hazte Embajador.