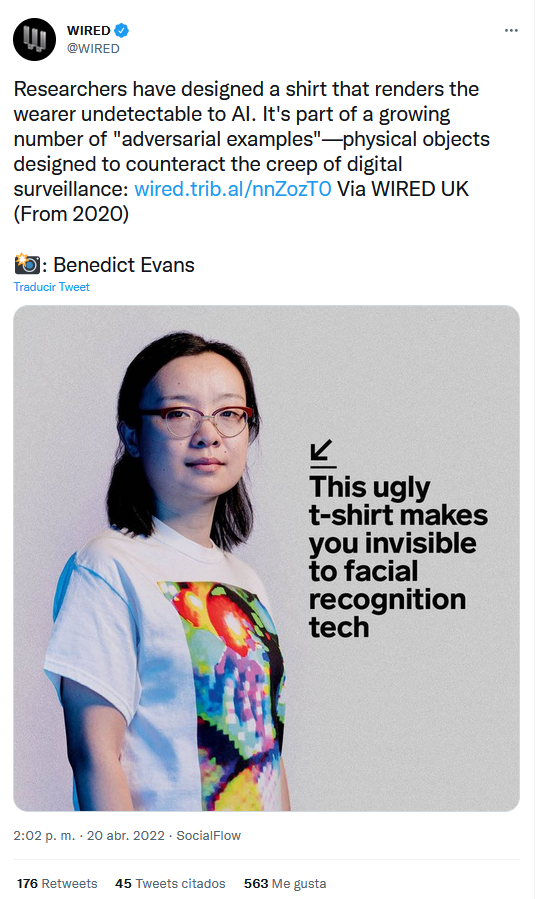

Circula por redes sociales un artículo publicado en la edición británica de la revista tecnológica Wired en 2020 sobre una camiseta que supuestamente evitaría que los sistemas de reconocimiento facial pudiesen identificarnos. Así lo refleja el titular de la pieza -"Esta fea camiseta te hace invisible contra el reconocimiento facial"-, y esa es la idea que comparten muchos usuarios. Sin embargo, las iniciativas que buscan camuflarnos ante la tecnología de reconocimiento facial tienen muchas limitaciones, como hemos contado ya en Maldita.es, y, en este caso, el objetivo es el contrario al que refleja el titular. En realidad, la camiseta es una prueba para mejorar los sistemas de vigilancia.

El objetivo de los diseñadores es buscar fallos que ayuden a mejorar los sistemas de reconocimiento facial

Según cuenta Wired en su artículo, la camiseta es el resultado de un proyecto llevado a cabo por investigadores del MIT, IBM y la Northeastern University de Estados Unidos para diseñar lo que llaman "ejemplos adversariales": objetos físicos que sean capaces de confundir a los sistemas de reconocimiento facial y camuflar a su portador de alguna manera. La idea es que el programa informático se centre en el objeto, en vez de en la cara de la persona, por lo que esta no podría ser identificada.

Pese a que el titular del artículo y la pieza en sí se comparten como si la camiseta fuese un avance tecnológico capaz de burlar el reconocimiento facial y proteger a la sociedad de los sistemas de vigilancia, el propio autor reconoce en la pieza que, en realidad, el objetivo del proyecto es "encontrar agujeros en las redes neuronales para que las compañías de vigilancia puedan arreglarlos". "En el futuro, esperamos poder arreglar esos problemas, de modo que los sistemas de aprendizaje automático no puedan trucarse", decía a la revista una de las investigadoras, Xue Lin.

"Cada seis meses se hace una pieza sobre una mascarilla, un tipo de maquillaje o una camiseta que te vuelve 'invisible' al reconocimiento facial. Detiene a estos sistemas unas 24 horas, luego los sistemas se adaptan, vuelven a funcionar, etc.", denuncia en su perfil de Twitter Daniel Leufer, del equipo de Políticas de Tecnologías Emergentes de AccessNow. "Esta no es una solución", continúa: "La solución es prohibir el reconocimiento facial".

Every 6 months there's a piece about a mask, makeup or tshirt that makes you 'invisible' to facial recognition

— Daniel Leufer (@djleufer) April 21, 2022

It stops systems for about 24hrs, the systems adapt, they work again etc etc

This is not a solution, the solution is to ban facial recognition#banBS #reclaimyourface https://t.co/Xe67mfVF6G

Las limitaciones del maquillaje y las prendas que, en teoría, nos protegen del reconocimiento facial

En los últimos años han surgido varias iniciativas de colecciones de prendas o de maquillaje que supuestamente pueden burlar estos sistemas. Funcionan analizando distintos algoritmos mediante la ingeniería inversa para encontrar sus puntos débiles y explotarlos con lo que los hace fallar, ya sea una sombra en un punto específico de la cara (que se puede imitar con maquillaje) o un diseño en un jersey o una camiseta que confunde al sistema con lo que realmente está buscando.

Desde EFF, una organización estadounidense dedicada a la protección de las libertades civiles en la vida digital, explicaban a Maldita.es que “estos métodos son divertidos para ver cómo la gente explora las limitaciones del reconocimiento facial y otras tecnologías de vigilancia, pues atraen la atención hacia este tema”. No obstante, señalan que “no son muy efectivos”, pues los algoritmos que están detrás de ese reconocimiento se pueden reprogramar para corregir esos fallos.

En esta línea, el ingeniero José Luis Calvo, del equipo de Inteligencia Artificial de Sngular, asegura que este tipo de iniciativas son más bien "una cuestión anecdótica y un tanto limitada, porque si tienen éxito, posteriores versiones de esta red neuronal serían actualizadas para detectar, ahora sí, a las personas que llevan este tipo de prendas”. “Paradójicamente, un éxito comercial llevaría a que les durase muy poco la invisibilidad”, señala.

Es decir, que por norma general, cuando estas prendas salen a la calle, a un entorno real, las empresas se enteran y son capaces de modificar sus algoritmos para corregir los errores en la identificación. Precisamente lo que señalan que hacen los investigadores citados por Wired.

Al final, el reconocimiento a personas no es el único punto en el que se puede engañar a una inteligencia artificial enfocada en detectar patrones. Como refleja esta investigación conjunta entre la Universidad de California, Washington, Michigan y Samsung Research, se puede engañar a la cámara de un coche autónomo poniendo pegatinas en las señales que evitan que sean detectadas correctamente por el vehículo. Toda esa investigación sirve para que las compañías comprendan qué agujeros están explotando y poder cerrarlos.

“La única solución es la prohibición de la vigilancia a través del reconocimiento facial, pues no deja de ser una vigilancia masiva a los ciudadanos, y porque no debemos dejar la responsabilidad de protegerse de estos métodos en cada individuo, sino abordarlo desde un cambio sistemático”, apunta en la misma línea Diego Naranjo, director de Políticas en EDRi, una red de organizaciones y expertos europeos para defender los derechos digitales en el continente.